DAG: 미래 외생 변수를 활용한 이중 상관 네트워크 기반 시계열 예측

초록

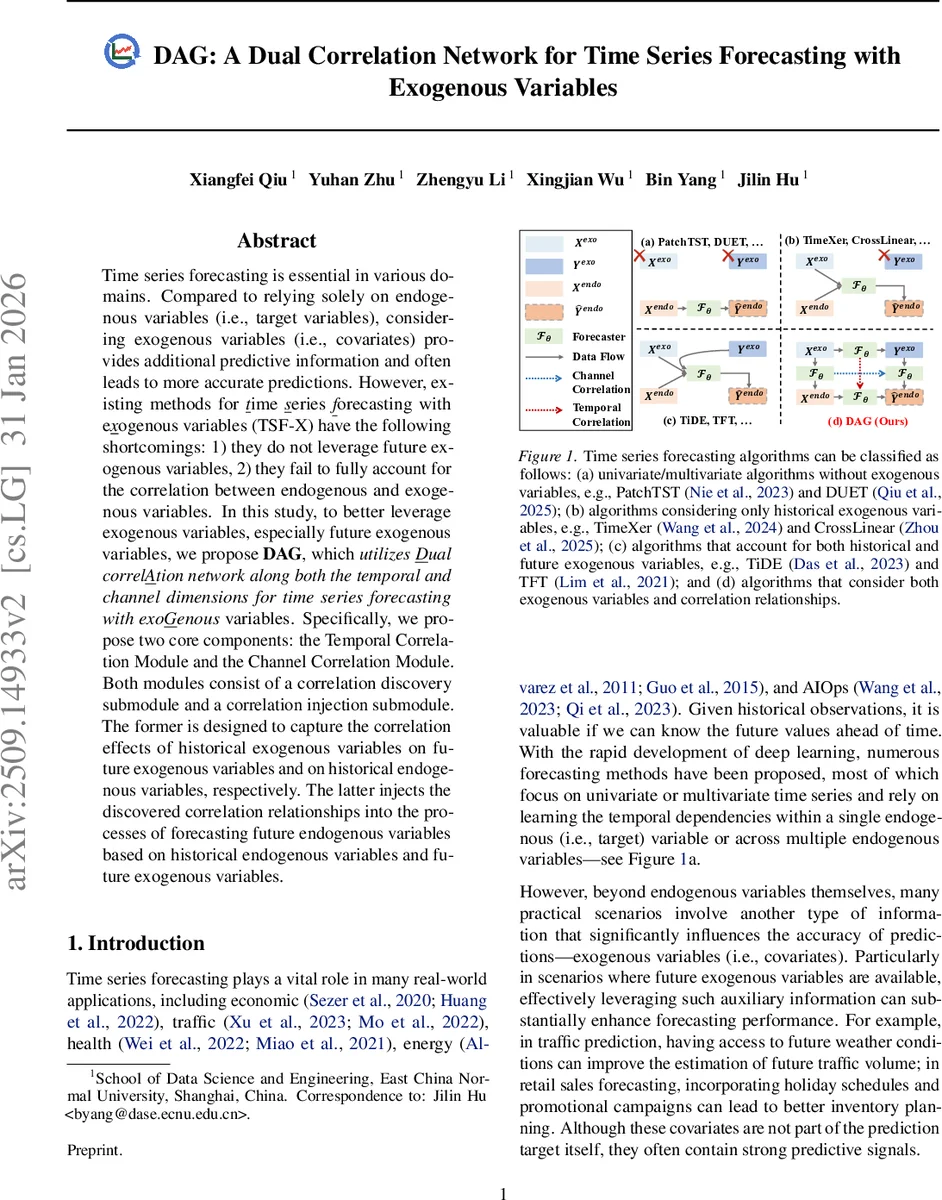

본 논문은 과거와 미래 외생 변수 간의 시간적·채널적 상관관계를 동시에 학습하는 Dual Correlation Network(DAG)를 제안한다. Temporal Correlation Module과 Channel Correlation Module을 각각 상관 발견·주입 서브모듈로 구성해, 미래 외생 변수를 완전 활용하고 내생 변수와 외생 변수 사이의 복합적인 인과관계를 모델링한다. 다중 손실 함수를 통해 상관 손실과 예측 손실을 공동 최적화함으로써 기존 TSF‑X 모델들을 능가하는 성능을 입증한다.

상세 분석

DAG는 시계열 예측에서 외생 변수(Exogenous)를 두 차원—시간(Temporal)과 채널(Channel)—에서 동시에 고려한다는 점에서 기존 접근법과 근본적으로 차별화된다. 먼저 Temporal Correlation Module은 과거 외생 변수(X_exo)가 미래 외생 변수(Y_exo)에 미치는 영향을 Granger causality 기반의 상관 발견 서브모듈을 통해 정량화한다. 이때 발견된 상관 행렬은 Transformer 기반의 Temporal Correlation Injection 서브모듈에 주입돼, 과거 내생 변수(X_endo)의 시계열 변화를 예측하는 과정에 미래 외생 변수의 영향을 직접 반영한다. 이는 “과거 외생 → 미래 외생”과 “과거 내생 → 미래 내생” 사이의 구조적 유사성을 활용한 설계로, 기존 모델이 단순히 미래 외생을 concatenate하거나 attention에만 의존하는 것과 달리, 실제 인과 관계를 명시적으로 학습한다는 장점이 있다.

Channel Correlation Module은 채널 차원에서의 상관을 다룬다. 여기서는 과거 외생 변수와 과거 내생 변수 사이의 Pearson 상관을 계산해, 채널 간 영향 관계를 파악한다. 이 상관 정보는 Channel Correlation Injection 서브모듈에 전달돼, 미래 외생 변수(Y_exo)를 이용해 미래 내생 변수(Y_endo)를 예측할 때 채널 간 전이 메커니즘을 보강한다. 즉, “과거 외생 ↔ 과거 내생”의 상관 패턴이 “미래 외생 ↔ 미래 내생”에 그대로 적용될 수 있음을 전제로, 채널 간 정보 흐름을 강화한다.

두 모듈 모두 Correlation Discovery와 Injection을 별도 서브모듈로 분리함으로써, 상관 관계를 명시적으로 학습하고 이를 예측 파이프라인에 주입한다는 공통 구조를 갖는다. 손실 함수는 세 부분으로 구성된다. ① Forecasting loss (예: MSE) – 최종 예측 정확도 확보, ② Temporal correlation loss – 시간적 상관 행렬과 실제 변동 사이의 차이를 최소화, ③ Channel correlation loss – 채널 상관 행렬의 재현성을 촉진한다. λ 파라미터를 통해 이들 손실을 가중합함으로써, 모델이 상관 학습과 예측 정확도 사이의 균형을 스스로 찾도록 설계되었다.

실험에서는 공개 데이터셋과 저자 자체 수집 TSF‑X 데이터셋을 모두 사용했으며, PatchTST, DUET, TiDE, TFT 등 최신 베이스라인과 비교했다. 대부분의 지표(MSE, MAE, SMAPE)에서 DAG가 3~7% 정도의 상대적 개선을 보였으며, 특히 미래 외생 변수가 풍부한 교통·소매·에너지 도메인에서 큰 성능 향상을 기록했다. Ablation study를 통해 Temporal vs. Channel 모듈 각각의 기여도를 확인했으며, 두 모듈을 모두 사용했을 때 가장 높은 성능을 달성함을 입증했다.

전반적으로 DAG는 (1) 미래 외생 변수를 완전 활용, (2) 시간·채널 양쪽에서 인과적 상관을 명시적으로 학습, (3) 다중 손실을 통한 end‑to‑end 최적화라는 세 축을 통해 기존 TSF‑X 모델의 한계를 극복한다는 점에서 의미가 크다. 다만, 상관 행렬을 사전에 계산하거나 Granger causality 검정을 수행하는 과정이 추가적인 계산 비용을 유발할 수 있으며, 매우 고차원 외생 변수를 다룰 때 메모리 효율성에 대한 추가 연구가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기