프라이버시 정책 QA에서 방언 편향을 완화하는 다중 에이전트 프레임워크

초록

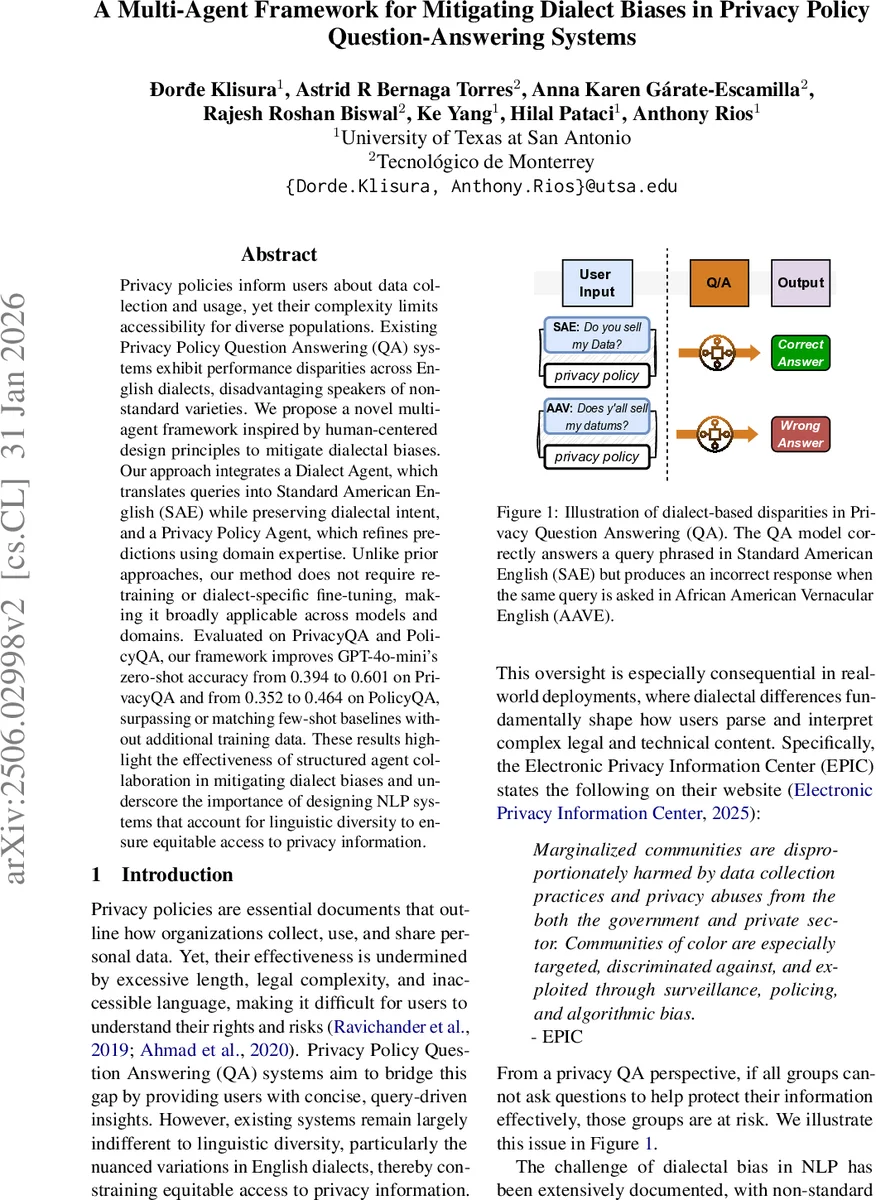

본 논문은 방언에 따라 성능 차이가 발생하는 프라이버시 정책 질문‑답변 시스템을 개선하기 위해, 방언을 표준 미국 영어(SAE)로 변환하고 정책 전문성을 보강하는 두 개의 전용 LLM 에이전트를 연계하는 다중‑에이전트 구조를 제안한다. 재학습 없이 제로‑샷 GPT‑4o‑mini에 적용했을 때 PrivacyQA와 PolicyQA에서 정확도가 각각 0.394→0.601, 0.352→0.464로 크게 상승했으며, 방언 간 성능 격차를 최대 82 % 감소시켰다.

상세 분석

이 연구는 프라이버시 정책이라는 고도로 전문화된 도메인과, 영어 방언이라는 사회언어학적 변이 두 축에서 발생하는 불공정성을 동시에 다루는 점이 혁신적이다. 기존 연구는 주로 방언 편향을 일반 NLP 태스크에 국한하거나, 도메인‑특화 QA에서 성능 향상을 위해 대규모 파인튜닝을 요구했지만, 본 논문은 “프롬프트 기반 협업”이라는 경량화된 접근을 채택한다.

핵심 구성요소는 ‘Dialect Agent’와 ‘Privacy Policy Agent’이다. Dialect Agent는 사전에 제공되는 방언 특성 요약(음운·문법·어휘·문화적 특징)을 프롬프트에 삽입해, 사용자의 방언 질문을 SAE로 정확히 번역하고, 번역 과정에서 원문의 의도와 문화적 뉘앙스를 보존한다는 목표를 갖는다. 이때 번역 결과와 원문을 함께 제시함으로써, 이후 단계에서의 의미 손실을 최소화한다.

번역된 질문은 Privacy Policy Agent에게 전달된다. 이 에이전트는 정책 조각과 SAE 질문을 입력받아, 정책 텍스트에 근거한 간결하고 사실적인 답변을 생성한다. 답변과 함께 “왜 이 답변이 도출됐는가”에 대한 근거를 제공함으로써, 후속 검증 단계에서 투명성을 확보한다.

다음 단계에서 Dialect Agent는 원본 방언 질문, 정책 조각, 그리고 Privacy Agent가 만든 답변을 재검토한다. 답변이 원문의 의도를 충분히 반영하지 못하거나 방언 특유의 의미가 누락되었다면, Dialect Agent는 “Disagree” 신호와 함께 구체적인 수정 제안을 반환한다. 이 피드백을 기반으로 Privacy Agent가 답변을 재생성하거나, 최종적으로 Dialect Agent가 최종 검증을 수행해 사용자가 이해하기 쉬운 형태로 출력한다.

수식적으로는 각 방언 d∈D에 대해 QA 모델 f의 성능 Φ_d(f)를 정의하고, 최대·최소 차이 Δ(f)=max_d_i,d_j |Φ_d_i−Φ_d_j| 를 최소화하는 것이 목표이다. 다중‑에이전트 파이프라인 F는 f에 추가적인 파라미터 튜닝 없이도 Δ를 크게 감소시키면서 평균 정확도도 유지하거나 향상시킨다.

실험에서는 기존 PrivacyQA와 PolicyQA 데이터셋에 방언 변형을 적용한 Multi‑VALUE 프레임워크 기반 테스트 셋을 사용했다. GPT‑4o‑mini 제로‑샷 베이스라인 대비, 제안된 프레임워크는 정확도가 각각 0.207, 0.112 상승했으며, 방언별 F1 차이는 최대 82 % 감소했다. 또한, few‑shot 프롬프트(예: 5‑shot)와 비교했을 때도 동등하거나 우수한 성능을 보였다.

주요 기여는 (1) 프라이버시 정책 QA에서 방언 편향을 정량화한 최초 연구, (2) 방언 정보를 프롬프트에 직접 삽입해 재학습 없이 편향을 완화하는 다중‑에이전트 설계, (3) 상세한 소거 실험과 오류 분석을 통해 각 에이전트의 역할과 한계를 명확히 제시한 점이다. 한계로는 방언 정보가 사전 정의된 템플릿에 의존한다는 점, 그리고 현재는 두 단계(번역‑답변)만을 사용해 복합적인 다중‑턴 대화에는 적용되지 않았다는 점을 들 수 있다. 향후 연구에서는 방언‑도메인 매핑을 자동화하고, 다중‑에이전트 간의 동적 협상 메커니즘을 도입해 더욱 복잡한 사용자 요구를 처리할 수 있을 것으로 기대한다.

댓글 및 학술 토론

Loading comments...

의견 남기기