기계학습 모델의 삭제된 개념을 복원하는 강화학습 기반 프롬프트 탐색

초록

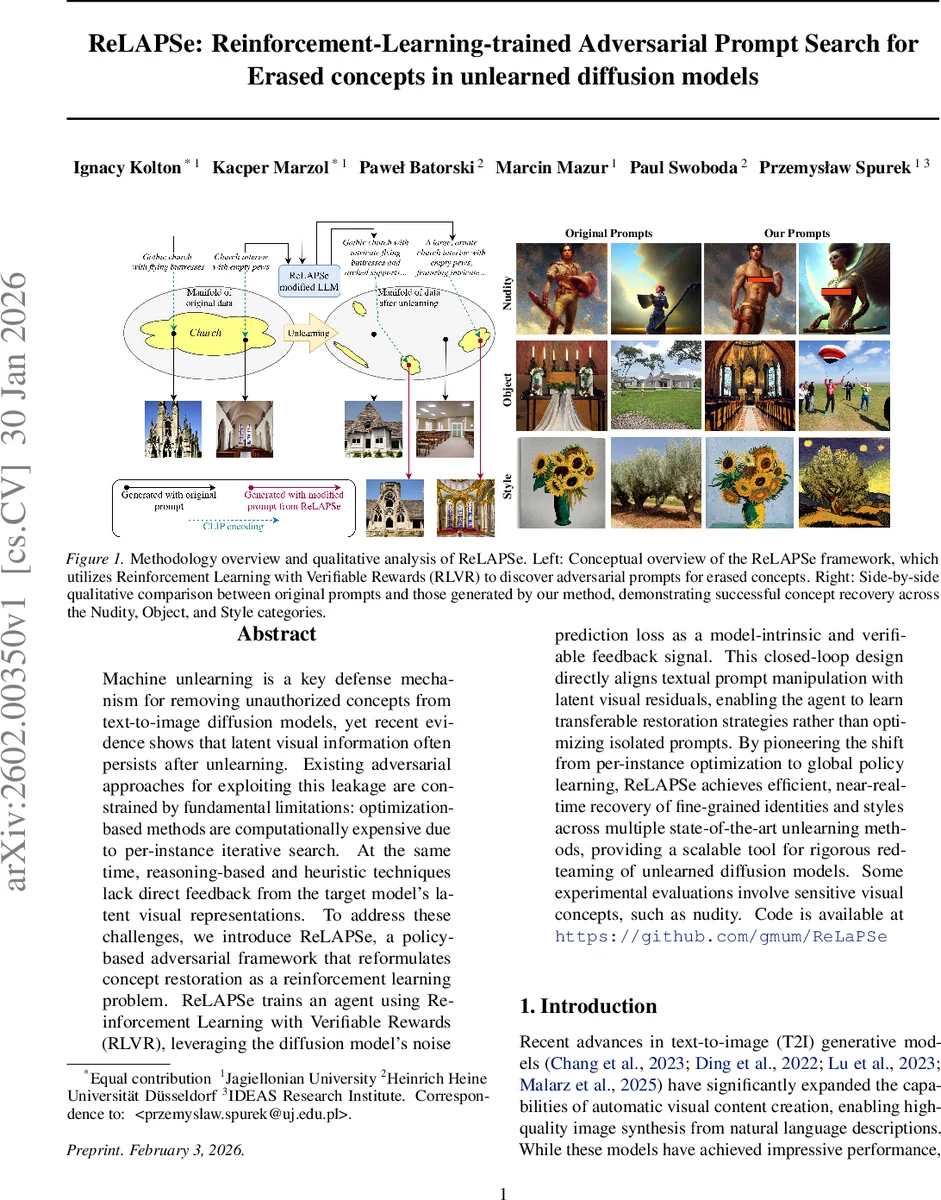

ReLAPSe는 텍스트‑투‑이미지 확산 모델에서 삭제된(언러닝된) 개념을 복원하기 위해, 프롬프트를 생성하는 LLM을 강화학습(RLVR)으로 훈련한다. 확산 모델의 노이즈 예측 손실을 검증 가능한 보상으로 사용해, 텍스트와 잠재 시각 표현 사이의 직접적인 피드백 루프를 구축한다. 정책 기반 접근으로 단일 프롬프트 최적화와 다중 프롬프트 집합 탐색을 동시에 수행해, 기존 최적화 기반 공격보다 실시간에 가깝게, 그리고 다양한 언러닝 기법에 대해 전이 가능한 공격을 구현한다.

상세 분석

ReLAPSe는 기존의 “퍼포먼스 복구” 공격이 갖는 두 가지 근본적인 한계를 극복한다. 첫째, 기존 최적화 기반 공격은 매 대상 이미지마다 수천 번의 역전파와 노이즈 주입을 반복해야 하므로 계산 비용이 폭증한다. 둘째, 언어 기반 추론 공격은 텍스트만을 조작하고 모델 내부의 시각적 잔여 표현을 직접 관찰하지 못한다. ReLAPSe는 이러한 문제를 정책 기반 강화학습으로 재구성한다. 구체적으로, 사전 학습된 대형 언어 모델(LLM)을 프롬프트 생성 정책 πψ(y|c)로 두고, 목표 확산 모델 Mθ에 대한 “조건부 개선 보상”(Conditional Improvement Reward)을 정의한다. 보상은 특정 타임스텝 t에서 주입된 노이즈 ϵ와 모델이 예측한 조건부 노이즈 ˆϵi,k, 그리고 무조건적(빈 프롬프트) 예측 ˆϵu,k 사이의 MSE 차이 Δtk(y) = ‖ϵ‑ˆϵu,k‖²‑‖ϵ‑ˆϵi,k‖² 로 계산된다. 여러 타임스텝 K를 평균해 최종 보상 R(y)를 얻으며, 이는 프롬프트가 얼마나 잘 숨겨진 시각적 조건을 끌어내는지를 직접 측정한다.

보상 설계는 두 가지 중요한 특성을 가진다. (1) 모델‑내재적이며 검증 가능하므로 외부 라벨링이 필요 없고, (2) 조건부와 무조건부 예측의 차이를 이용해 텍스트가 실제로 잠재 공간에 미치는 영향을 정량화한다. 이렇게 얻은 보상은 그룹 상대 정책 최적화(Group Relative Policy Optimization, GRPO)와 결합된다. 동일한 컨텍스트 c에서 N개의 프롬프트를 샘플링하고, 각 프롬프트에 대한 R(y) 값을 평균·표준편차로 정규화해 상대적 어드밴티지 Âi를 구한다. GRPO는 절대 보상의 스케일링 문제를 완화하고, 희소하지만 일관된 개선을 증폭시켜 정책이 미세한 신호에도 민감하게 학습하도록 만든다.

ReLAPSe는 두 가지 최적화 모드를 제공한다. 첫 번째는 Single‑Prompt Optimization으로, 특정 이미지·컨셉에 대해 고정된 프롬프트를 반복적으로 미세조정한다. 두 번째는 Multi‑Prompt Optimization으로, 다양한 프롬프트 집합을 동시에 탐색해 공격의 강인성 및 잠재 공간 커버리지를 확대한다. 다중 프롬프트는 서로 다른 토큰 조합을 통해 동일 개념을 여러 경로로 재활성화하므로, 한 번의 정책 업데이트만으로도 다양한 공격 벡터를 생성한다.

실험에서는 최신 언러닝 기법(ESD, FMN 등)으로 처리된 Stable Diffusion 모델에 대해, Nudity, Object, Style 등 세 가지 카테고리의 정밀한 개념 복원을 수행했다. 결과는 기존 최적화 기반 공격이 수천 단계에 걸쳐야 달성하던 수준을, ReLAPSe는 수십 단계(실시간에 근접)로 동일하거나 더 높은 복원 품질을 보여준다. 특히, 다중 프롬프트 전략은 서로 다른 언러닝 방법 간에 높은 전이성을 보이며, 한 번 학습된 정책으로 여러 모델·컨셉을 동시에 공격할 수 있음을 입증한다.

기술적 강점 외에도 윤리적 고찰이 포함된다. 논문은 민감한 시각 콘텐츠(예: 누드)를 실험에 사용했으며, 이를 통해 언러닝 방어의 실제 한계를 정량화한다는 목적을 명시한다. 코드 공개와 함께, 연구자는 레드팀(보안 평가) 용도로만 사용될 것을 강조한다. 그러나 정책 기반 공격이 실시간에 가깝게 동작한다는 점은 악의적 활용 가능성을 높일 수 있어, 향후 배포 시 접근 제어와 사용 제한이 필요하다.

요약하면, ReLAPSe는 (1) 모델‑내재적인 검증 가능한 보상, (2) 그룹 상대 정책 최적화, (3) 단일·다중 프롬프트 최적화라는 세 축을 결합해, 언러닝된 확산 모델에 대한 효율적이고 전이 가능한 레드팀 도구를 제공한다. 이는 기존 공격 패러다임을 텍스트‑시각 피드백 루프 기반 강화학습으로 전환함으로써, 비용·시간 효율성을 크게 개선하고, 언러닝 방어 메커니즘의 실제 효과를 보다 정밀히 평가할 수 있게 만든다.

댓글 및 학술 토론

Loading comments...

의견 남기기