RAG가 시각 주의를 빼앗는다: 주의 분산(AD) 문제와 훈련‑무료 해결책 MAD‑RAG

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

**

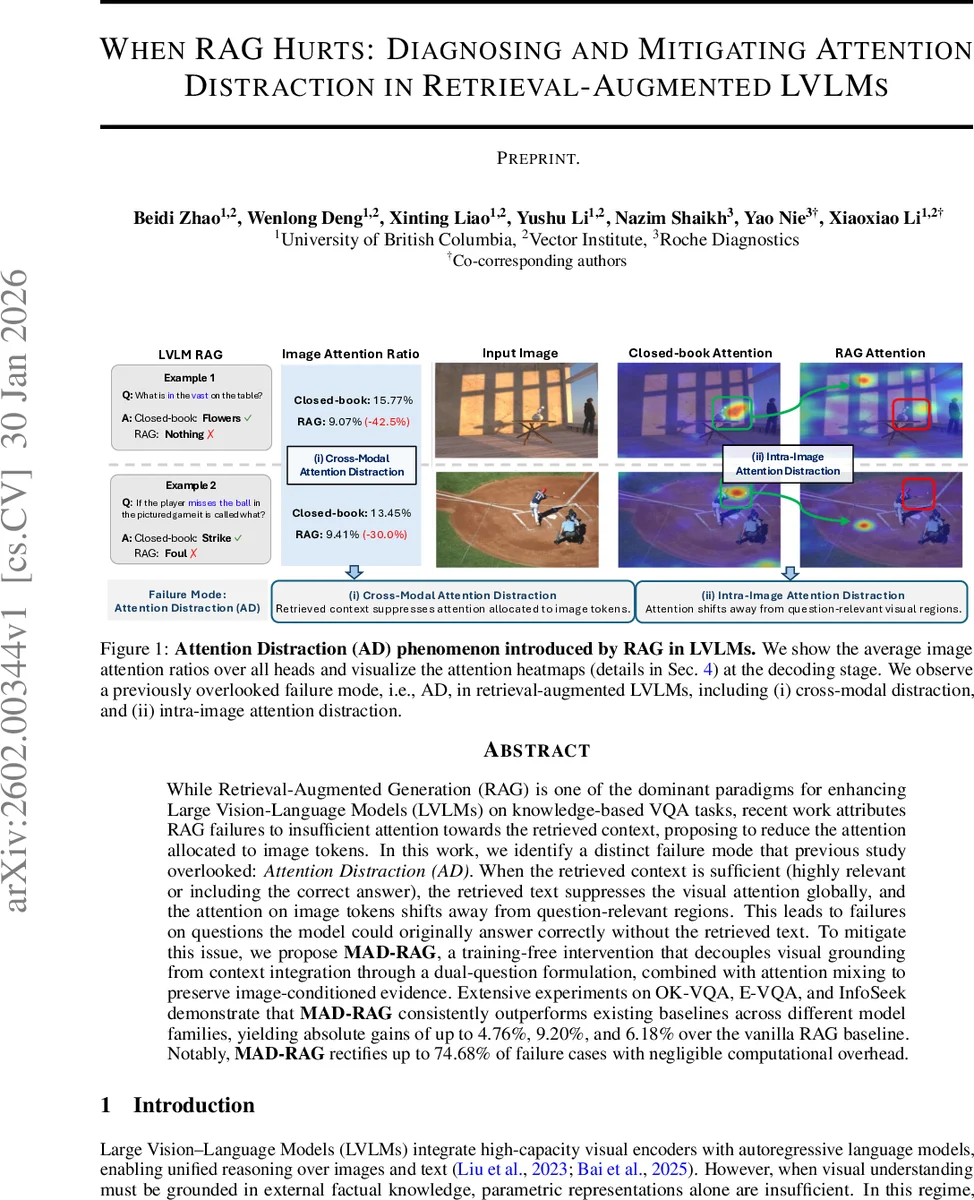

본 논문은 검색‑증강 생성(RAG) 방식이 대형 시각‑언어 모델(LVLM)에서 이미지 토큰에 대한 주의를 과도하게 감소시켜, 정답을 이미 알고 있던 질문까지도 틀리게 만드는 ‘주의 분산(Attention Distraction, AD)’ 현상을 규명한다. 저자는 AD를 교차‑모달 주의 감소와 이미지 내부 주의 이동 두 축으로 정의하고, 훈련 없이 추론 단계에서 적용 가능한 ‘MAD‑RAG’ 방법을 제안한다. Dual‑question 입력 구조와 어텐션 믹싱을 통해 시각적 근거와 외부 텍스트 정보를 분리·재조정함으로써, OK‑VQA, E‑VQA, InfoSeek 등에서 기존 RAG 대비 4‒9%p의 절대 정확도 향상과 74% 이상의 실패 사례 복구를 달성한다.

**

상세 분석

**

이 논문은 기존 연구가 “텍스트에 대한 주의가 부족해 RAG가 실패한다”는 가설에 반하여, 텍스트가 오히려 시각적 주의를 억제하는 새로운 실패 모드를 제시한다. 저자는 두 가지 구체적 현상을 관찰한다. 첫째, 교차‑모달 주의 분산(Cross‑modal Attention Distraction) 으로, RAG 입력(

댓글 및 학술 토론

Loading comments...

의견 남기기