멀티모달 비디오 딥페이크 탐지와 로컬라이제이션

초록

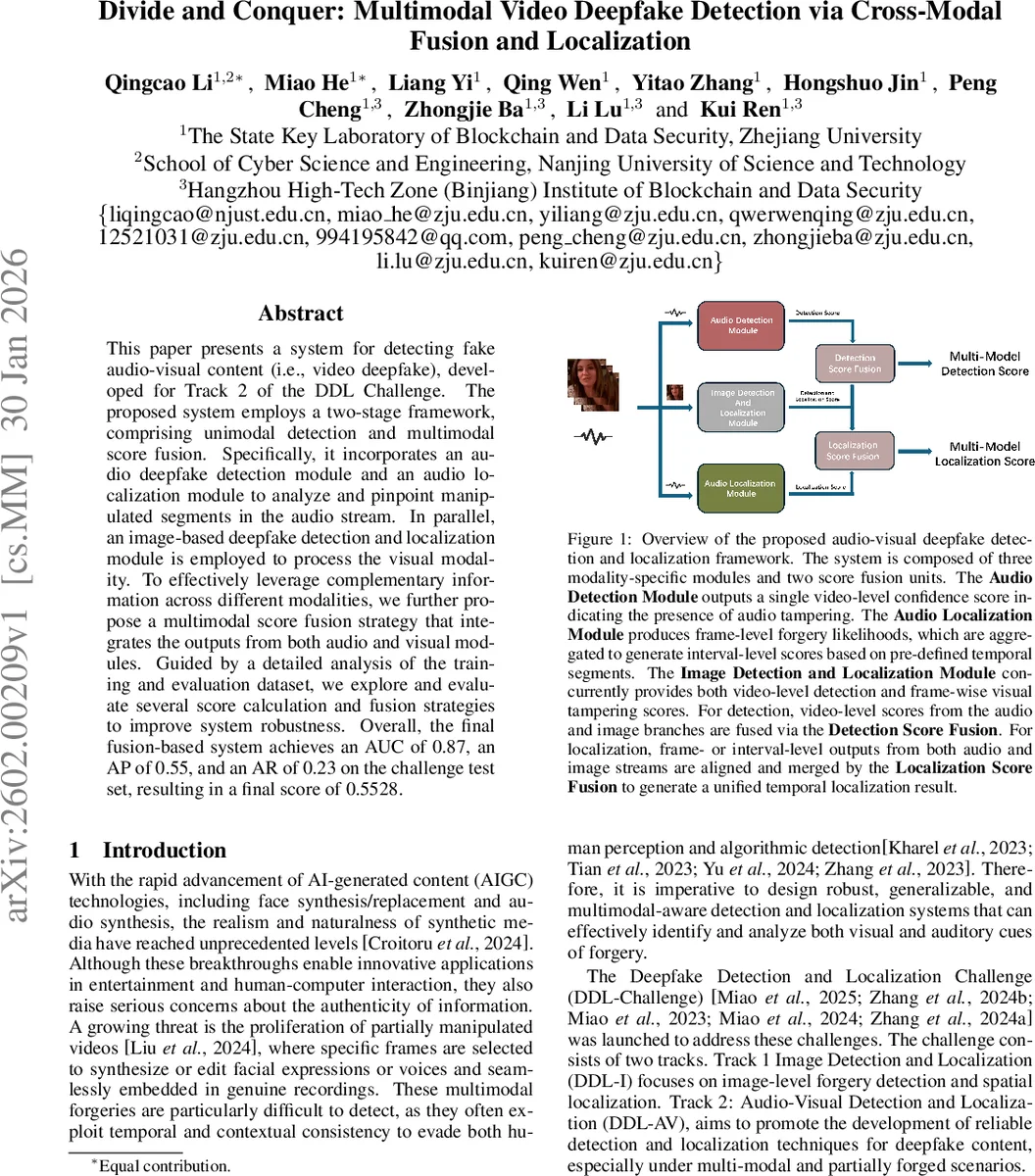

본 논문은 오디오와 영상 두 모달을 각각 검출·위치 파악한 뒤, 점수 융합을 통해 최종 딥페이크 여부와 변조 구간을 판단하는 2단계 시스템을 제안한다. 오디오 검출은 WAV2VEC2‑AASIST 기반, 오디오 로컬라이제이션은 Boundary‑aware Attention Mechanism을 사용하고, 영상 검출·로컬라이제이션은 이미지 기반 모델을 적용한다. 검출 점수와 로컬라이제이션 점수를 각각 융합해 최종 결과를 도출했으며, 챌린지 테스트에서 AUC 0.87, AP 0.55, AR 0.23을 기록하였다.

상세 분석

이 연구는 멀티모달 딥페이크 탐지의 핵심 과제인 ‘부분 변조’와 ‘시간·모달 불일치’를 해결하기 위해 모듈화된 파이프라인을 설계했다. 첫 번째 단계는 각 모달별 독립적인 검출·위치 추정이다. 오디오 검출에서는 XLS‑R 기반 전처리와 AASIST 그래프 신경망을 결합한 WAV2VEC2‑VEC2.0‑AASIST 모델을 사용해 2초 길이의 슬라이딩 윈도우를 적용하고, 동적 라벨링 전략으로 부분 변조 구간을 정확히 학습한다. 데이터 증강으로는 Rawboost, SpecAugment, 잡음·배경음·배경음성 혼합을 50% 비율로 적용해 잡음 환경에 대한 강인성을 확보한다. 오디오 로컬라이제이션은 WaveLM‑Large를 프론트엔드로, Boundary Enhancement Module과 Boundary Frame‑wise Attention Module을 포함한 BAM 구조를 도입해 경계 정보를 명시적으로 모델링한다. 이는 변조 구간의 시작·종료점을 정확히 포착하고, 프레임 간 메시지 전달을 조절해 오디오 위조 탐지의 정밀도를 높인다. 영상 측면에서는 기존 이미지 딥페이크 검출·위치 모델(Chollet, 2017)을 그대로 활용해 프레임 수준의 변조 확률과 전체 비디오 수준의 신뢰도를 출력한다. 두 번째 단계에서는 검출 점수와 로컬라이제이션 점수를 각각 ‘Detection Score Fusion’과 ‘Localization Score Fusion’으로 융합한다. 검출 점수는 단순 평균 혹은 가중 평균을 통해 영상 전체의 위조 여부를 결정하고, 로컬라이제이션 점수는 시간 정렬 후 통합하여 최종 변조 구간을 도출한다. 이러한 계층적 융합은 각 모달의 강점을 살리면서 상호 보완적인 정보를 활용한다는 점에서 의미가 크다. 데이터 분석 결과, 변조 구간이 0.5초 이하인 경우가 57%(오디오)·46%(영상)로 다수이며, 잡음·블러·다중 화자 등 다양한 방해 요소가 존재한다. 따라서 짧은 구간 탐지와 잡음 강인성이 핵심 설계 요소가 된다. 실험에서는 제안된 시스템이 AUC 0.87, AP 0.55, AR 0.23을 달성했으며, 이는 기존 단일 모달 접근법 대비 현저히 높은 성능을 보여준다. 다만 로컬라이제이션 AP·AR이 상대적으로 낮아 시간적 정확도 향상이 필요함을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기