유도적 적대적 자기대결로 견고한 추론 학습

초록

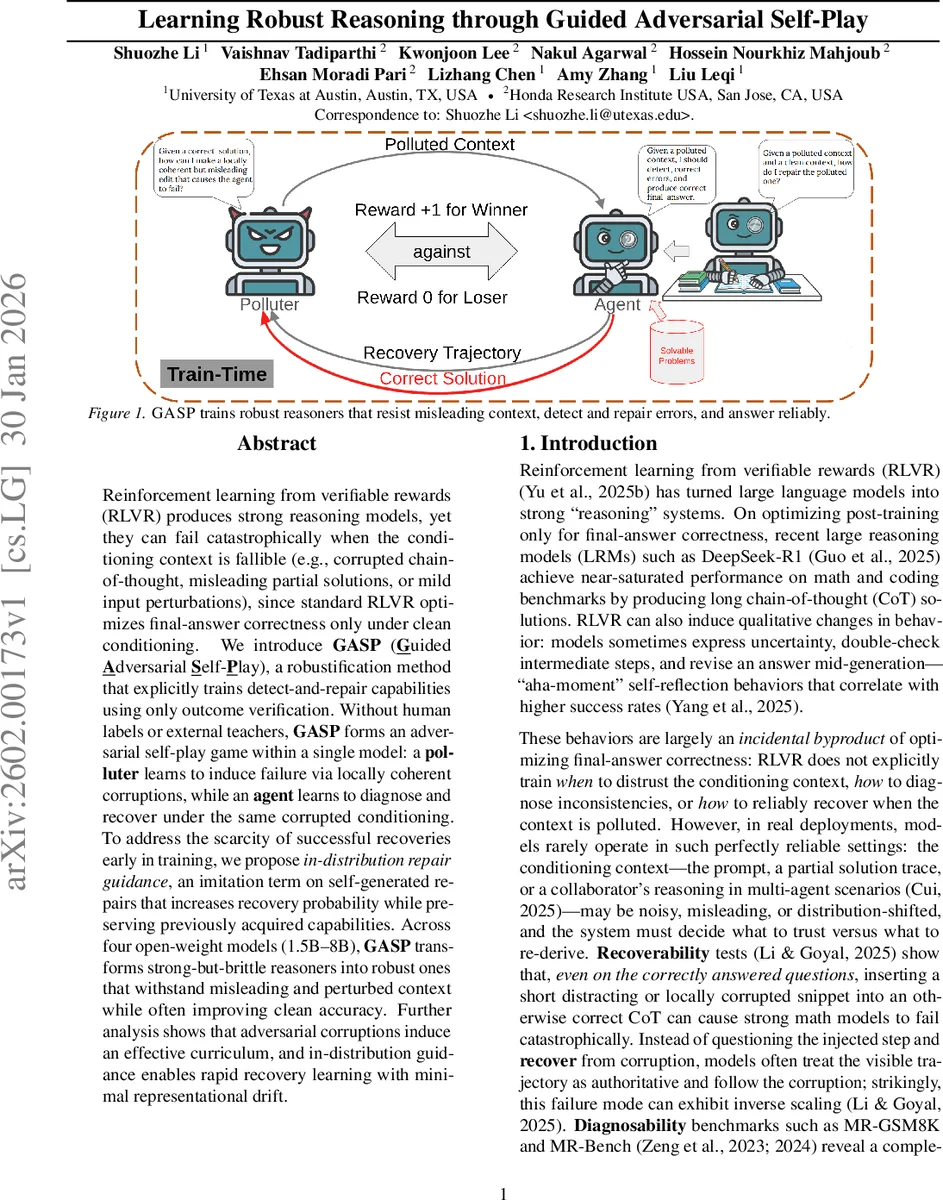

본 논문은 검증 가능한 최종 정답 보상만을 이용해 학습된 추론 모델이, 오류가 포함된 컨텍스트(코드, 체인‑오브‑쓰레드 등)에서 크게 성능이 떨어지는 문제를 해결한다. 모델 자체를 ‘오염자’와 ‘복구자’ 두 역할로 동시에 학습시키는 적대적 자기대결(GASP) 방식을 제안하고, 초기 복구 성공률이 낮은 상황을 완화하기 위해 자체 생성 복구 샘플을 모방하는 ‘인‑분포 복구 가이드’를 도입한다. 1.5B‑8B 규모의 공개 모델에 적용한 결과, 오류 진단·복구·입력 교란에 대한 강인성이 크게 향상되고, 깨끗한 상황에서도 정확도가 소폭 상승한다.

상세 분석

GASP는 기존 RLVR이 최종 정답만을 보상으로 삼아 “깨끗한” 컨텍스트에서만 최적화되는 한계를 인식하고, 컨텍스트 자체가 오류를 포함할 수 있다는 현실적인 가정을 도입한다. 핵심 아이디어는 하나의 모델을 두 개의 역할(오염자와 복구자)로 동시에 학습시키는 적대적 자기대결 게임이다. 오염자는 주어진 질문과 현재까지의 올바른 추론 전부분을 입력으로 받아, 문맥적으로 일관되지만 의도적으로 오해를 일으키는 짧은 텍스트(‘오염 윈도우’)를 생성한다. 복구자는 이 오염된 컨텍스트를 그대로 받아, 오류를 감지하고 올바른 답을 도출하도록 학습한다. 두 역할 모두 최종 정답이 맞는지 여부만을 이용해 보상을 계산하므로, 별도의 단계별 라벨링이나 외부 교사 모델이 필요하지 않는다.

하지만 오염된 컨텍스트 아래서는 복구자가 올바른 답을 내놓을 확률이 매우 낮아, 순수한 결과 기반 정책 그래디언트는 신호가 희소해진다. 이를 해결하기 위해 논문은 ‘인‑분포 복구 가이드’를 제안한다. 복구자는 자체적으로 생성한 ‘복구 스니펫’을 진단 프롬프트에 포함시켜 샘플링하고, 이 샘플을 모방(imitation) 목표로 추가한다. 이렇게 하면 복구 성공 확률이 인위적으로 상승하고, 동일한 그룹 크기에서도 충분한 성공 사례가 확보돼 GRPO(그룹 상대 정책 최적화) 업데이트가 의미 있게 진행된다. 또한, 외부 교사(예: GPT‑5)보다 자체 샘플을 모방하는 것이 정책 확률이 더 높아, 동일한 학습량당 파라미터 변화가 작아 표현 드리프트가 최소화된다.

학습 과정은 자연스러운 커리큘럼을 형성한다. 복구자가 강해질수록 오염자는 더 정교하고 미묘한 오염을 찾아야 하며, 이는 모델이 점진적으로 더 복잡한 오류 유형을 탐지·수정하도록 만든다. 실험에서는 1.5B, 3B, 6B, 8B 규모의 오픈‑웨이트 모델에 GASP를 적용했으며, 진단 가능성(MR‑GSM8K, MR‑Bench), 복구 가능성, 그리고 입력 교란(RUPBench) 등 세 가지 스트레스 테스트에서 모두 유의미한 개선을 보였다. 흥미롭게도, 깨끗한 상황에서도 약간의 정확도 상승이 관찰되었는데, 이는 모델이 보다 ‘신중한’ 추론 전략을 학습하면서 불필요한 추론 경로를 줄인 결과로 해석된다. 추가 분석에서는 오염자와 복구자 사이의 적대적 상호작용이 효과적인 커리큘럼을 제공한다는 점과, 인‑분포 복구 가이드가 초기 복구 학습을 가속화하면서 기존 능력을 보존한다는 점을 확인했다. 전체적으로 GASP는 라벨이 없는 환경에서도 강인한 추론 능력을 획득할 수 있는 실용적인 프레임워크로 평가된다.

댓글 및 학술 토론

Loading comments...

의견 남기기