3D 일관성을 위한 비디오 생성 기하학 정렬

초록

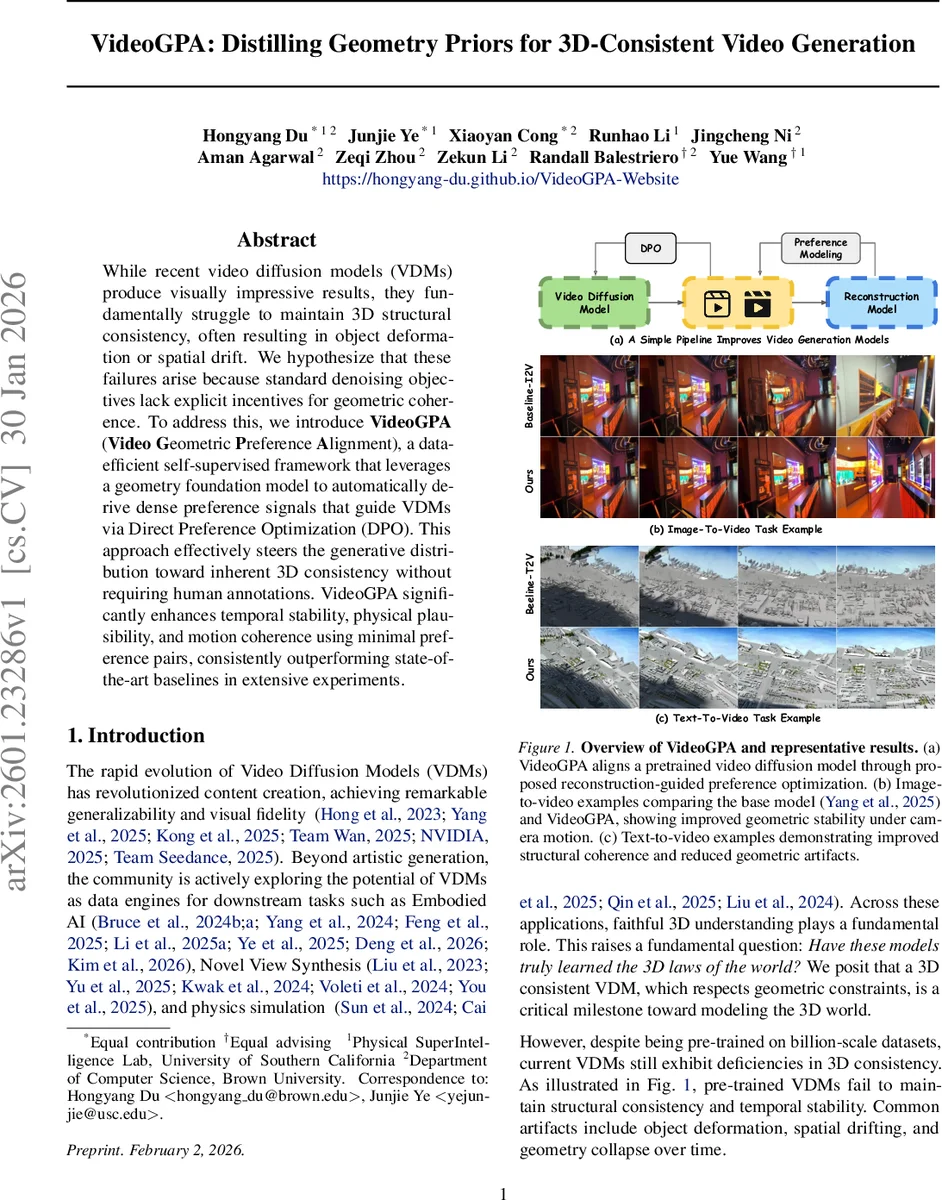

VideoGPA는 사전 학습된 비디오 확산 모델에 기하학 기반 선호 신호를 자동으로 제공하여 3D 구조적 일관성을 강화하는 프레임워크이다. 기하학 기반 모델을 이용해 생성 비디오의 재구성 오류를 측정하고, 이를 선호 쌍으로 변환해 Direct Preference Optimization(DPO)으로 모델을 미세조정한다. 최소 2,500개의 선호 쌍과 LoRA 파라미터 1%만 사용해도 기존 모델 대비 시간적 안정성, 물리적 타당성, 움직임 일관성이 크게 향상된다.

상세 분석

VideoGPA는 현재 비디오 확산 모델(VDM)이 픽셀 수준의 denoising 목표에만 집중해 3D 구조적 일관성을 놓치는 문제를 근본적으로 해결한다. 핵심 아이디어는 Geometry Foundation Model(GFM)을 “자동화된 보상 모델”로 활용해 생성된 비디오의 3D 재구성 오류를 정량화하고, 이를 선호(pairwise) 신호로 변환하는 것이다. 구체적으로, GFM은 각 프레임에서 깊이와 카메라 포즈를 추정하고, 이를 기반으로 컬러 포인트 클라우드를 구성한다. 이후 포인트 클라우드를 각 프레임에 재투영해 재구성 이미지와 원본 이미지 사이의 MSE와 LPIPS를 합산한 재구성 손실(E_Recon)을 3D 일관성 점수로 사용한다. 낮은 E_Recon은 높은 기하학적 일관성을 의미한다.

이 점수를 기준으로 동일한 텍스트·이미지 프롬프트에 대해 여러 시드로 생성된 비디오들을 비교하고, 점수 차이가 충분히 큰 경우를 “우승”(high‑consistency)과 “패배”(low‑consistency) 샘플로 매핑한다. 이렇게 만든 선호 쌍을 DPO에 투입하면, DPO는 베르누이 로그우도 비율을 이용해 우승 샘플의 로그 확률을 패배 샘플보다 높이는 방향으로 모델 파라미터를 업데이트한다. VideoGPA는 기존 VDM의 v‑prediction 파라미터화를 그대로 유지하면서, LoRA 방식으로 전체 파라미터의 약 1%만을 조정한다. 따라서 학습 비용이 매우 낮고, 원본 모델의 시각적 품질을 크게 손상시키지 않는다.

실험에서는 이미지‑투‑비디오(I2V)와 텍스트‑투‑비디오(T2V) 두 시나리오 모두에서 3D 재구성 오류, Epipolar 일관성, MVCS, 3DCS 등 다양한 기하학적 메트릭이 크게 개선되었으며, 인간 평가 기반 VideoReward에서도 우수한 승률을 기록했다. 특히, 기존 SFT(슈퍼바이즈드 파인튜닝)나 Epipolar‑DPO와 비교했을 때, 최소한의 데이터와 파라미터로도 일관성 점수와 시각적 품질 모두에서 상위 성능을 달성했다.

이 접근법의 강점은 (1) 인간 라벨이 전혀 필요 없는 완전 자기지도 방식, (2) GFM이 제공하는 밀도 높은 재구성 신호를 직접적인 보상으로 활용함으로써 기하학적 오류를 정량적으로 억제, (3) 기존 VDM 파이프라인에 최소한의 오버헤드만 추가한다는 점이다. 한계로는 GFM 자체의 추정 정확도에 의존한다는 점과, 복잡한 동적 씬(예: 비, 연기 등)에서는 재구성 오류가 과도하게 높아 선호 신호가 불안정해질 가능성이 있다. 향후 연구에서는 멀티모달 GFM(깊이·법선·광원) 통합, 그리고 동적 물체 전용 재구성 손실 설계가 필요할 것으로 보인다.

댓글 및 학술 토론

Loading comments...

의견 남기기