자율적 사고흐름 증류를 통한 그래프 기반 사기 탐지 혁신

초록

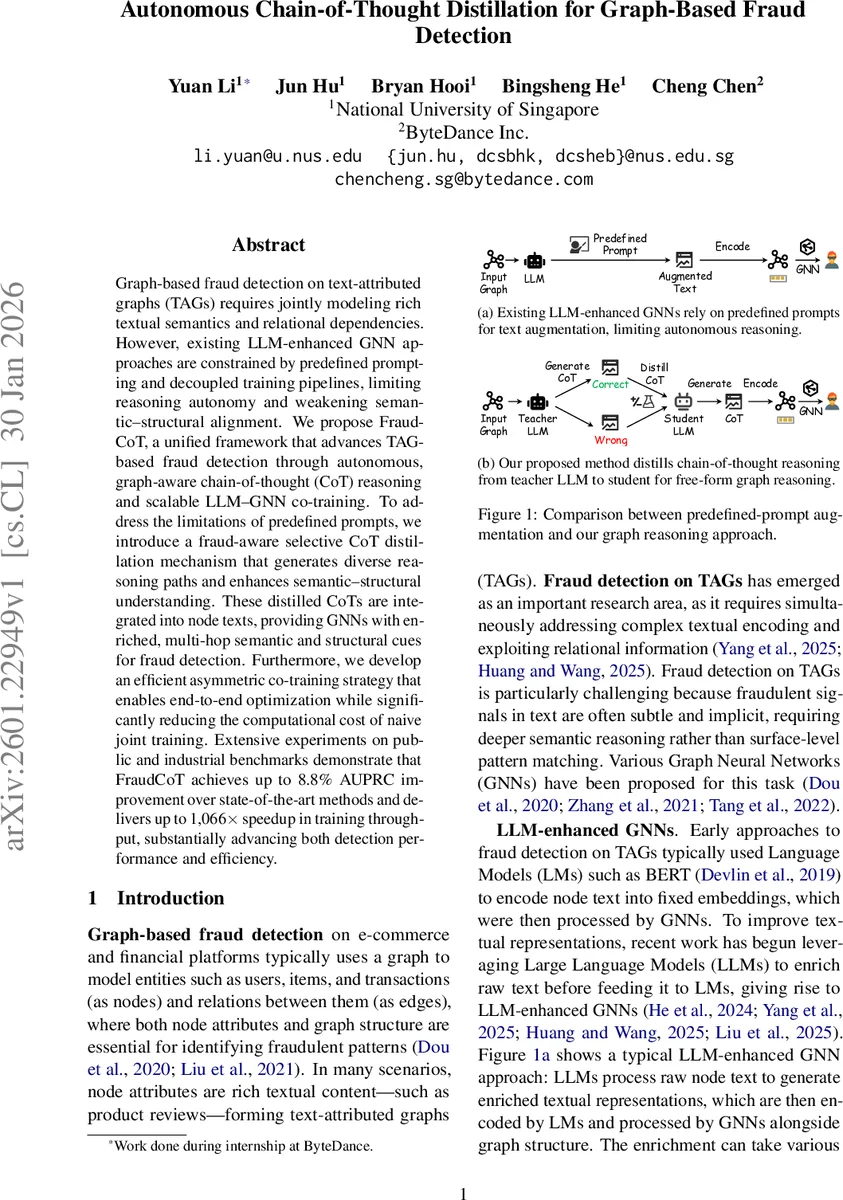

FraudCoT는 텍스트 속성 그래프에서 사기 탐지를 위해 LLM과 GNN을 결합한 프레임워크이다. 사전 정의된 프롬프트 대신 교사 LLM이 자유롭게 생성한 다중 사고흐름(Chain‑of‑Thought)을 선택적으로 증류하고, 이를 노드 텍스트에 삽입해 GNN이 풍부한 의미와 구조 정보를 동시에 학습하도록 한다. 또한 비대칭 공동학습(asymmetric co‑training)으로 목표 노드와 이웃 노드의 인코딩 비용을 크게 줄여 1,000배 이상 속도 향상을 달성한다. 실험 결과, 최신 방법 대비 AUPRC가 최대 8.8% 개선되었다.

상세 분석

FraudCoT는 기존 LLM‑enhanced GNN이 안고 있던 두 가지 근본적인 한계를 동시에 해소한다. 첫 번째는 ‘프리디파인드 프롬프트’에 의존해 LLM이 얕은 패턴 매칭에 머무는 문제다. 저자는 교사 LLM(예: DeepSeek‑R1)을 이용해 각 노드와 그 이웃 구조를 포함한 프롬프트를 자동 생성하고, S개의 다양한 사고흐름을 도출한다. 이때 정답 라벨과 일치하는 흐름은 ‘양성’, 불일치하는 흐름은 ‘음성’으로 라벨링해 긍정·부정 경로를 모두 학습에 활용한다는 점이 핵심이다. 양성 흐름은 올바른 논리 전개를, 음성 흐름은 오류 패턴을 학생 LLM에 명시적으로 학습시켜, 단순 출력 모방을 넘어 ‘추론 과정 자체’를 전달한다. 손실 함수는 교차 엔트로피(CE)와 부정 가능성 손실(UL)을 가중합한 형태로, CE는 양성 흐름 재현을, UL은 음성 흐름 억제를 담당한다. 파라미터 효율성을 위해 LoRA 어댑터를 적용, 전체 모델 크기를 크게 늘리지 않으면서도 고품질 추론 능력을 전이한다.

두 번째 한계는 LLM과 GNN이 별도 단계에서 학습돼 의미‑구조 정렬이 약해지는 점이다. FraudCoT는 비대칭 공동학습(asymmetric co‑training) 전략을 도입한다. 학습 배치에서 목표 노드만 최신 LLM 인코더로 처리하고, 이웃 노드는 초기 인코딩 시점에 캐시된 임베딩을 재사용한다. 이렇게 하면 목표‑이웃 간의 정보 흐름은 유지하면서 LLM 호출을 O(|N(v)|) → O(1) 로 감소시켜, 대규모 그래프에서도 실시간 학습이 가능해진다. GNN은 이러한 혼합 임베딩을 받아 메시지 패싱을 수행하고, 최종 사기 확률을 예측한다. 전체 파이프라인은 엔드‑투‑엔드로 미분 가능하므로, 의미와 구조가 동시에 최적화된다.

실험에서는 공개 데이터셋과 ByteDance 내부 사기 데이터 모두에서 FraudCoT가 기존 최첨단 모델(TAPE, STAR, FLAG 등) 대비 AUPRC를 4.2~8.8% 상승시켰으며, 학습 시간은 배치 크기 256 기준 9초에서 1066배 가량 가속화된 0.009초 수준으로 크게 단축되었다. 이는 특히 실시간 사기 탐지와 같은 비용 민감형 서비스에 직접 적용 가능함을 시사한다.

요약하면, FraudCoT는 (1) 자유형 사고흐름을 선택·증류해 LLM의 추론 능력을 그래프 수준으로 확장하고, (2) 비대칭 공동학습으로 의미‑구조 정렬을 유지하면서 계산 효율성을 극대화한다는 두 축을 통해 텍스트‑속성 그래프 기반 사기 탐지에 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기