다중언어 LLM 훈련 중 공유 개념 공간의 등장과 품질 탐구

초록

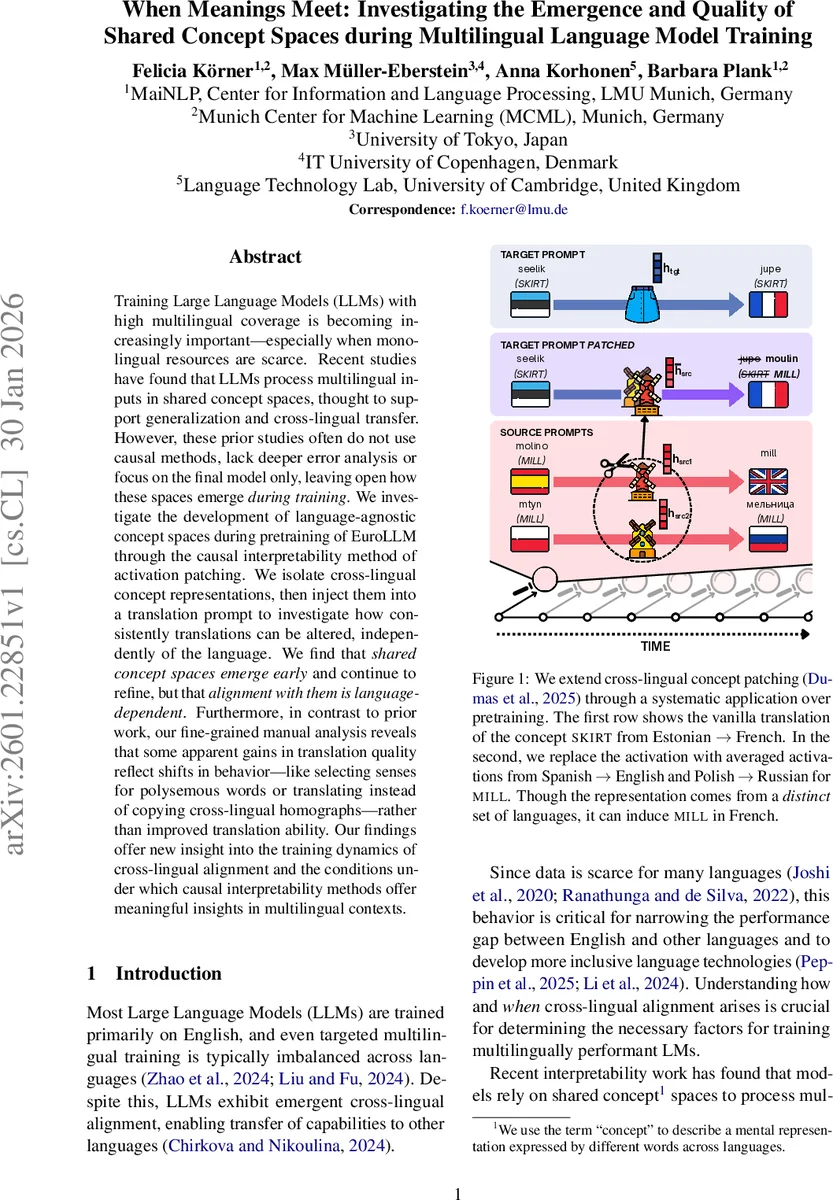

본 연구는 EuroLLM의 사전학습 과정에서 언어에 독립적인 개념 표현이 언제, 어떻게 형성되는지를 인과적 해석 기법인 activation patching을 이용해 조사한다. 여러 언어쌍에서 추출한 개념 활성화를 다른 번역 프롬프트에 삽입해 번역 결과가 바뀌는지를 측정함으로써 공유 개념 공간의 존재와 정렬 정도를 검증한다. 실험 결과, 공유 공간은 초기 단계에서 이미 형성되지만 언어별 정렬 정도는 훈련 데이터 비중에 따라 달라진다. 또한, 번역 품질 향상으로 보이는 현상이 실제 의미 선택 변화나 동형어 복사 등 행동 전환에 기인함을 수동 오류 분석을 통해 밝혀냈다.

상세 분석

이 논문은 다중언어 대형 언어 모델(LLM)에서 “공유 개념 공간(shared concept space)”이 어떻게 형성되고, 훈련 과정 중 어떤 요인에 의해 정렬(alignment)되는지를 체계적으로 탐구한다. 핵심 방법론은 인과적 메커니즘 해석 기법인 activation patching을 확장한 “cross‑lingual concept patching”이다. 구체적으로, 여러 언어쌍(예: 스페인어→영어, 폴란드어→러시아어)에서 동일한 개념(예: “MILL”)을 번역할 때 모델 내부의 특정 레이어와 이후 레이어에서 추출한 활성화 벡터를 평균화한다. 그런 다음, 전혀 다른 언어쌍(예: 에스토니아어→프랑스어)에서 전혀 다른 개념(예: “SKIRT”)을 번역하도록 프롬프트를 구성하고, 이 과정에서 앞서 평균화한 활성화를 동일 위치에 삽입한다. 만약 모델이 원래 목표였던 “SKIRT” 대신 “MILL”을 프랑스어로 출력한다면, 이는 언어에 구애받지 않는 개념 표현이 존재함을 인과적으로 증명한다.

연구는 EuroLLM‑1.7B 모델의 26개 사전학습 체크포인트를 활용한다. EuroLLM은 두 단계로 훈련되는데, 1단계에서는 웹 데이터가 주를 이루고 영어 중심의 병렬 데이터가 많이 포함되며, 2단계에서는 고품질 데이터와 다언어 병렬 데이터 비중이 크게 늘어난다. 이러한 훈련 스케줄을 고려해, 각 단계별로 공유 개념 공간의 형성과 정렬 정도를 비교한다. 결과는 다음과 같다.

-

조기 형성: 체크포인트 5~10(전체 토큰의 20% 미만)에서도 평균적인 번역 정확도가 눈에 띄게 상승한다. 이는 모델이 초기부터 언어‑특정 표현을 넘어 개념‑레벨의 추상화를 시작한다는 강력한 증거이다.

-

언어 비중 의존성: 훈련 데이터에 많이 포함된 언어(영어, 스페인어, 프랑스어 등)에서 추출한 활성화는 높은 성공률을 보였으며, 반대로 데이터가 희박한 언어(에스토니아어, 핀란드어 등)에서는 패치 성공률이 현저히 낮았다. 이는 공유 공간 자체는 존재하지만, 각 언어가 그 공간에 얼마나 잘 정렬되는지가 데이터 비중에 크게 좌우된다는 점을 시사한다.

-

단계별 차이: 2단계 진입 이후(90% 토큰 이후)에는 특히 출력 언어가 러시아어나 중국어와 같이 스크립트가 다른 경우에도 패치 성공률이 상승한다. 이는 다언어 병렬 데이터가 모델에게 “공통 개념 → 다양한 스크립트” 매핑을 학습시키는 역할을 함을 의미한다.

-

오류 유형 분석: 자동화된 첫 토큰 확률 측정만으로는 실제 번역 품질을 정확히 평가하기 어렵다. 저자들은 전체 토큰 시퀀스 기반의 정확도 지표와 함께, 400여 개 샘플에 대한 수동 오류 분석을 수행했다. 주요 오류는 (a) 다의어의 의미 선택이 바뀐 경우, (b) 동일 형태소를 가진 동형어를 복사하는 대신 번역한 경우, (c) 패치된 개념이 부분적으로만 반영돼 원래 의미와 혼합된 출력이 생성된 경우 등이다. 특히, “polysemous” 단어에서 의미 전환이 일어나면서 번역 정확도가 높아 보이지만 실제 의미 전달은 손상되는 현상이 관찰되었다.

-

제어 실험: en→en 복사 작업을 컨트롤로 사용했을 때는 거의 100% 성공률을 보였다. 이는 영어가 훈련 데이터에서 압도적으로 많아 영어 기반 개념 표현이 가장 잘 정의되어 있음을 확인시켜준다.

전반적으로, 논문은 공유 개념 공간이 “초기 단계에서 급격히 형성”되고, “훈련 데이터 비중과 언어 다양성에 따라 정렬 정도가 달라진다”는 두 가지 핵심 메시지를 제시한다. 또한, 인과적 패치 기법이 다중언어 모델의 내부 메커니즘을 탐색하는 강력한 도구임을 입증하면서, 기존 연구가 놓쳤던 미묘한 행동 전환(의미 선택, 동형어 복사 등)을 드러냈다. 이러한 통찰은 향후 다국어 LLM을 설계할 때, 데이터 구성과 훈련 스케줄을 어떻게 조정해야 언어 간 일반화와 의미 일관성을 동시에 확보할 수 있는지에 대한 실질적인 가이드라인을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기