소규모 롤아웃을 위한 중앙값 기반 그룹 상대 정책 최적화

초록

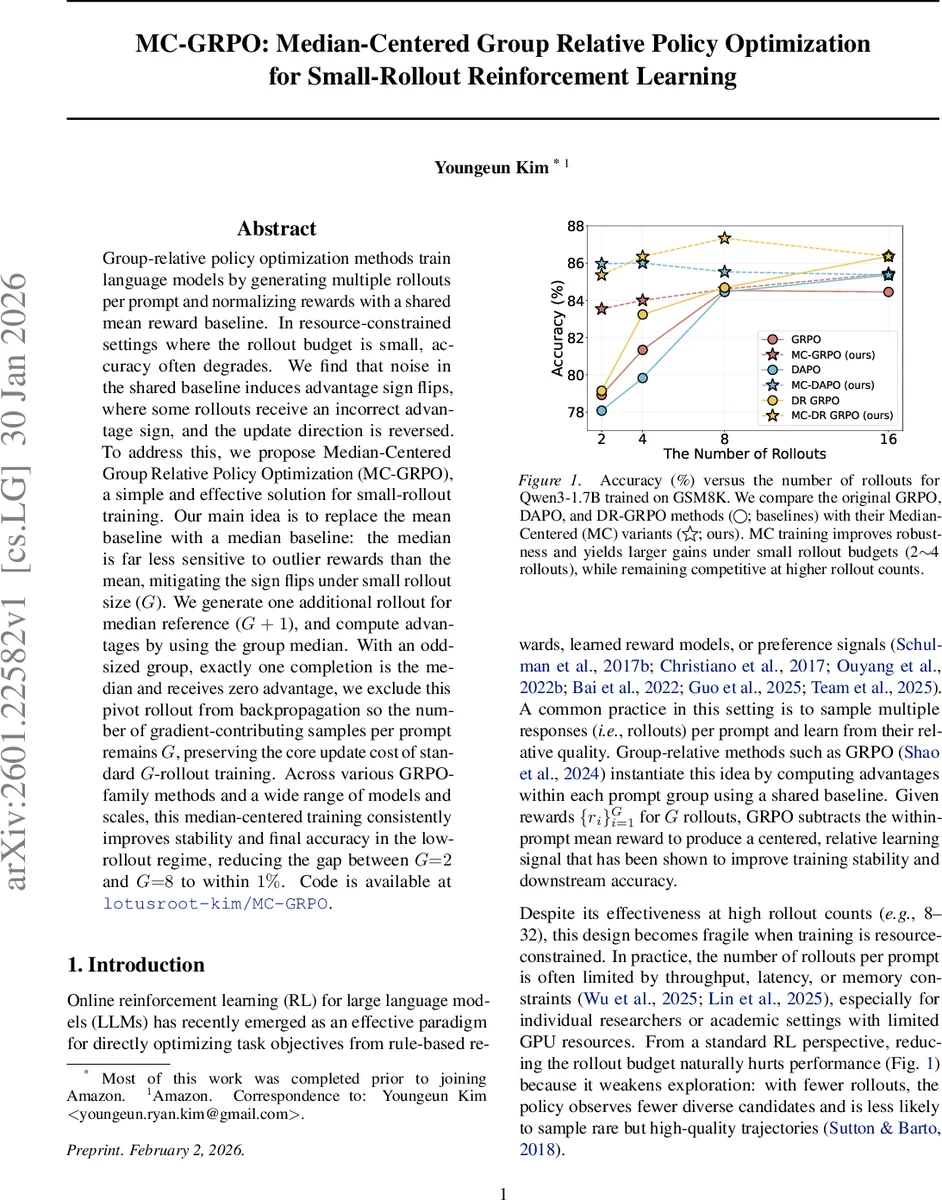

본 논문은 언어 모델 강화학습에서 롤아웃 수가 제한될 때 발생하는 ‘이점(sign) 뒤집힘’ 문제를 해결하기 위해 평균 대신 중앙값을 기준으로 하는 MC‑GRPO 기법을 제안한다. 추가 롤아웃 1개를 생성해 홀수 개의 샘플을 만들고, 중앙값을 기준으로 이점을 계산·정규화한다. 중앙값 샘플은 0 이점을 갖게 되므로 학습에 제외해도 전체 업데이트 비용은 기존 G‑롤아웃과 동일하다. 다양한 모델·데이터셋과 GRPO‑계열 알고리즘에 적용했을 때, 특히 G=2,4와 같은 소규모 롤아웃 상황에서 정확도가 크게 향상되고 학습 안정성이 개선된다.

상세 분석

그룹 상대 정책 최적화(GRPO) 계열은 동일 프롬프트에 대해 여러 개의 응답(롤아웃)을 생성하고, 그 보상들의 평균을 공유 베이스라인으로 사용해 이점을 정규화한다. 평균은 표본 수가 적을 때 외부값에 민감해져, 하나의 고보상 샘플이 전체 평균을 크게 이동시킬 수 있다. 이 경우 평균보다 낮은 보상의 샘플도 평균이 상승하면서 이점이 음수에서 양수로 바뀌는 ‘sign flip’ 현상이 발생한다. 논문은 이러한 현상이 실제 학습 성능 저하와 직접적인 인과관계를 갖는다는 것을 실험적으로 입증한다(예: 5 %의 sign flip이 약 4 % 정확도 감소를 초래).

이 문제를 해결하기 위해 저자들은 ‘중앙값 기반’ 베이스라인을 도입한다. 중앙값은 외부값에 강인한 위치 추정량으로, 소규모 샘플에서도 평균보다 변동이 적다. 구현 방식은 기존 G개의 롤아웃에 추가로 하나를 더 생성해 G+1개의 홀수 샘플을 만든 뒤, 그 중 중앙값에 해당하는 샘플을 베이스라인으로 사용한다. 중앙값 샘플은 이점이 0이 되므로 학습 그래디언트에 기여하지 않으며, 이를 제외함으로써 실제로 업데이트에 사용되는 샘플 수는 여전히 G개가 된다. 따라서 추가 연산 비용은 하나의 추론만 추가되는 수준으로, 고성능 추론 엔진(vLLM 등)에서는 무시할 수 있다.

또한 중앙값 주변의 변동성을 측정하기 위해 평균 대신 Median Absolute Deviation(MAD)를 사용한다. MAD 역시 평균 표준편차보다 외부값에 덜 민감해, 정규화 과정에서도 안정성을 제공한다. 이렇게 정의된 이점 A_i = (r_i – median)/ (MAD + ε) 를 기존 GRPO, DAPO, DR‑GRPO 등 다양한 손실 함수에 그대로 대입하면, 알고리즘 구조를 크게 바꾸지 않고도 바로 적용 가능하다.

실험에서는 Qwen3‑1.7B, Llama‑3.2‑3B, Qwen2.5‑7B 등 여러 규모의 모델을 대상으로 GSM8K, Math‑500, AMC 2023, AIME 2024 등 수학 추론 데이터셋에 적용하였다. 특히 G=2,4인 경우 MC‑GRPO는 기존 GRPO 대비 4~6 % 정확도 상승을 보였으며, G=8 이상의 큰 롤아웃에서도 성능 격차를 거의 없앴다. Sign flip 비율 역시 평균 기반 대비 현저히 낮아졌고, 이는 학습 과정에서 올바른 방향으로의 업데이트 비율이 증가했음을 의미한다. 전체적으로 MC‑GRPO는 소규모 롤아웃 환경에서의 불안정성을 완화하고, 동일한 연산 비용으로 높은 성능을 달성하는 간단하면서도 효과적인 방법임을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기