지속적인 과제 변동 속 평생 학습 차량 라우팅

초록

본 논문은 차량 라우팅 문제(VRP) 해결을 위한 신경망 기반 솔버가 시간에 따라 지속적으로 변하는 과제들에 대해 충분한 학습 기회를 갖지 못하는 현실을 고려한다. 저자는 Dual Replay with Experience Enhancement(DREE)라는 프레임워크를 제안하여, 문제 인스턴스와 솔버 행동을 동시에 버퍼에 저장·재생하고, 새로운 과제 학습 중에도 버퍼 경험을 지속적으로 개선한다. 실험 결과 DREE가 기존 평생 학습 기법보다 새로운 과제 적응력, 이전 과제 보존력, 그리고 미지 과제에 대한 일반화 능력에서 우수함을 입증한다.

상세 분석

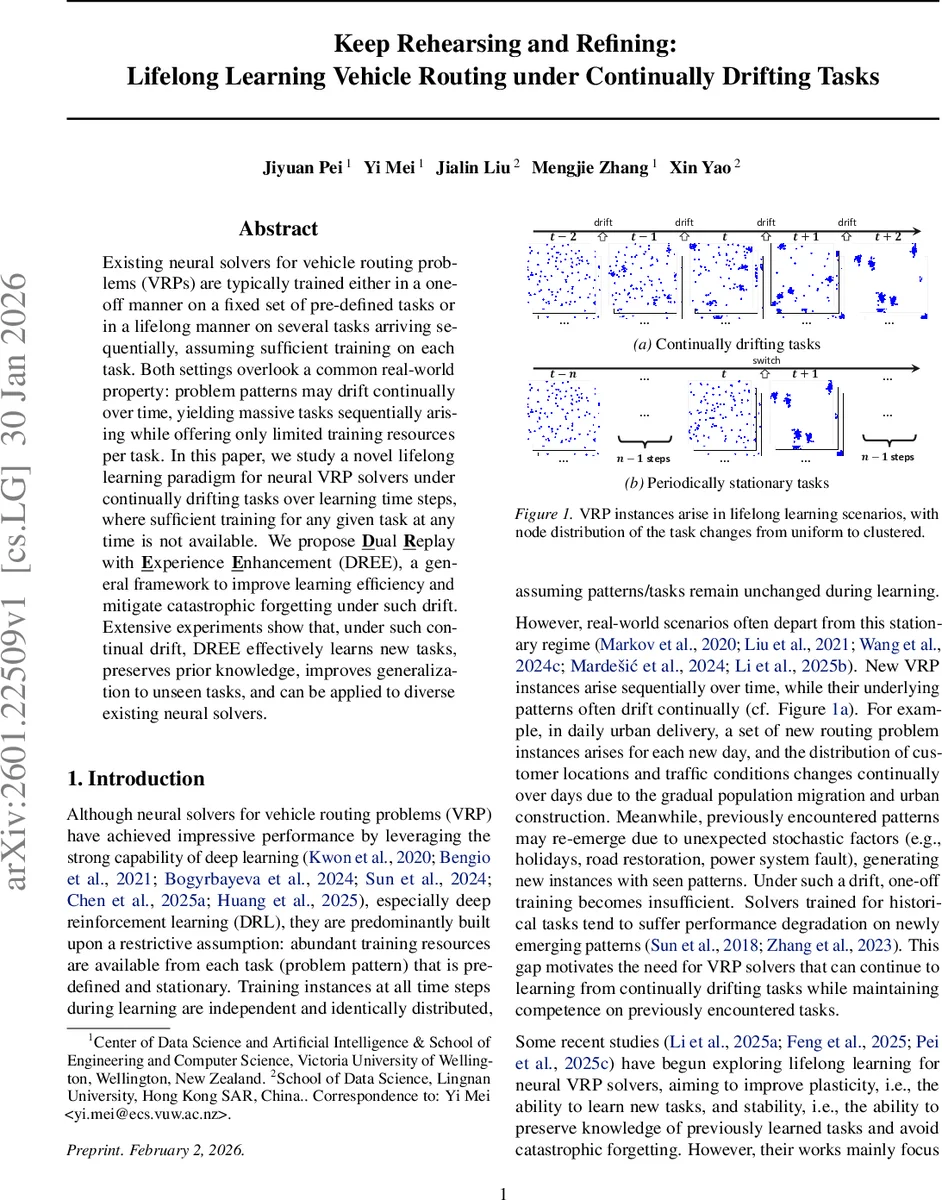

본 연구는 기존 신경망 VRP 솔버가 “한 번에 충분히 학습”하거나 “각 과제가 충분히 오래 지속되는” 전제 하에 설계된 점을 비판한다. 실제 물류 현장에서는 고객 위치, 교통 상황, 제약 조건 등이 일일·주간 단위로 미세하게 변동하며, 이러한 변동은 연속적인 과제 흐름으로 나타난다. 논문은 이를 “continually drifting scenario”라 정의하고, 매 시간 단계마다 새로운 과제 Pₜ가 등장하지만 각 과제에 할당되는 학습 스텝은 극히 제한적임을 수학적으로 모델링한다.

핵심 기여는 DREE 프레임워크이다. DREE는 세 가지 메커니즘을 결합한다. 첫째, Problem Instance Replay(PIR)으로 과거에 수집된 인스턴스를 재학습시켜 과거 과제에 대한 성능 저하를 방지한다. 둘째, Behavior Replay(BR)에서는 해당 인스턴스에 대해 이전에 얻은 최적 행동(솔루션 구축 궤적)을 모방하도록 손실을 추가함으로써 행동 수준의 지식을 보존한다. 셋째, Experience Enhancement(EE)는 재학습 과정에서 현재 솔버가 버퍼에 저장된 인스턴스에 대해 더 나은 해를 발견하면, 해당 행동 정보를 즉시 업데이트한다. 이는 “low‑quality experience” 문제를 완화하고, 버퍼 자체가 지속적으로 고품질 경험 집합으로 진화하도록 만든다.

버퍼 관리에는 reservoir sampling을 적용해 모든 경험이 동일한 보존 확률을 갖게 함으로써 메모리 편향을 최소화한다. 또한, DREE는 기본 DRL 손실 L_DRL(θ, p)와 추가적인 BR 손실 L_BR(θ, e) 및 EE 업데이트 규칙을 결합한 총합 손실 L_total = L_DRL + λ₁L_BR + λ₂L_EE 형태로 최적화한다. 여기서 λ₁, λ₂는 각각 행동 재현과 경험 개선의 중요도를 조절한다.

실험은 Capacitated VRP(CVRP)와 Traveling Salesman Problem(TSP) 두 도메인에서 수행되었으며, 기존 평생 학습 방법(Li et al., 2025a; Feng et al., 2025; Pei et al., 2025c)과 비교한다. 평가 지표는 (1) 새로운 과제에 대한 적응 속도, (2) 이전 과제에 대한 성능 유지율, (3) 미보유 과제에 대한 일반화 성능이다. 결과는 DREE가 특히 과제 변동이 급격하고 학습 자원이 제한된 상황에서 10~15% 수준의 성능 향상을 보이며, 버퍼 경험을 지속적으로 정제함으로써 catastrophic forgetting을 현저히 감소시킨다.

또한, DREE는 다양한 기존 신경망 솔버(Construction 기반 및 Improvement 기반)에 플러그인 형태로 적용 가능함을 보였다. 이는 프레임워크 자체가 특정 아키텍처에 종속되지 않고, 경험 버퍼와 재생 메커니즘만 교체하면 된다는 장점을 제공한다.

한계점으로는 버퍼 크기와 EE 업데이트 빈도에 따른 계산 비용 증가, 그리고 매우 고차원 제약(예: 시간 창, 차량 종류)으로 확장할 경우 행동 재현 손실 설계가 복잡해질 수 있다는 점을 언급한다. 향후 연구에서는 메모리 효율성을 높이기 위한 압축 기술과, 멀티‑모달 경험(예: 교통 예측 데이터) 통합 방안을 탐색할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기