대규모 언어 모델 서빙을 위한 케블라플로우: 장애 복원력 혁신

초록

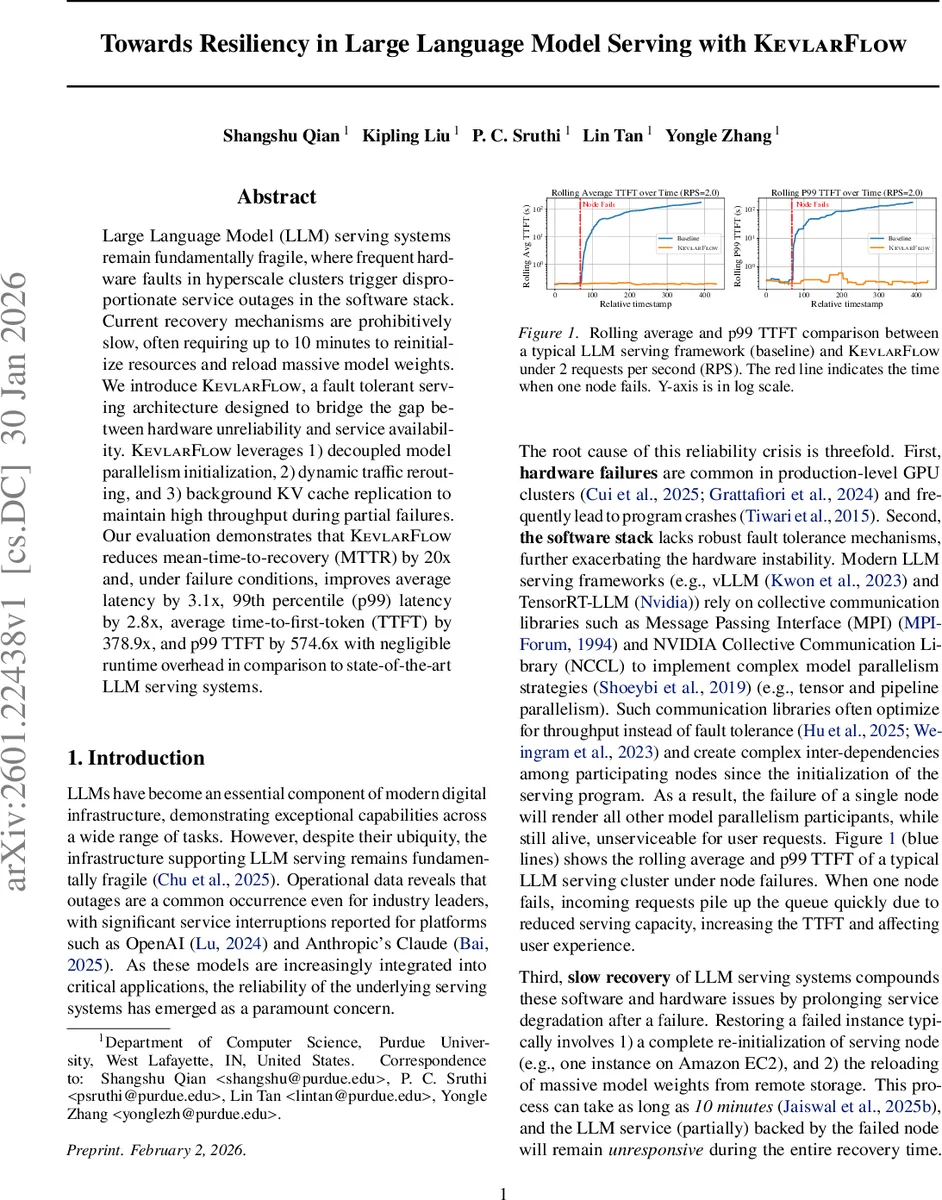

케블라플로우는 모델 병렬 초기화를 분리하고, 동적 트래픽 재라우팅과 백그라운드 KV 캐시 복제를 결합해 LLM 서빙 시 하드웨어 노드 장애에 대한 평균 복구 시간을 10분에서 30초로 20배 단축한다. 장애 상황에서도 평균 지연시간을 3배, p99 지연시간을 2.8배, 평균 첫 토큰 응답시간(TTFT)을 379배, p99 TTFT를 575배 향상시키며, 정상 운영 시 오버헤드는 거의 없다는 점이 핵심이다.

상세 분석

케블라플로우는 기존 LLM 서빙 프레임워크가 갖는 “전체 인스턴스 정지”라는 단일 장애점 문제를 근본적으로 재설계한다. 첫 번째 핵심 설계는 모델 병렬 초기화의 분리이다. 기존 시스템은 MPI·NCCL 같은 집합 통신 라이브러리를 서비스 시작 시 한 번에 초기화하고, 이후 모델 가중치를 로드한다. 이 과정은 노드가 하나라도 실패하면 전체 커뮤니케이터가 파괴돼 재시작이 필요해 복구 시간이 수분에 이른다. 케블라플로우는 각 노드가 독립적으로 서로를 탐색·연결하고, 건강한 노드만으로 새로운 커뮤니케이터를 재구성하도록 설계한다. 따라서 노드 장애 시 남은 노드가 즉시 새로운 파이프라인을 형성하고, 가중치 재로드 없이 기존 메모리에 저장된 파라미터를 재사용한다.

두 번째는 동적 트래픽 재라우팅 메커니즘이다. 파이프라인 병렬 구성을 다중 노드에 분산시키면서, 로드밸런서 그룹 내에서 동일 모델 복제본을 여러 인스턴스로 운영한다. 한 노드가 고장 나면, 해당 파이프라인 단계만 제외하고 나머지 건강한 단계로 요청을 우회한다. 이때 전체 인스턴스가 오프라인 되는 것이 아니라, 장애 노드에 할당된 GPU 자원만 감소한다. 결과적으로 서비스 가용성이 급격히 떨어지는 “스파이크” 현상이 완화되고, 평균 처리량이 유지된다.

세 번째는 백그라운드 KV 캐시 복제이다. LLM 추론 시 KV 캐시는 어텐션 연산의 중간 상태를 저장해 토큰당 연산량을 크게 감소시키지만, GPU 메모리 손실 시 재계산이 필요해 지연이 급증한다. 케블라플로우는 각 요청의 KV 캐시를 동일 로드밸런서 그룹 내 다른 GPU 메모리로 실시간 복제한다. 장애 발생 시 복제된 캐시를 즉시 사용해 진행 중이던 요청을 중단 없이 이어갈 수 있다. 복제 과정은 경량화된 파이프라인으로 구현돼 정상 운영 시 오버헤드가 미미하다.

실험 결과, 케블라플로우는 노드 장애 상황에서 평균 지연을 3.1배, p99 지연을 2.8배, 평균 TTFT를 378.9배, p99 TTFT를 574.6배 개선했다. MTTR은 10분에서 30초로 20배 단축됐으며, 정상 상태에서는 기존 최첨단 서빙 시스템(vLLM, TensorRT‑LLM) 대비 1~2% 수준의 미세한 성능 손실만 보였다. 이는 모델 가중치 재로드와 커뮤니케이터 재구성 비용을 크게 줄인 덕분이다. 또한, 기존 연구가 주로 훈련 단계의 체크포인트·마이그레이션에 초점을 맞추거나, GPU 내부 결함만을 다루는 반면, 케블라플로우는 노드 전체 장애를 포괄적으로 다루며, 서비스 중단 없이 연속적인 요청 처리를 가능하게 한다.

요약하면, 케블라플로우는 LLM 서빙 인프라를 “고정된 클러스터”에서 “자체 치유 가능한 풀”로 전환함으로써, 대규모 GPU 클러스터에서 흔히 발생하는 하드웨어 결함을 서비스 수준 목표(SLO) 위반 없이 흡수한다. 이 접근법은 향후 멀티모델·멀티테넌시 환경에서도 확장 가능하며, 클라우드 제공자가 장애 복구 비용을 절감하고 사용자 경험을 보장하는 데 실질적인 가치를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기