정체성과 협력: 실제 인간과 시뮬레이션된 인간 그룹 내 프레이밍 효과

초록

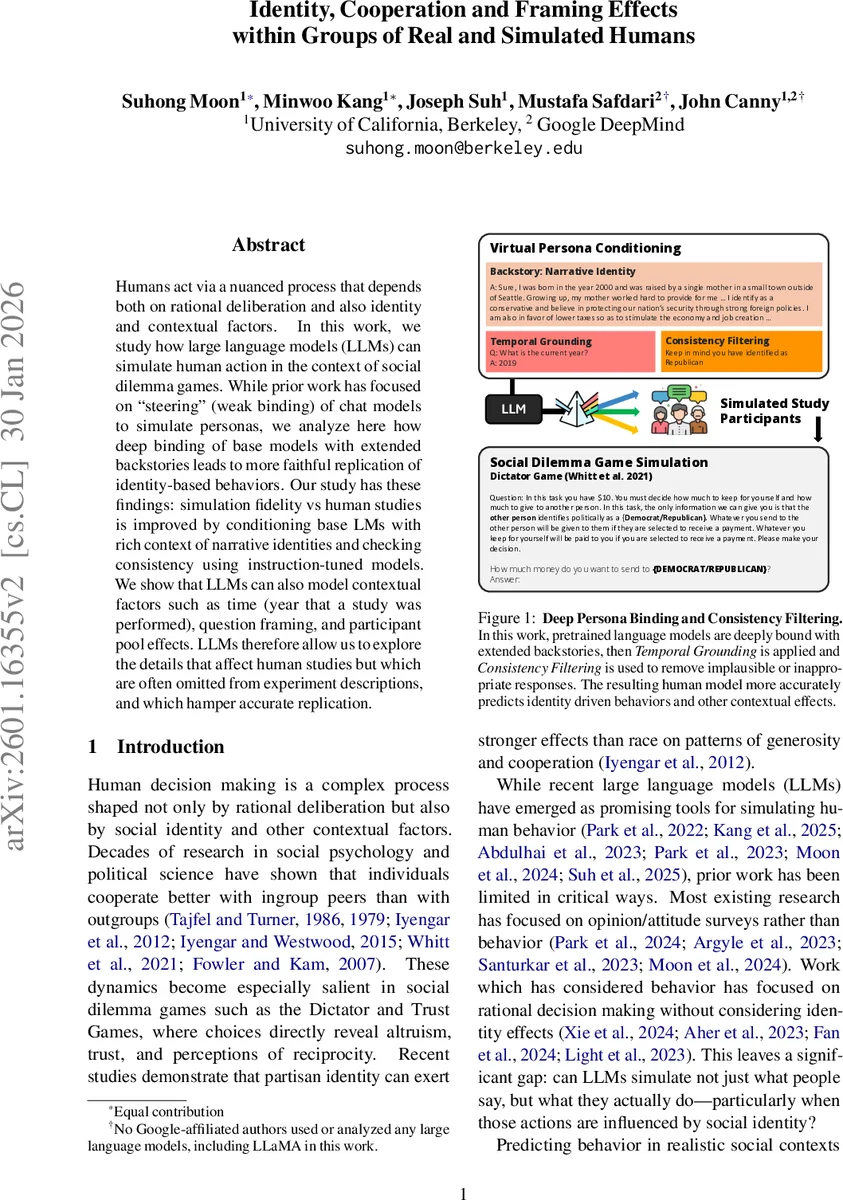

이 연구는 대규모 언어 모델(LLM)이 사회적 딜레마 게임에서 인간의 정체성 기반 행동을 얼마나 정확하게 시뮬레이션할 수 있는지 탐구합니다. 기존의 피상적인 ‘페르소나 설정’을 넘어, 기본 모델에 풍부한 내러티브 백스토리를 ‘깊게 결합’하고 일관성 필터링 및 시간적 고정 기법을 적용하면, 인간 연구 데이터와의 시뮬레이션 정확도가 크게 향상됨을 보여줍니다. LLM은 연구 연도, 질문 프레이밍, 참가자 풀 효과 같은 미묘한 맥락적 요소도 모델링할 수 있어, 실험 재현의 정확성을 방해하는 자주 생략되는 세부 사항들을 탐구하는 도구로 활용될 수 있습니다.

상세 분석

이 논문의 핵심 기술적 통찰은 인간 시뮬레이션을 위한 LLM 선택과 조건 설정 방법론에 있습니다. 저자들은 사전 학습된 기본 모델(PT)이 지시 튜닝된 모델(IT)보다 인간 행동 모방에 훨씬 우수함을 강조합니다. 그 이유는 PT 모델의 학습 데이터가 수십억 개의 텍스트 스니펫으로 구성되어 있으며, 이는 각기 다른 화자, 청자, 맥락의 ‘목소리’를 내재적으로 포함하고 있기 때문입니다. 따라서 충분한 맥락(예: 상세한 백스토리)을 프롬프트로 제공하면, PT 모델은 특정 화자의 관점에서 텍스트를 자연스럽게 확장할 수 있습니다. 반면, IT 모델은 ‘도움이 되는 에이전트’라는 단일 정체성으로 고정되고, 사용자 정체성과 맥락 표현의 다양성이 크게 줄어들어, 인간 집단의 다양한 특성을 공정하게 대표하지 못하는 ‘레이크 웨비곤 효과’(모두가 평균 이상)를 초래합니다. 실제로 Reddit 대화 데이터에 대한 실험에서 IT 모델은 PT 모델보다 50-100% 높은 퍼플렉시티(낮은 정확도)를 보였습니다.

이러한 PT 모델의 장점을 활용하기 위해, 논문은 ‘깊은 페르소나 결합’ 방법론을 제시합니다. 이는 미국 목소리 프로젝트 설문을 기반으로 생성된 길고 상세한 내러티브 백스토리를 모델 조건 설정에 사용합니다. 여기에 두 가지 핵심 기법이 추가됩니다: 1) 시간적 고정: 원본 인간 연구가 수행된 연도를 프롬프트에 명시적으로 포함시켜(예: “현재 연도는 2007년입니다”), 시간에 따른 태도 변화(예: 정치적 양극화 증가)를 반영합니다. 2) 일관성 필터링: 시뮬레이션 중 주기적으로 페르소나의 정체성(예: “당신은 공화당원으로서…")을 상기시키는 프롬프트를 추가하여, PT 모델이 장문 생성 중 겪을 수 있는 의미적 표류 또는 비대화체 출력을 방지합니다.

실험 결과, 이러한 방법론을 적용한 PT 모델은 독재자 게임과 신뢰 게임에서 인간 참가자들이 보인 ‘동일 정당 편향’(코파티산에게 더 많이 주는 현상)을 높은 정확도로 재현했습니다. 더 나아가, 서로 다른 연도(2007년 vs. 2021년)에 수행된 유사 연구 간의 미묘한 결과 차이를 LLM 시뮬레이션을 통해 탐구할 수 있음을 보였습니다. 이는 LLM이 실험 설명서에 자주 생략되지만 결과에 영향을 미치는 ‘숨겨진 변수’(참가자 풀 특성, 지시문의 미세한 표현 차이 등)를 체계적으로 분석하는 강력한 도구가 될 수 있음을 시사합니다. 결국, 이 연구는 LLM 기반 사회과학 시뮬레이션의 정확성과 공정성을 높이기 위해서는 모델 선택(PT over IT)과 정교한 조건 설정 방법론이 필수적임을 입증합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기