논리점수: 속성 질문응답의 완전성·간결성·확정성 정밀 평가

초록

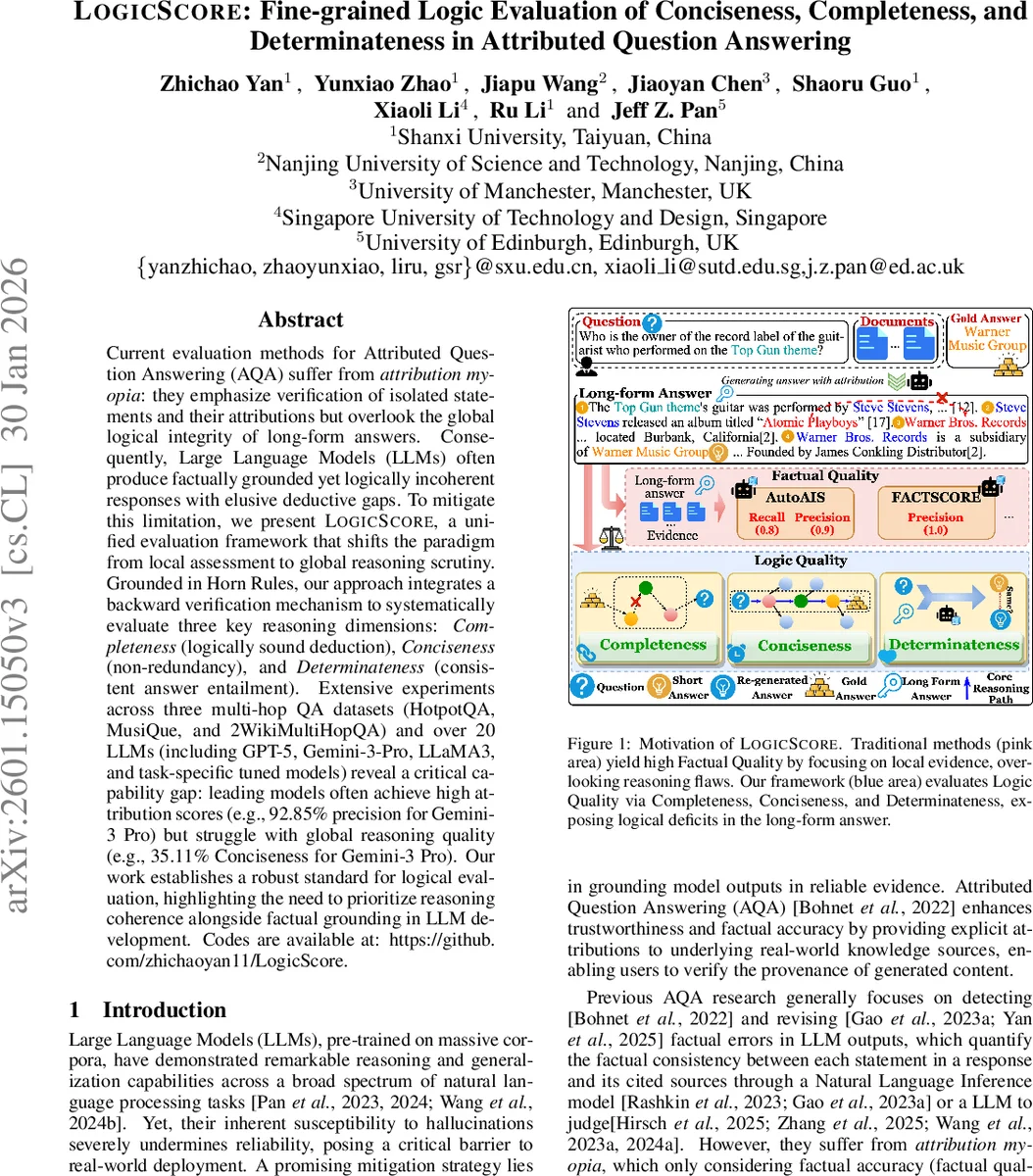

본 논문은 속성 질문응답(AQA)에서 기존의 사실·출처 검증에만 초점을 맞춘 평가 방식이 논리적 일관성을 놓친다는 문제를 지적한다. 이를 해결하기 위해 Horn 규칙 기반의 역방향 검증 메커니즘을 도입한 LogicScore 프레임워크를 제안한다. LogicScore는 장문 답변을 ‘완전성(Completeness)’, ‘간결성(Conciseness)’, ‘확정성(Determinateness)’ 세 축으로 정량화하여 전역적인 추론 품질을 측정한다. 세 가지 멀티홉 QA 데이터셋과 20여 개 LLM에 대한 실험 결과, 최신 모델들이 높은 사실 정확도에도 불구하고 논리적 일관성 점수가 현저히 낮음이 확인되었다.

상세 분석

LogicScore는 속성 질문응답(Attributed Question Answering, AQA)에서 “논리적 무결성”을 정량화하려는 최초의 시도라 할 수 있다. 기존 평가 지표는 주로 개별 문장의 사실성 및 해당 출처의 정확성을 NLI 모델이나 LLM‑as‑judge 방식으로 측정했으며, 이를 ‘attribution precision/recall’이라고 부른다. 그러나 이러한 접근은 답변 전체가 하나의 일관된 추론 사슬을 형성하는지를 전혀 검증하지 못한다. 논문은 이를 “attribution myopia”라 명명하고, 장문 답변이 사실은 맞지만 논리적 비약, 중복, 혹은 결함을 포함할 경우 사용자는 여전히 오해를 할 수 있음을 강조한다.

핵심 아이디어는 Horn 규칙을 이용해 답변을 ‘전제 → 결론’ 형태의 논리식으로 변환하고, 이를 역방향으로 추적해 질문‑답변 간의 완전한 연결 고리를 찾는 것이다. 구체적으로, (1) **완전성(Completeness)**은 금골(answer entity)에서 질문 엔티티까지 연속적인 Horn 체인을 찾을 수 있는지 여부를 0/1로 판단한다. 역방향 체인 구성 단계에서는 각 전제를 (주어, 관계, 객체) 삼중항으로 파싱하고, 공유 객체를 통해 체인을 확장한다. (2) **간결성(Conciseness)**은 발견된 최소 연결 체인(P_min)의 길이를 전체 전제 수(P)로 나눈 비율로 정의한다. 즉, 불필요하거나 무관한 전제가 많을수록 점수가 낮아진다. (3) **확정성(Determinateness)**은 전체 장문 답변을 전제로 삼아 동일한 질문에 대해 LLM이 독립적으로 도출한 새로운 단답이 원래 단답과 일치하는지를 검증한다. 이는 ‘Self‑Consistency’와 유사한 재추론 메커니즘을 활용한다.

실험에서는 HotpotQA, MusiQue, 2WikiMultiHopQA 세 멀티홉 QA 벤치마크와 GPT‑5, Gemini‑3‑Pro, LLaMA‑3 등 20여 개 최신 모델을 평가했다. 결과는 놀라웠다. 예를 들어 Gemini‑3‑Pro는 92.85%의 높은 사실‑출처 정밀도를 보였지만, 완전성 0.41, 간결성 0.35, 확정성 0.48에 불과했다. 모델 규모가 커질수록 사실 회수는 향상되지만, 불필요한 증거 제시와 논리적 중복이 증가해 간결성 점수가 오히려 감소하는 ‘스케일링 패러독스’를 발견했다. 또한, task‑specific fine‑tuned 모델들은 전반적인 사실 정확도는 낮지만, 논리적 일관성 점수는 상대적으로 높은 경향을 보였다.

이러한 결과는 LLM 개발에서 사실성만이 아니라 논리적 일관성도 동등하게 최적화해야 함을 시사한다. LogicScore는 자동화된 Horn 규칙 추출과 역방향 체인 탐색을 통해 인간 평가 비용을 크게 절감하면서도, 논리적 결함을 정밀히 진단한다. 다만, 현재 Horn 규칙 추출이 LLM에 의존하고 있어 변환 오류가 발생할 가능성이 있으며, 복잡한 비선형 추론(예: 조건부 확률, 정량적 계산)에는 적용이 제한적이라는 한계도 언급한다. 향후 연구에서는 보다 풍부한 논리 체계(예: First‑Order Logic, Probabilistic Logic)와 인간‑LLM 협업 검증을 결합해 평가 범위를 확장할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기