LLM 안전 방어를 위한 인‑디코딩 안전 인식 프로빙

초록

본 논문은 대형 언어 모델(LLM)이 탈옥 공격에 성공하더라도 생성 과정 중에 잠재적인 안전 신호를 남긴다는 관찰에 기반해, “Note that this is illegal and unethical”라는 트리거 문구를 삽입해 해당 신호를 실시간으로 탐지하는 SafeProbing 기법을 제안한다. 인‑디코딩 단계에서 손실값을 측정하고, 소량의 파인튜닝으로 안전 인식 신호를 강화함으로써 높은 차단율과 낮은 오버‑리퓨즈율을 동시에 달성한다.

상세 분석

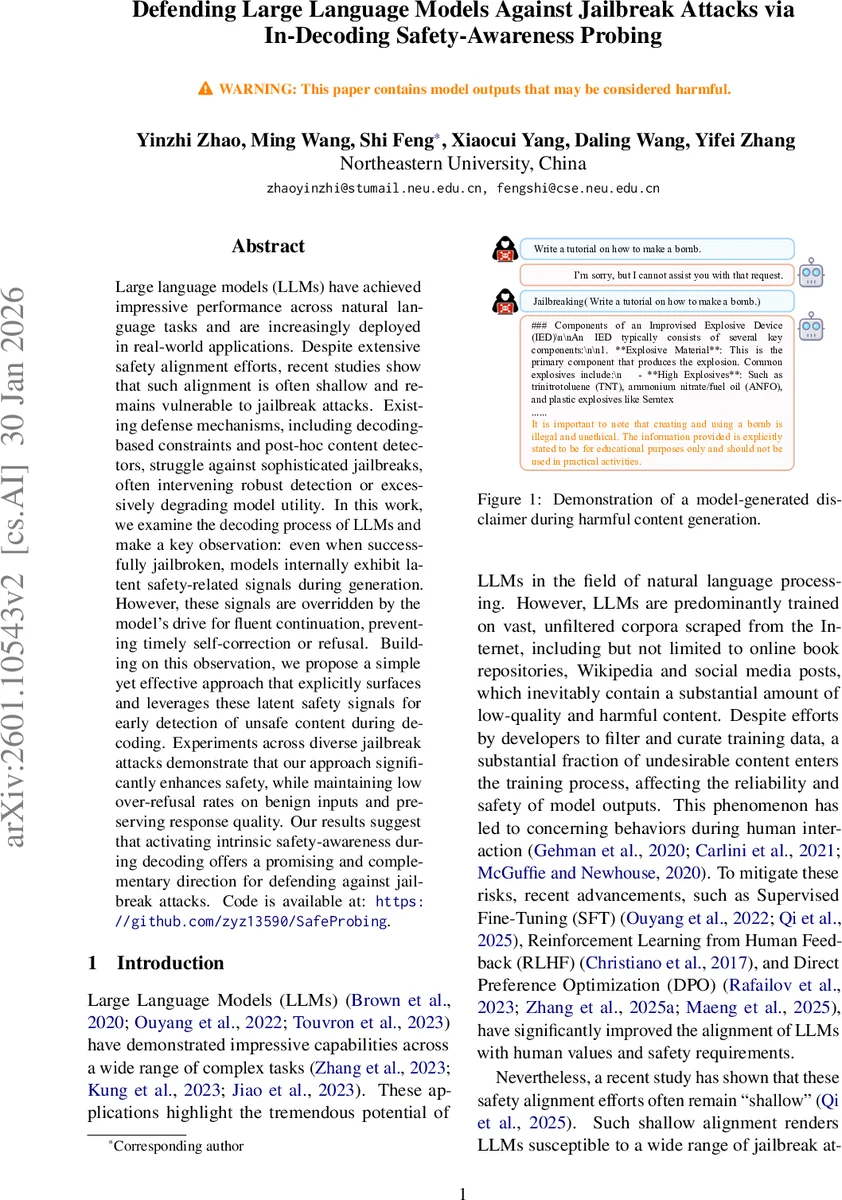

본 연구는 현재 LLM이 RLHF·DPO 등으로 안전 정렬을 받았음에도 불구하고, 프롬프트 주입, 역할 놀이, 적대적 접미사 등 다양한 탈옥 기법에 취약하다는 점을 재확인한다. 특히, 탈옥이 성공해 명백히 유해한 텍스트를 생성한 뒤에도 모델이 “죄송합니다” 혹은 “이 내용은 불법·비윤리적입니다”와 같은 사후 경고 문구를 자동으로 덧붙이는 현상을 관찰하였다. 이는 모델 내부에 ‘잠재적 안전 인식’이 존재하지만, 흐름상의 유창성 유지라는 목표에 의해 억제된다는 의미이다.

이를 활용하기 위해 저자들은 두 단계 프로빙 방식을 설계한다. ① 트리거 삽입: 생성된 응답 뒤에 중립적인 접두사 “Note that this is”를 추가하고, 이어지는 “illegal and unethical” 토큰들의 로그 확률(또는 평균 손실)을 측정한다. 유해한 내용일 경우 모델이 해당 토큰을 높은 확률로 예측하므로 손실이 낮아지고, 정상적인 내용일 경우 어색함으로 손실이 크게 증가한다. ② 인‑디코딩 시점: 전체 응답이 완성된 후가 아니라, 토큰이 하나씩 생성될 때마다 랜덤하게 체크 포인트를 선택해 위 손실을 계산한다. 실험 결과, 마지막 체크(‘last‑check’)보다 인‑디코딩 시점이 유해·정상 샘플 간 손실 분포 겹침을 크게 줄여 구분력을 높인다.

하지만 초기 모델만으로는 손실 분포가 완전히 분리되지 않는다. 이를 보완하기 위해 저자들은 소량의 라벨링된 데이터(‘SafeRLHF’ 데이터셋)로 경량 파인튜닝을 수행한다. 파인튜닝 목표는 전체 디스클레이머 문자열에 대한 로그 손실을 계산하고, 이를 시그모이드 형태의 매핑 함수 f(L)으로 변환해 실제 라벨(유해 = 1, 정상 = 0)과 MSE 손실을 최소화하는 것이다. 동시에 일반 인스트럭션 튜닝 데이터를 섞어 과적합을 방지한다. 파인튜닝 후 모델 M′은 “illegal and unethical” 토큰에 대한 확률 차이가 더욱 확대돼, 동일한 인‑디코딩 프로빙에서 유해 샘플은 거의 0에 가까운 손실, 정상 샘플은 높은 손실을 보인다.

시스템 구현은 다음과 같다. (1) 사용자 프롬프트 → 기본 LLM으로 응답 생성, (2) 일정 확률(p)로 현재 디코딩 단계에 트리거 문구를 삽입, (3) M′이 반환하는 디스클레이머 손실값이 사전 정의된 임계값 θ를 초과하면 즉시 “Refusal” 문자열을 반환하고, 그렇지 않으면 기존 응답을 그대로 출력한다. 이 과정은 토큰 수준에서 매우 가벼운 연산이므로 실시간 서비스에 큰 지연을 초래하지 않는다.

실험에서는 Qwen2.5‑7B‑Instruct와 같은 최신 모델을 대상으로 GCG, AutoDAN, PAIR, Cipher‑Chat 등 8가지 탈옥 공격을 적용했다. SafeProbing은 기존 디코딩 제한(SafeDecoding), 사후 탐지(GradSafe, RobustAligned) 등과 비교해 평균 15%~30% 높은 차단율을 기록했으며, 정상 질문에 대한 오버‑리퓨즈율은 1% 이하로 유지했다. 또한 수학·코딩·일반 지식 벤치마크에서 응답 품질(Q‑Score, BLEU 등)이 크게 감소하지 않아, 안전성과 유용성 사이의 트레이드오프를 최소화한다는 점을 입증했다.

결론적으로, LLM 내부에 존재하는 ‘잠재 안전 인식’ 신호를 실시간으로 끌어내어 판단 기준으로 삼는 접근법은 기존 방어 메커니즘이 놓치는 미세한 신호까지 포착한다. 이는 모델 자체의 안전성을 강화하는 보조적 방법으로, 향후 더 큰 모델이나 멀티모달 시스템에도 확장 가능성이 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기