딥리서치 벤치마크 II: 전문가 보고서 기반 세밀 평가 체계

초록

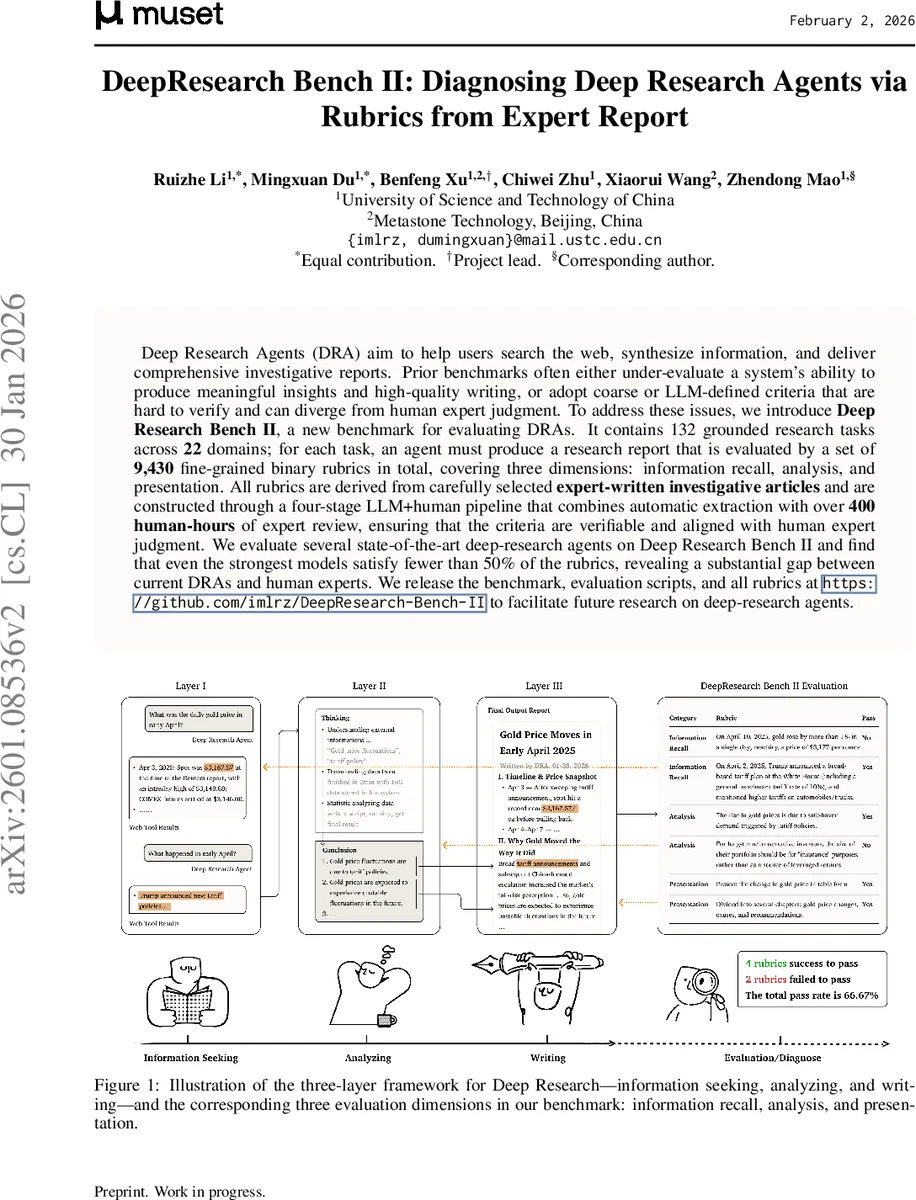

딥리서치 벤치마크 II는 22개 분야의 132개 실제 연구 과제를 제공하고, 각 과제당 평균 71개의 이진형 세부 루브릭(총 9,430개)으로 모델이 생성한 보고서를 평가한다. 루브릭은 전문가 보고서에서 자동·수동으로 추출·정제했으며, 정보 회수, 분석, 프레젠테이션 3가지 차원을 측정한다. 실험 결과 최신 딥리서치 에이전트조차 루브릭 통과율이 50% 미만으로, 인간 전문가와 큰 격차가 있음을 보여준다.

상세 분석

본 논문은 딥리서치 에이전트(DRA)의 실질적인 성능을 정량화하기 위해 ‘세밀하고 검증 가능한 루브릭 기반 평가’를 제안한다. 기존 벤치마크는 고정형 정답(예: 엔터티, 수치)만을 요구하거나, LLM이 자체 정의한 거친 기준에 의존해 인간 전문가와의 정렬 문제가 있었다. 이에 저자들은 4단계 LLM + Human 파이프라인을 설계했다. 첫 단계에서는 대형 언어 모델을 이용해 원본 전문가 보고서에서 과제와 루브릭을 자동 추출한다. 두 번째 단계에서는 자체 평가 루프를 통해 추출된 루브릭이 원문을 충분히 커버하는지(정보 회수·분석 정확도 ≥ 90%)를 검증하고, 부족하면 재생성한다. 세 번째 단계에서는 인간 annotator가 루브릭의 원자성, 명확성, 검증 가능성을 검토·수정한다. 마지막 단계에서는 도메인 전문가가 최종 검증·보완하여 9,430개의 이진형 루브릭을 완성한다. 루브릭은 ‘정보 회수(필요한 증거를 찾고 인용)’, ‘분석(통합·인사이트 도출)’, ‘프레젠테이션(구조·가독성·시각화)’ 세 차원으로 구분돼, 각 차원별 점수를 독립적으로 산출한다. 평가에는 LLM을 ‘판정자’로 활용해 각 루브릭에 대해 ‘충족/불충족’ 여부를 자동 판단하도록 설계했으며, 인간‑LLM 일치 실험을 통해 판정자의 신뢰성을 검증했다. 실험 결과, 최신 오픈·클로즈드 소스 DRA(예: Gemini Deep Research, OpenAI Deep Research, 최신 오픈소스 에이전트) 모두 평균 루브릭 통과율이 45% 수준에 머물렀으며, 특히 정보 회수와 분석 차원에서 큰 결함을 보였다. 이는 에이전트가 웹 검색·도구 활용은 가능하지만, 핵심 증거를 놓치거나 상충되는 정보를 통합하는 능력이 부족함을 의미한다. 논문은 또한 루브릭 기반 평가가 기존 LLM‑정의 기준보다 인간 전문가 판단과 높은 상관관계를 보이며, 검증 가능성·해석 가능성 측면에서 우수함을 입증한다. 한계점으로는 평가에 사용된 LLM 판정자의 오류 가능성, 그리고 특정 도메인(예: 의료·법률)에서의 전문 지식 요구가 아직 충분히 반영되지 않았다는 점을 언급한다. 향후 연구에서는 판정자 모델을 도메인 특화된 지식으로 강화하고, 루브릭 자동 생성 단계에서의 품질 보증 메커니즘을 더욱 정교화할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기