SLIM Brain 데이터와 학습 효율을 겸비한 fMRI 기반 모델

초록

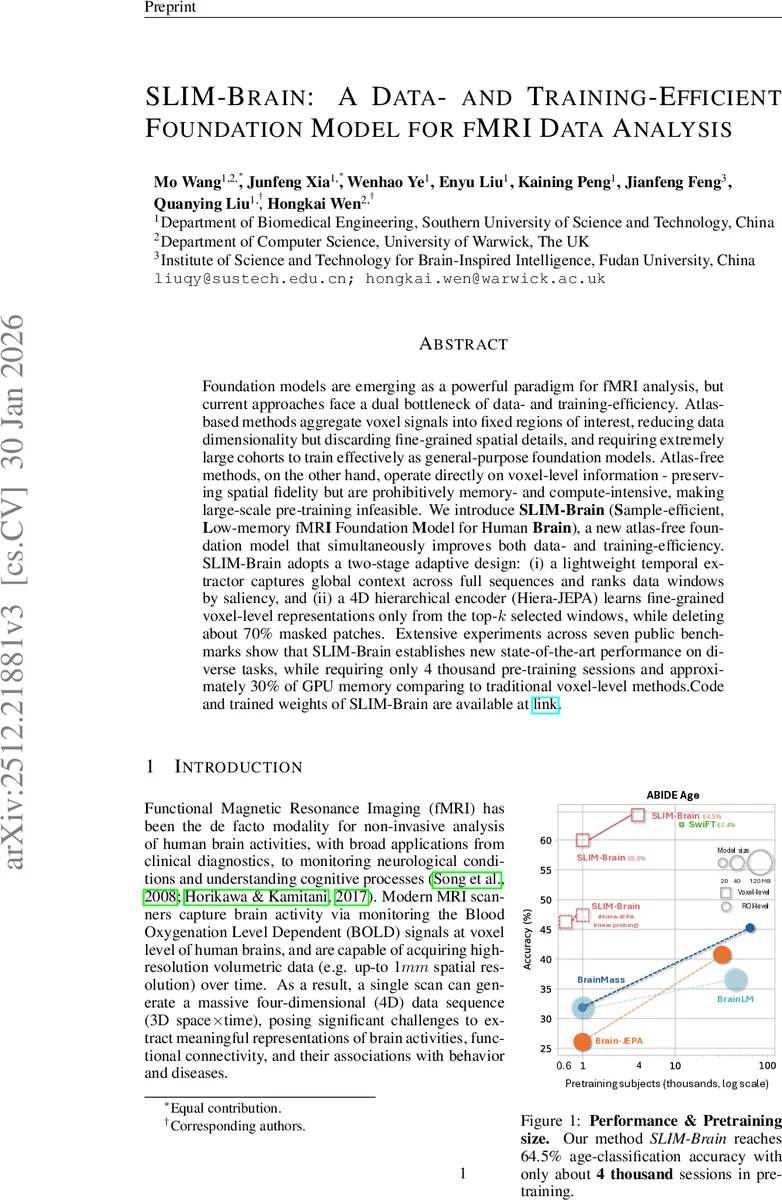

SLIM‑Brain은 4차원 fMRI 데이터를 직접 다루는 atlas‑free 기반 모델로, 가벼운 전역 시간 추출기와 4D 계층형 인코더(Hiera‑JEPA)를 결합해 전체 시퀀스에서 가장 중요한 윈도우만 선택해 학습한다. 마스크 기반 재구성 점수를 이용한 Top‑k 윈도우 선택과 70% 이상의 패치를 마스킹함으로써 GPU 메모리 사용량을 기존 방법의 30% 수준으로 줄이고, 4천 회의 프리트레이닝만으로도 7개 공개 벤치마크에서 최첨단 성능을 달성한다.

상세 분석

본 논문은 fMRI 기반 기초 모델 구축 시 직면하는 두 가지 핵심 병목, 즉 대규모 코호트에 대한 데이터 의존성과 고해상도 4D 볼륨을 직접 처리할 때 발생하는 메모리·연산 비용을 동시에 해결하고자 한다. 기존의 atlas‑based 접근법은 ROI 단위로 차원을 축소해 메모리 효율은 높지만, 공간 세부 정보를 손실하고 파라미터 수가 적어도 수만 명 이상의 피험자 데이터가 필요하다. 반면 atlas‑free 방식은 voxel‑level 정보를 그대로 활용해 미세한 뇌 기능 패턴을 포착할 수 있으나, 1mm³ 해상도와 수백 프레임을 포함하는 4D 시퀀스는 토큰 수가 수백만에 달해 전통적인 Vision Transformer(ViT) 구조에서는 quadratic 연산 복잡도가 메모리 초과를 초래한다.

SLIM‑Brain은 이러한 딜레마를 “두 단계 적응형 파이프라인”으로 해결한다. 첫 번째 단계는 경량 ViT 기반의 전역 시간 추출기로, 전체 시퀀스를 저해상도 패치 토큰화한 뒤 MAE(SimMIM) 방식으로 마스크 복원을 학습한다. 여기서 얻은 전역 특징은 각 시간 윈도우에 대한 재구성 오류를 계산해 상호 마스크 재구성 점수(mutual masked reconstruction score)를 도출하고, 이를 기반으로 가장 정보량이 높은 Top‑k 윈도우를 선정한다. 이 과정은 사전 학습된 전역 모델을 고정(frozen)하고 수행되므로 추가 연산 비용이 거의 들지 않는다.

두 번째 단계에서는 선택된 윈도우들을 4D 계층형 인코더(Hiera‑JEPA)로 전달한다. Hiera‑JEPA는 기존 Swin‑Transformer와 달리 정규 격자에 얽매이지 않고, 마스크된 배경 패치를 70% 이상 제거함으로써 실제 뇌 신호가 존재하는 voxel만을 효율적으로 인코딩한다. 계층적 구조는 초기 레이어에서 공간 해상도를 점진적으로 낮추고 채널 차원을 확대해 연산량을 제어하면서도, MAE‑style 마스크 복원 목표를 통해 풍부한 자기지도 학습 신호를 제공한다. 결과적으로 모델은 전역 시간 의존성을 유지하면서도 미세한 공간 패턴을 학습한다.

실험에서는 7개의 공개 데이터셋(예: ABIDE, NeuroSTORM 등)에서 성별, 연령, 개인 지문(classification) 등 다양한 다운스트림 과제를 평가하였다. SLIM‑Brain은 4천 회(≈4K) 프리트레이닝 세션만으로도 기존 atlas‑based 대규모 모델(>60K 세션)과 비교해 25% 이상의 정확도 향상을 보였으며, GPU 메모리 사용량은 Swin‑based atlas‑free 모델 대비 약 30% 수준으로 크게 감소했다. 또한, 마스크 비율과 Top‑k 윈도우 수에 대한 민감도 분석을 통해 510개의 윈도우가 최적의 성능‑효율 트레이드오프를 제공한다는 점을 확인했다.

핵심 기여는 다음과 같다. ① fMRI 기초 모델에서 데이터 효율성과 학습 효율성이라는 두 축을 동시에 조명하고, 이를 해결하기 위한 체계적 설계 원칙을 제시한다. ② 전역 MAE 기반 시간 선택기와 4D 계층형 인코더를 결합한 두 단계 파이프라인을 도입해 메모리·연산 비용을 획기적으로 절감한다. ③ 다양한 벤치마크에서 기존 최첨단 모델을 능가하는 성능을 입증함으로써, 제한된 데이터와 컴퓨팅 자원을 가진 연구 환경에서도 실용적인 fMRI 기반 기초 모델 구축이 가능함을 증명한다.

댓글 및 학술 토론

Loading comments...

의견 남기기