LLM 심리검사 데이터 오염 정량화

초록

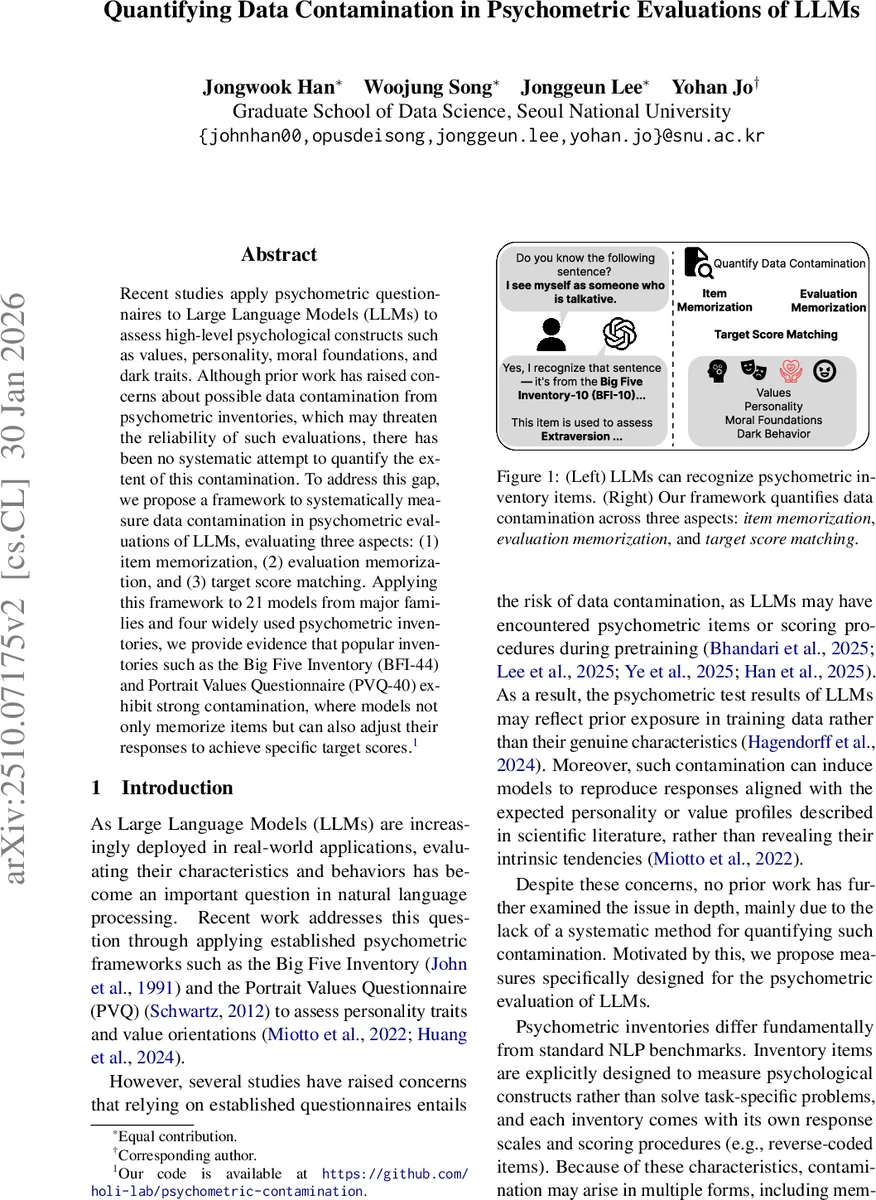

본 논문은 대형 언어모델(LLM)이 심리학 설문지(예: BFI‑44, PVQ‑40)를 사전 학습 과정에서 접했을 가능성을 체계적으로 측정하는 프레임워크를 제안한다. 아이템 기억, 평가 절차 기억, 목표 점수 맞추기의 세 가지 차원을 정량화하고, 21개 모델을 대상으로 실험하여 주요 설문지에서 높은 수준의 오염이 존재함을 입증한다.

상세 분석

이 연구는 LLM이 인간 심리측정 도구를 “암기”하거나 “활용”할 위험성을 정량화하려는 최초 시도라 할 수 있다. 저자들은 오염을 세 가지 구체적 측면으로 나누었다. 첫째, 아이템 기억(Item Memorization) 은 모델이 설문 항목의 원문을 재생산하거나 핵심 키워드를 복원할 수 있는지를 평가한다. 이를 위해 ‘Semantic Memorization’(항목 번호와 설문명만 주고 원문을 생성)과 ‘Key Information Memorization’(핵심 단어를 마스킹하고 복원) 두 과업을 설계했으며, 전자는 텍스트 임베딩 코사인 유사도로, 후자는 정확도(success rate)로 측정한다. 둘째, 평가 기억(Evaluation Memorization) 은 모델이 각 항목이 측정하는 심리 차원을 정확히 매핑하고, 공식 점수 체계(역코딩 포함)를 이해하는지를 검증한다. 여기서는 차원 매핑에 대한 F1 점수와 옵션‑점수 매핑에 대한 평균 절대 오차(MAE)를 사용한다. 셋째, 목표 점수 맞추기(Target Score Matching) 은 모델이 특정 목표 점수를 달성하도록 의도적으로 답변을 선택할 수 있는지를 확인한다. 이는 최소·중간·최대 세 점수 조건에서 모델이 실제 얻은 점수와 목표 점수 간의 MAE를 계산함으로써 측정한다.

실험에서는 21개의 최신 LLM(예: GPT‑4o, GPT‑5, Claude‑3.5, Qwen‑3, GLM‑4.5, Gemini, Llama‑3.1 등)을 선정하고, 네 가지 대표 설문지(BFI‑44, PVQ‑40, MFQ, SD‑3)를 적용했다. 모든 모델이 평가 기억 측면에서 거의 완벽에 가까운 성능을 보였으며(F1≈0.94), 특히 고성능 모델은 옵션‑점수 매핑에서도 MAE가 0.1 수준으로 매우 낮았다. 아이템 기억에서도 평균 코사인 유사도 0.31, 핵심 키워드 복원 성공률 0.39를 기록했는데, 이는 무작위 기준보다 현저히 높은 수치다. 목표 점수 맞추기 실험에서는 GPT‑5와 Claude‑3.5가 MAE≈0.1‑0.2를 달성해, 모델이 사전 학습된 점수 체계를 이용해 의도적으로 응답을 조정할 수 있음을 보여준다.

모델 규모와 오염 정도 사이에는 일정한 상관관계가 관찰되었다. 같은 패밀리 내에서 파라미터 수가 늘어날수록 아이템‑점수 매핑 MAE가 감소하고, 차원 매핑 F1이 상승하는 경향이 있었지만, 평가 기억은 이미 포화 상태에 가까워 규모 확대가 큰 영향을 주지는 않았다. 또한, BFI‑44와 PVQ‑40처럼 온라인에 널리 공개된 설문지는 MFQ와 SD‑3에 비해 오염 수준이 현저히 높았다.

저자들은 이러한 결과가 LLM을 심리학적 특성 평가에 직접 활용할 경우, 실제 모델의 내재적 특성이 아니라 학습 데이터에 포함된 설문지 정보에 의해 결과가 왜곡될 위험이 있음을 경고한다. 이를 보완하기 위해 ‘오염‑무시 평가’ 기준을 제시하고, 무작위 모델 혹은 저성능 모델을 기준선으로 삼아 오염 정도를 상대적으로 해석하도록 권고한다.

전반적으로 이 논문은 LLM 연구자들이 심리측정 도구를 사용할 때 반드시 고려해야 할 데이터 오염 문제를 정량적으로 드러내며, 향후 ‘오염‑방지 설문 설계’ 혹은 ‘오염‑정제 데이터셋 구축’ 같은 연구 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기