능력‑난이도 정렬 샘플링으로 LLM 강화학습 효율 혁신

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

본 논문은 강화학습 기반 LLM 추론에서 문제 난이도와 모델 역량을 동적으로 정렬하는 CDAS 기법을 제안한다. 과거 성과를 누적해 안정적인 난이도 추정과 고정점 이론을 통해 샘플링 효율을 크게 향상시킨다.

상세 분석

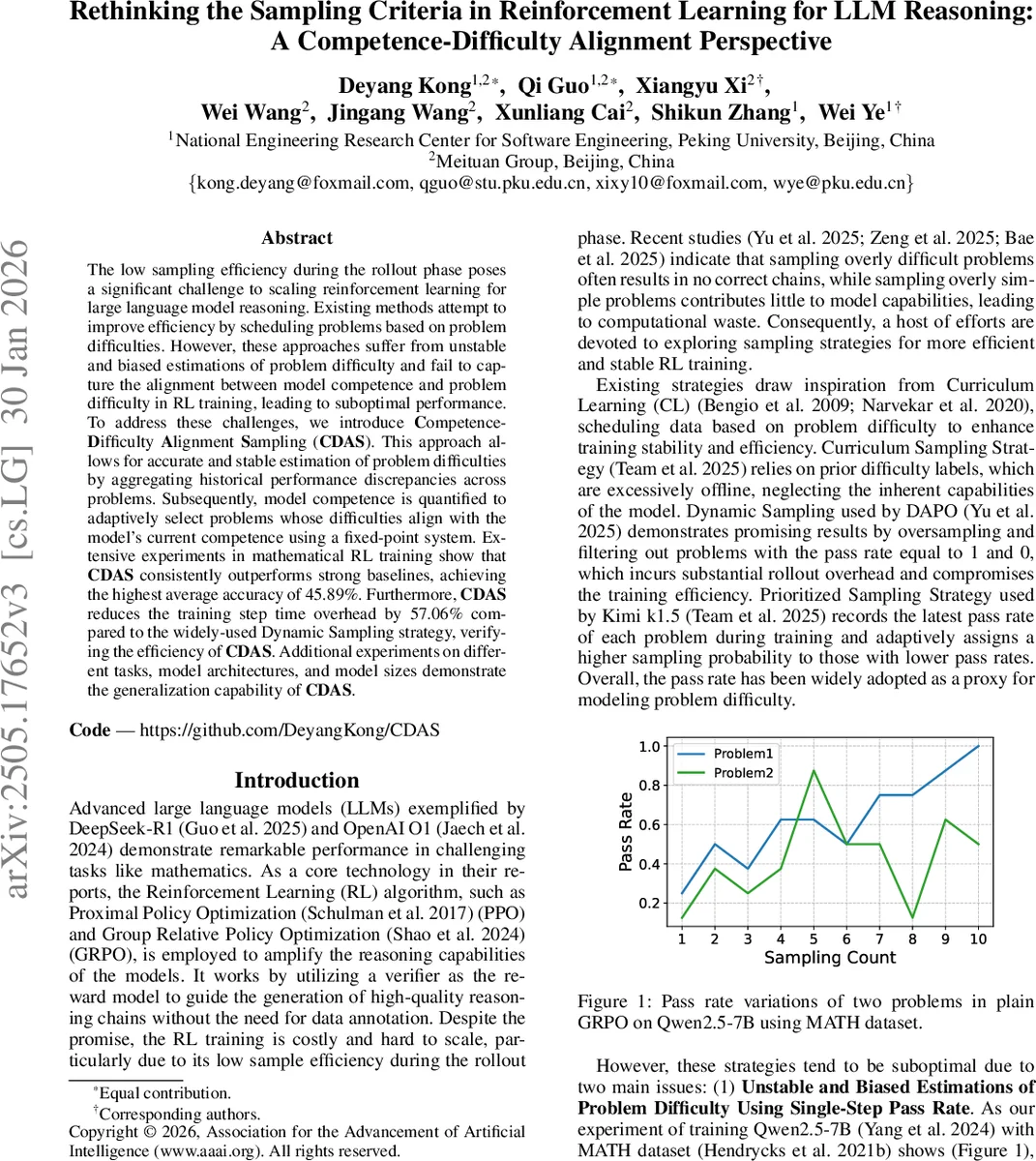

본 연구는 대규모 언어 모델(LLM)의 추론 능력을 강화학습(RL)으로 향상시키는 과정에서 가장 큰 병목 중 하나인 롤아웃 단계의 낮은 샘플 효율성을 근본적으로 재고한다. 기존의 커리큘럼 기반 샘플링이나 Dynamic Sampling, Prioritized Sampling 등은 문제 난이도를 단일 시점의 통과율(pass rate)로 추정한다. 그러나 통과율은 학습 진행 중 크게 변동하고, 순간값에 의존하면 편향된 난이도 판단이 발생한다는 점을 실험적으로 확인하였다(그림 1). 또한, “더 어려운 문제를 많이 샘플링한다”는 단순 전략은 모델 역량과 난이도 사이의 정렬을 무시하고, 지나치게 어려운 문제는 0‑gradient를, 지나치게 쉬운 문제는 학습 효율 저하를 초래한다.

이에 저자들은 두 핵심 개념을 도입한다. 첫째, 모델 역량(Competence, Cₙ) 은 현재 단계에서 전체 데이터셋 평균 난이도의 부정값으로 정의한다(Cₙ = −Eₓ

댓글 및 학술 토론

Loading comments...

의견 남기기