스크립트 기반 360° VR 투어에서 객체 집중을 통한 주의 유도

본 논문은 360° VR 영상 투어에서 텍스트 스크립트를 활용해 관심 객체를 자동으로 탐지·분할하고, 비네팅 효과로 시청자의 시선을 유도하는 방법을 제안한다. Grounding‑DINO와 Segment‑Anything(SAM)을 연계해 객체 검출·세분화 파이프라인을 구축하고, 대학 캠퍼스 투어 영상을 실험 사례로 사용해 사용자 경험 향상을 확인하였다.

저자: Paulo Vitor Santana Silva, Arthur Ricardo Sousa Vitória, Diogo Fern

본 논문은 360° 가상현실(VR) 영상 투어에서 시청자의 주의를 특정 객체로 유도하기 위한 자동화된 파이프라인을 제시한다. 기존 360° 영상은 전방위 시야를 제공하지만, 사용자는 자유롭게 시점을 이동할 수 있어 내러티브가 의도한 핵심 정보를 놓치기 쉽다. 이를 해결하고자 저자들은 텍스트 기반 스크립트를 활용해 관심 객체를 식별하고, 비네팅(vignette) 효과로 시각적 강조를 수행한다.

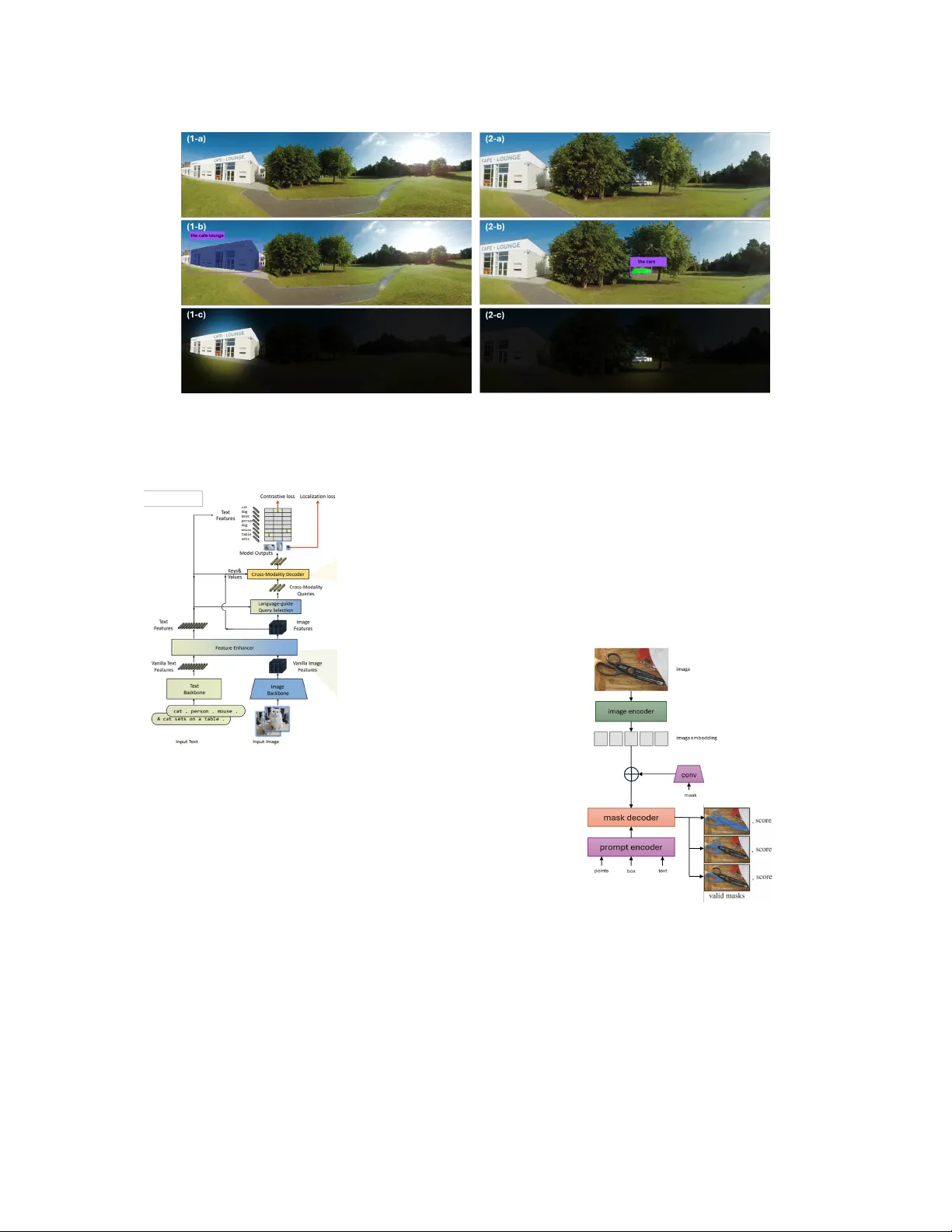

먼저, 영상 스크립트는 시간 구간과 객체에 대한 서술(예: “오른쪽에 있는 사람 조각상을 보세요”)을 포함한다. 이 서술과 해당 프레임을 Grounding‑DINO에 입력하면, 모델은 텍스트‑이미지 교차‑모달 트랜스포머 구조를 통해 가장 높은 의미적 일치를 보이는 영역을 바운딩 박스로 반환한다. Grounding‑DINO는 사전 학습된 대규모 데이터셋(COCO, O365, OpenImage 등)을 기반으로 제로샷 탐지를 수행하므로, 별도 라벨링 없이도 다양한 객체를 인식할 수 있다.

바운딩 박스가 확보되면, 이를 SAM(Segment Anything Model)에 전달한다. SAM은 이미지 인코더(ViT‑H/16)와 프롬프트 인코더, 마스크 디코더로 구성된 범용 세분화 모델이며, 박스 프롬프트만으로도 높은 정확도의 마스크를 생성한다. 논문에서는 SAM을 제로샷 모드로 사용했으며, 이는 추가 학습 없이도 일반적인 객체에 대해 충분히 작동함을 보여준다. 다만, 복합적인 형태나 텍스처가 복잡한 대상(예: 켄타우로스 조각상)에서는 마스크가 부분적으로만 추출되는 한계가 발견되었다.

세분화된 마스크와 바운딩 박스를 기반으로 비네팅 효과를 적용한다. 비네팅은 화면 주변을 어둡게 하고 중심 객체를 밝게 강조하는 시각적 가이드로, 사용자가 헤드 트래킹을 통해 자연스럽게 목표 객체를 바라보게 만든다. 이 방식은 화살표, 레이더, 블러 등 기존 시각적 가이드와 달리 화면 전체를 가리지 않으며, 시청자의 시야를 방해하지 않으면서도 주의를 집중시킨다.

실험은 영국 리딩 대학교 캠퍼스를 촬영한 360° 영상 투어를 대상으로 수행되었다. 스크립트에 명시된 네 개의 주요 객체(오른쪽 사람 조각상, 왼쪽 켄타우로스 조각상, 카페 라운지, 나무 사이의 차량)에 대해 자동 탐지·세분화·비네팅 파이프라인을 적용했으며, 결과 영상에서 목표 객체가 명확히 강조되는 것을 확인했다. 특히, 비네팅 적용 전후의 시각적 차이가 뚜렷했으며, 사용자는 스크립트와 시각적 가이드를 통해 의도된 정보를 빠르게 파악할 수 있었다.

실패 사례는 SAM의 제로샷 성능 한계에서 비롯되었다. 켄타우로스 조각상의 경우 마스크가 부분적으로만 생성되어 비네팅이 완전하게 적용되지 않았다. 저자들은 이러한 문제를 해결하기 위해 도메인‑특화 데이터셋으로 SAM을 파인튜닝하거나, 텍스트‑프롬프트를 보강하는 방안을 제시한다.

결론적으로, 본 연구는 Grounding‑DINO와 SAM을 결합한 객체 탐지·세분화 파이프라인이 텍스트 스크립트와 연동되어 360° VR 영상에서 자동으로 주의 유도 요소를 생성할 수 있음을 입증한다. 이는 제작자가 복잡한 시각적 가이드를 수동으로 설계할 필요 없이, 스크립트만으로도 효과적인 내러티브를 구현할 수 있게 하여 제작 비용을 절감하고 사용자 경험을 향상시킨다. 향후 연구에서는 SAM의 파인튜닝, 사용자 눈동자 추적 기반 피드백 루프 구축, 그리고 다양한 교육·관광·문화 콘텐츠에 대한 적용 가능성을 탐색할 예정이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기