LLM 기반 의미별 온도 조정으로 DPO 향상

초록

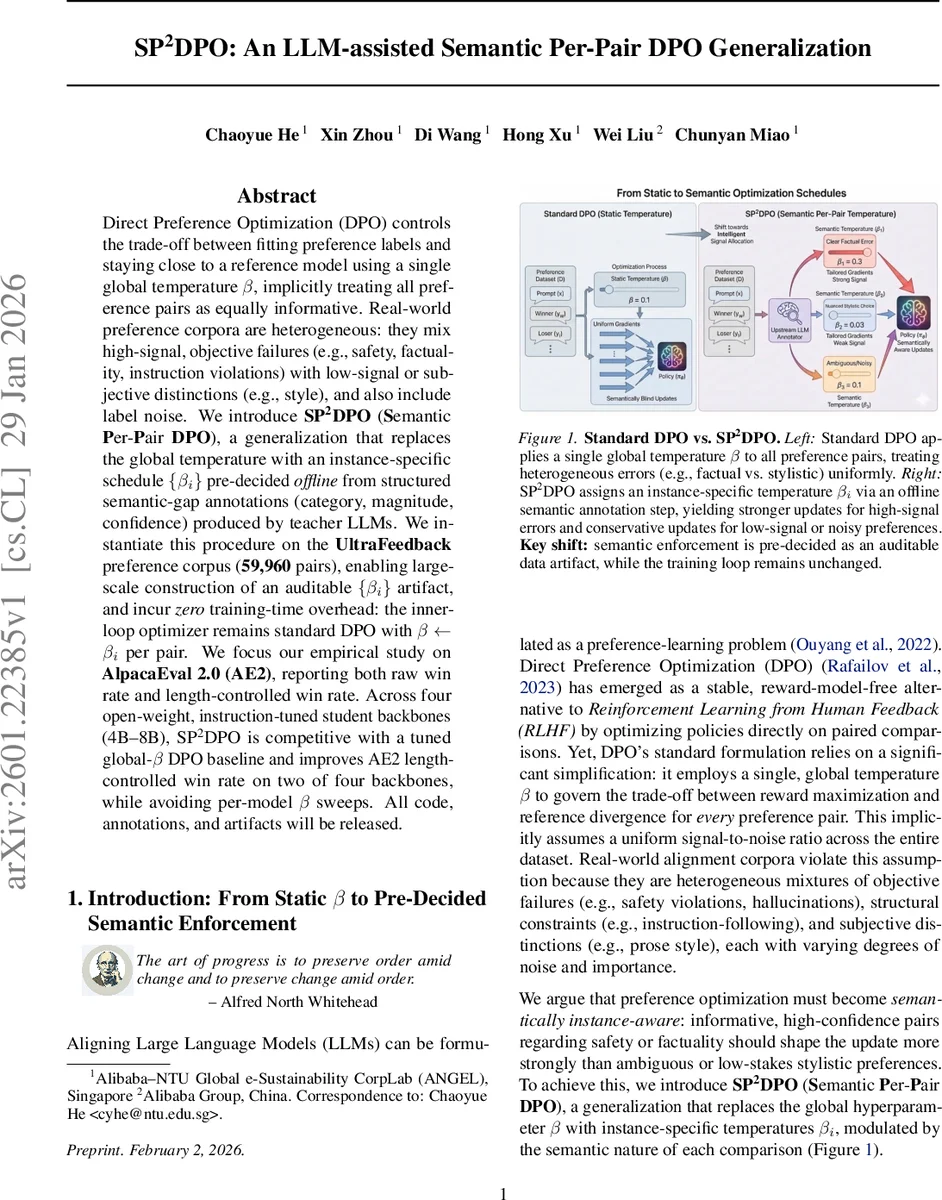

본 논문은 기존 DPO가 모든 선호 쌍에 동일한 전역 온도 β를 적용하는 한계를 지적하고, 교사 LLM이 사전 분석한 의미‑갭(카테고리·크기·신뢰도) 정보를 활용해 각 쌍마다 개별 온도 βᵢ를 부여하는 SP²DPO 방식을 제안한다. UltraFeedback 데이터에 βᵢ를 오프라인으로 생성하고, 학습 단계에서는 기존 DPO와 동일하게 β를 교체해 사용한다. AlpacaEval 2.0 실험에서 4‑8B 규모의 학생 모델 4종에 대해 전역 β 튜닝 대비 경쟁력을 보이며, 두 모델에서는 길이 제어 승률까지 향상시켰다.

상세 분석

SP²DPO는 “Alignment Process Optimization”(APO)이라는 새로운 패러다임을 도입한다. 기존 DPO는 β라는 전역 하이퍼파라미터 하나로 보상 강화와 레퍼런스 모델과의 KL 발산 사이의 트레이드오프를 조절한다. 이는 데이터셋 내 모든 선호 쌍이 동일한 신호‑노이즈 비율을 가진다고 가정하는데, 실제 인간 피드백 데이터는 안전·사실성 같은 고신호·고중요도 항목과 스타일·톤 같은 저신호·주관적 항목이 혼재한다. 이러한 이질성을 무시하면 중요한 오류에 대한 학습 강도가 약해지고, 노이즈가 과도하게 반영될 위험이 있다.

SP²DPO는 이를 해결하기 위해 각 선호 쌍 (x, y_w, y_l)에 대해 교사 LLM이 의미‑갭 튜플(카테고리, 크기, 신뢰도)을 출력하도록 설계한다. 카테고리는 Safety, Factuality, Instruction, Reasoning, Helpfulness, Style 로 정의되고, 우선순위가 부여된다. 크기와 신뢰도는 0‑1 구간의 실수값으로 정규화된다. 이러한 구조화된 신호는 사전 정의된 매핑 함수에 의해 βᵢ ∈

댓글 및 학술 토론

Loading comments...

의견 남기기