메르메이드: 기억 기반 다중 에이전트로 증거 검색·추론을 통합한 사실 검증 프레임워크

초록

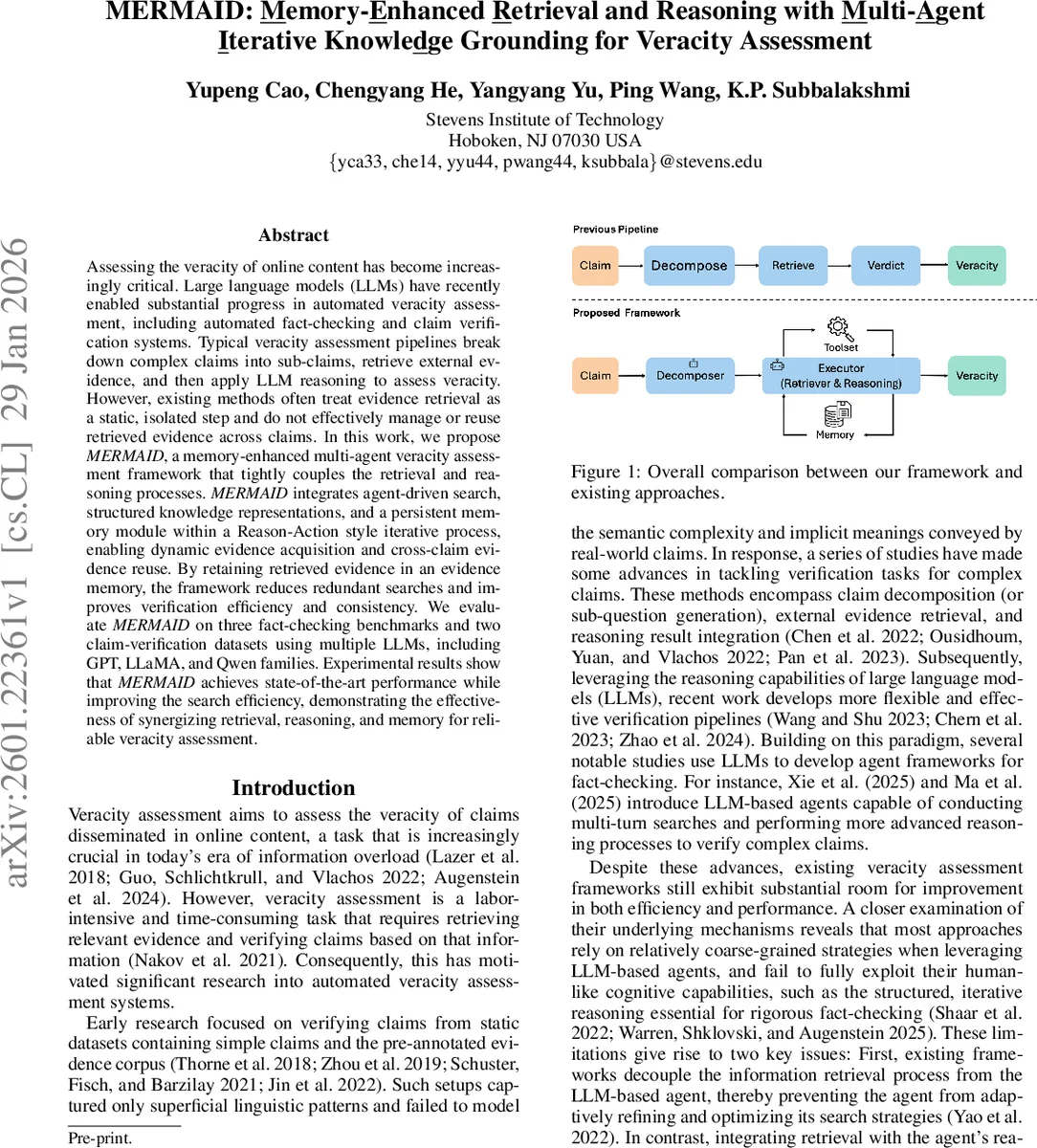

MERMAID는 증거 검색과 LLM 기반 추론을 긴밀히 결합하고, 검색된 증거를 영구 메모리에 저장해 여러 청구에 걸쳐 재활용함으로써 검증 효율과 정확성을 동시에 높인 다중 에이전트 시스템이다.

상세 분석

본 논문은 기존 사실 검증 파이프라인이 증거 검색을 일회성, 정적 단계로 취급하고 청구 간 증거 재사용을 고려하지 않는 한계를 정확히 짚어낸다. 이를 극복하기 위해 제안된 MERMAID는 네 가지 핵심 모듈로 구성된다. 첫 번째인 Decomposer 에이전트는 입력 청구를 주제와 삼중항(주어‑관계‑목적어) 형태의 구조화된 지식 그래프로 변환한다. 이 단계는 이후 검색 키워드와 메모리 조회를 위한 인덱스를 제공함으로써 검색 효율을 사전에 높인다. 두 번째인 Executor 에이전트는 ReAct(Reason‑Act) 패러다임을 채택해 “생각 → 행동 → 관찰” 사이클을 반복한다. 여기서 행동은 외부 툴(위키피디아, 구글 검색, 학술 데이터베이스 등)을 호출하는 검색 액션이며, 관찰은 해당 툴이 반환한 텍스트 증거이다. 세 번째인 Toolset은 다양한 검색·조회 API를 추상화해 에이전트가 손쉽게 호출하도록 설계되었으며, 필요에 따라 새로운 도구를 플러그인 형태로 추가할 수 있다. 마지막으로 Evidence Memory는 영구적인 키‑값 저장소로, Decomposer가 추출한 엔티티를 키로 사용해 이전 청구에서 확보한 증거를 빠르게 조회한다. 메모리 조회는 청구 간 논리적 연관성을 자동으로 포착해 중복 검색을 방지한다.

알고리즘 1은 전체 흐름을 명확히 제시한다. 청구가 들어오면 Decomposer가 D_c를 생성하고, 엔티티 집합 E_c를 추출한다. 이후 Memory에서 M_c를 호출해 기존 증거를 불러오고, 초기 프롬프트 P_0에 청구, 구조화된 지식, 메모리 증거, 빈 대화 히스토리를 삽입한다. Executor는 최대 T_max 단계까지 반복하며, 각 단계에서 LLM 기반 정책 π가 생각(th_t)과 행동(a_t)을 생성한다. 행동이 검색이면 Toolset τ를 통해 실제 검색을 수행하고 관찰(o_t)을 얻는다. 관찰은 히스토리 H_t에 축적되며, 최종적으로 “Answer” 행동이 선택되면 검증 라벨 ˆy와 함께 추론 경로가 출력된다. 검증이 끝난 뒤 새로 확보한 증거는 Memory에 기록돼 향후 청구에 재활용된다.

실험에서는 GPT‑4, LLaMA‑2‑70B, Qwen‑1.8B 등 최신 LLM을 백본으로 사용했으며, FEVER, SciFact, ClaimDecompTest 등 5개 데이터셋에서 기존 최첨단 방법들을 앞섰다. 특히 검색 횟수는 평균 30% 이상 감소했으며, 메모리 사용량이 증가함에 따라 동일 청구군에서 중복 검색이 현저히 줄어들었다. Ablation 연구에서는 (1) 메모리 없이 순수 ReAct, (2) Decomposer 없이 직접 청구 입력, (3) 단일 에이전트 구조를 각각 제거했을 때 성능이 크게 떨어지는 것을 확인했다. 이는 구조화된 지식과 메모리, 다중 에이전트가 상호 보완적으로 작동한다는 증거다.

또한 사례 연구에서는 MERMAID가 복합 청구를 단계별로 분해하고, 초기 검색에서 충분한 증거가 확보되지 않을 경우 추가 검색을 수행해 최종 판단을 내리는 과정을 상세히 보여준다. 이 과정은 인간 fact‑checker가 “먼저 기존 지식에 의존하고, 부족하면 추가 조사한다”는 인지 전략과 일치한다. 논문은 메모리 모듈이 증거의 신뢰성 평가와 출처 추적에도 활용될 수 있음을 시사하며, 향후 메모리 내 증거의 자동 요약·정제, 증거 신뢰도 스코어링 등 확장 가능성을 제시한다.

전반적으로 MERMAID는 (1) 증거 검색과 추론을 동시 최적화, (2) 구조화된 청구 분해를 통한 검색 효율 향상, (3) 영구 메모리를 통한 증거 재사용이라는 세 축을 결합함으로써 기존 파이프라인의 비효율성을 근본적으로 개선한다. 이는 LLM 기반 사실 검증 시스템이 실제 운영 환경에서 확장성과 신뢰성을 확보하는 데 중요한 전환점이 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기