거친 3D 시뮬레이션을 실사 영상으로 변환하는 C2R 프레임워크

초록

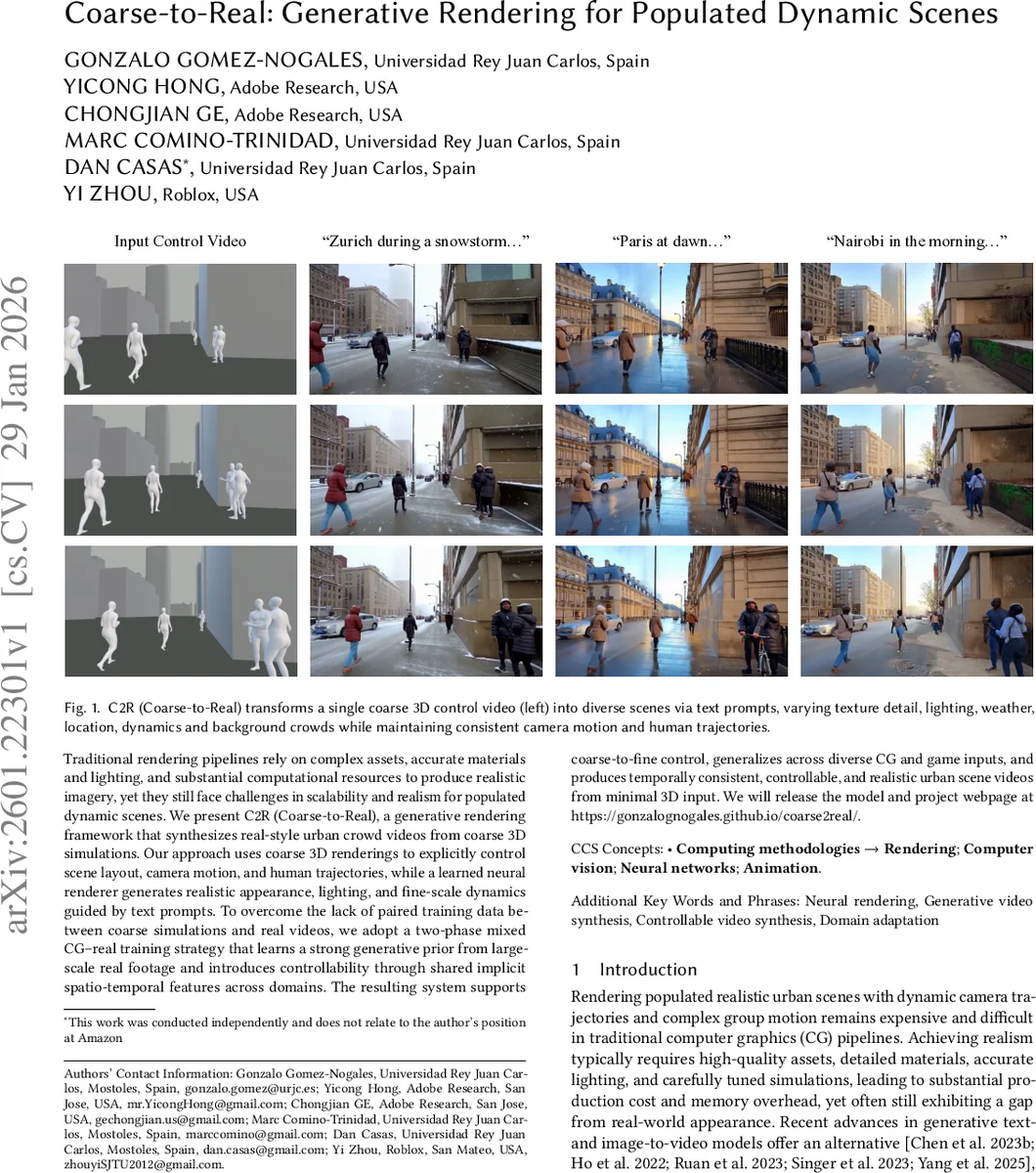

C2R은 거친 3D 렌더링을 입력으로 받아 텍스트 프롬프트와 결합해 도시 군중 장면을 실사 수준으로 합성하는 생성형 렌더링 시스템이다. 대규모 실세계 영상으로 사전 학습한 확산 모델을 기반으로, 실제와 합성 데이터를 혼합한 두 단계 학습을 통해 구조적 제어와 사진실감 표현을 동시에 달성한다.

상세 분석

본 논문은 전통적인 컴퓨터 그래픽 파이프라인이 요구하는 고품질 자산·재질·조명 등의 비용을 크게 낮추면서도, 동적인 인구가 밀집한 도시 장면을 실사 수준으로 재현하고자 하는 목표를 제시한다. 핵심 아이디어는 ‘거친 3D 시뮬레이션 → 생성형 렌더러’라는 하이브리드 구조로, 3D 엔진이 제공하는 카메라 궤적, 레이아웃, 인간 궤적 등 구조적 정보를 그대로 유지하고, 텍스처·조명·미세 동작은 대규모 실세계 영상에서 학습된 확산 모델이 자동으로 hallucinate하도록 설계했다.

학습은 두 단계로 나뉜다. 1단계에서는 실세계 영상과 텍스트 프롬프트만을 이용해 확산 백본을 ‘실사 영상 분포’에 맞추어 사전 학습한다. 여기서는 VAE 인코더·디코더와 텍스트 인코더를 고정하고, 흐름 매칭 기반의 목표 함수를 통해 노이즈 예측을 최적화한다. 2단계에서는 구조적 제어를 도입한다. 합성된 거친 렌더와 실세계 영상 모두에서 DINOv3 ViT로 추출한 패치 특징을 어댑터 A를 통해 확산 라티스에 직접 더한다. 이때 명시적인 깊이·에지와 같은 강제 제어가 아니라, 시공간적 특징을 암묵적으로 매핑함으로써 모델이 입력 구조를 존중하면서도 자유롭게 세부 묘사를 생성하도록 한다.

데이터 측면에서 저자는 실세계 영상(수백만 클립)과 제한된 양의 CG 쌍(pair) 데이터를 혼합한다. 실세계 데이터는 생성 prior를 강화하고, CG 데이터는 ‘거친 → 정교’ 매핑을 위한 앵커 역할을 한다. 이렇게 함으로써 CG 특유의 아티팩트를 최소화하고, 다양한 도시·날씨·문화적 배경을 포괄하는 일반화 능력을 확보한다.

실험 결과는 텍스트 프롬프트에 따라 텍스처·조명·날씨·배경 군중을 자유롭게 변형하면서도, 입력 3D 영상의 카메라 움직임과 인간 궤적을 정확히 유지한다는 점을 보여준다. 또한 기존 텍스트‑투‑비디오·비디오‑투‑비디오 모델에 비해 장시간(수초 이상) 동안의 시간 일관성과 군중 상호작용 표현에서 현저히 우수함을 입증한다.

이 논문은 구조적 제어와 사진실감 사이의 트레이드오프를 ‘두 단계 학습 + 암묵적 시공간 특징’이라는 새로운 설계 패턴으로 해결했으며, 향후 게임·시뮬레이션·가상 제작 분야에서 저비용 고품질 영상 합성의 실용적 기반을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기