시각‑언어 모델, 3D 카메라 자세 추정에서 한계 드러나다

초록

본 논문은 최신 시각‑언어 모델(VLM)이 2D 의미 추론은 뛰어나지만, 실제 이미지 쌍으로부터 상대 카메라 자세(translation·rotation)를 추정하는 3D 공간 이해에서는 크게 뒤처진다는 점을 실험적으로 입증한다. 저자들은 실세계 egocentric 영상에서 추출한 VRRPI‑Bench과 개별 자유도만을 변동시키는 VRRPI‑Diag 두 벤치마크를 제시하고, SIFT·LoFTR 같은 전통적 기하학 기반 방법과 인간 평가와 비교한다. 결과는 GPT‑5조차 0.64의 F1 점수에 머물며, 고전적인 기하학 파이프라인(0.97)과 인간(0.92)보다 현저히 낮다. 특히 깊이 변화와 롤 회전 등 광축을 따라 일어나는 움직임을 추정하는 데 약점이 드러난다.

상세 분석

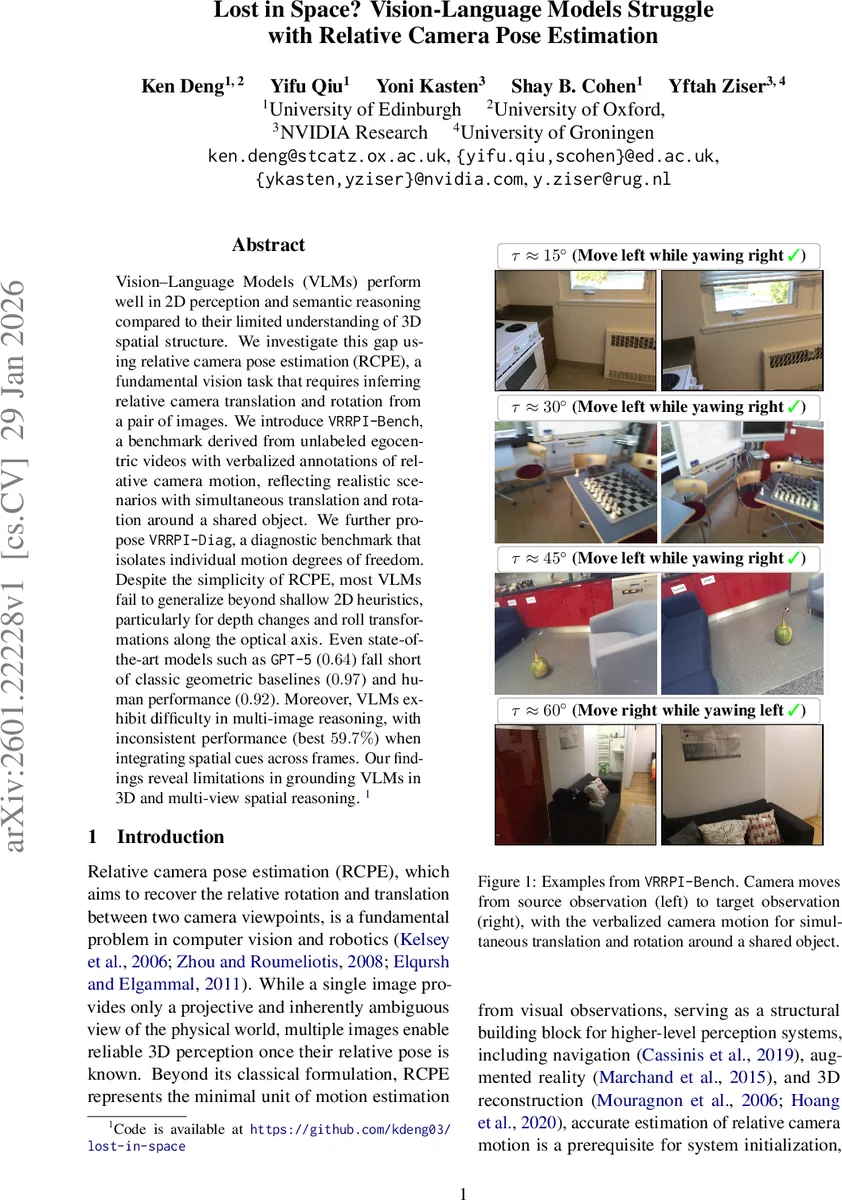

이 논문은 시각‑언어 모델(VLM)의 3차원 공간 인식 능력을 정량화하기 위해 ‘Relative Camera Pose Estimation (RCPE)’이라는 핵심 비전 과제를 선택했다. RCPE는 두 이미지 사이의 상대적인 6자유도(3축 회전 + 3축 이동)를 추정해야 하는데, 이는 전통적인 SLAM·Structure‑from‑Motion 파이프라인에서 가장 기본적인 단계이다. 저자들은 두 가지 데이터셋을 설계했다. 첫 번째 VRRPI‑Bench은 실제 egocentric 비디오에서 동일 객체를 중심으로 한 카메라 이동을 자동으로 추출하고, 인간이 서술한 ‘move left while yawing right’와 같은 자연어 라벨을 부착한다. 이 라벨은 15°, 30°, 45°, 60° 네 가지 시점 각도 구간에 따라 구분되며, 각 구간은 이미지 쌍이 공유하는 중심 물체가 유지되는 조건 하에 선택된다. 두 번째 VRRPI‑Diag은 한 번에 하나의 자유도만이 크게 변하도록 필터링한다(예: 오직 yaw만 30° 변동, 나머지는 5° 이하). 이렇게 함으로써 VLM이 특정 축의 변화를 인식하는 능력을 독립적으로 평가할 수 있다.

실험 설정은 두 단계로 나뉜다. (1) 전통적인 기하학 기반 베이스라인으로 SIFT + RANSAC과 LoFTR + RANSAC을 사용해 핵심점 매칭 → essential matrix → 상대 자세 복원을 수행한다. (2) 다양한 VLM을 평가한다. 오픈소스 모델(Lv‑Next, Lv‑OneVision, Idefics3, Qwen2.5‑VL 등), 상용 모델(GPT‑4o, GPT‑5), 파인튜닝된 모델(SpaceQwen), 그리고 단계적 추론을 지원하는 ‘Thinking’ 버전까지 포함한다. 모든 VLM은 동일한 프롬프트(“Given the two images, describe the dominant camera motion”)를 사용하고, 출력은 6축 중 가장 큰 변화를 나타내는 이산 클래스(예: ‘yaw right’, ‘translation forward’)로 매핑한다. 평가 지표는 macro F1 점수이며, 이는 클래스 불균형을 보정한다.

주요 결과는 다음과 같다. (1) LoFTR은 거의 최적에 가까운 0.97(F1) 점수를 기록, 전통적인 기하학 방법이 여전히 최고 성능임을 확인한다. (2) SIFT도 0.83(F1)으로 VLM보다 우수하지만, 복잡한 장면·넓은 시점 변화에서는 0.66까지 떨어진다. (3) 대부분의 VLM은 0.3~0.5 수준에 머물며, 특히 60°와 같은 큰 각도에서는 거의 무작위 수준에 가깝다. (4) GPT‑5만이 상대적으로 0.64(F1)로 최고 성능을 보이지만, 인간(0.92)과 고전적 기하학(0.97) 사이에 큰 격차가 있다. (5) 다중 이미지 추론 일관성 테스트에서, 이미지 순서를 바꾸었을 때(소스↔타깃) 정확도가 59.7% 이하로 급락, VLM이 대칭성을 유지하지 못함을 보여준다. (6) VRRPI‑Diag 분석에서는 깊이 축(tz) 변환과 roll(ψ) 회전에 대한 성능이 현저히 낮다. 예를 들어 GPT‑5는 평균 0.90이지만 roll 예측은 0.47에 불과했다. 반면 pitch·yaw·xy 평행 이동은 비교적 양호했다.

오류 분석 파트에서는 VLM이 (a) 이미지 내 2D 관계(‘object left of another’)는 잘 파악하지만, (b) 두 이미지 간 정확한 대응점 찾기와 (c) 카메라 움직임을 물리적 변환으로 역변환하는 과정에서 크게 실패한다는 점을 지적한다. 특히 ‘object motion ↔ camera motion’ 역관계를 이해하지 못해, “object moves left”와 “camera moves right”를 혼동한다. 이는 VLM이 이미지 평면상의 힌트에 과도하게 의존하고, 실제 3D 기하학적 제약을 내재화하지 못한다는 근본적인 한계로 해석된다.

논문의 기여는 세 가지로 요약할 수 있다. 첫째, 실제 영상 기반의 RCPE 벤치마크(VRRPI‑Bench, VRRPI‑Diag)를 공개해 VLM의 3D 공간 추론을 정량화할 수 있는 표준 테스트베드를 제공한다. 둘째, 현재 최첨단 VLM이 2D 의미 추론에 강점이 있더라도, 다중 뷰·다중 자유도 상황에서는 전통적인 기하학 방법에 크게 뒤처진다는 실증적 증거를 제시한다. 셋째, VLM이 3D 인지를 향상시키기 위해서는 (i) 깊이·포인트 클라우드와 같은 명시적 3D 입력, (ii) 기하학적 제약을 학습 목표에 포함하는 멀티모달 사전학습, (iii) 다중 이미지 간 일관성을 강제하는 구조적 손실 함수 등이 필요함을 제안한다. 전체적으로 이 연구는 VLM이 실제 로봇·AR·VR 시스템에 적용되기 위해서는 “시각‑언어”를 넘어 “시각‑언어‑기하학” 통합이 필수임을 강력히 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기