통합 오디오비주얼 확산으로 구현한 영상 더빙

초록

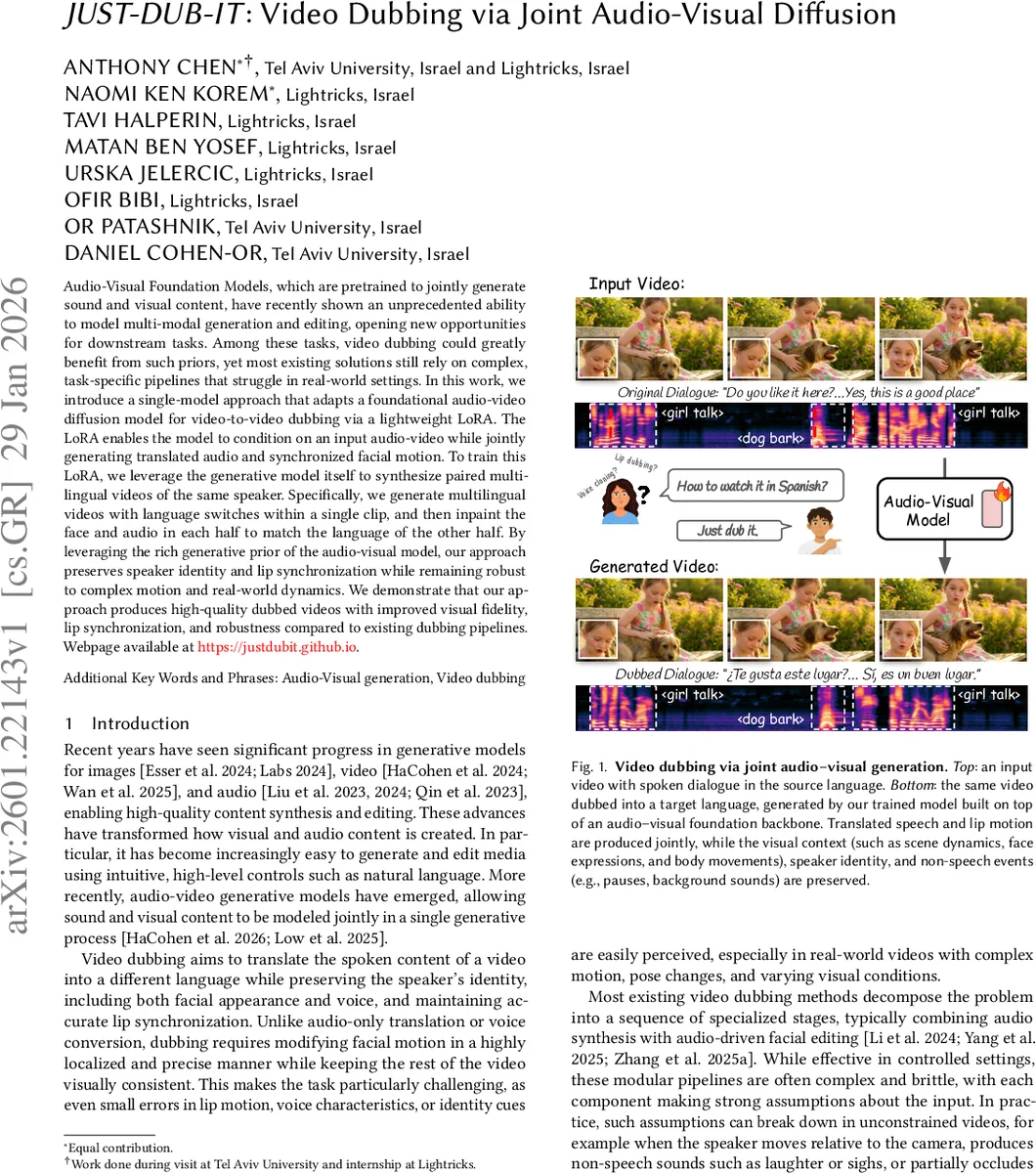

본 논문은 사전학습된 오디오‑비주얼 확산 모델에 경량 LoRA를 추가해, 입력 영상과 음성을 동시에 조건으로 하여 번역된 음성과 정확히 동기화된 입술 움직임을 한 번에 생성하는 단일 모델 기반 영상 더빙 시스템을 제안한다. 학습 데이터는 동일 화자·배경을 유지하면서 언어가 바뀐 영상 쌍을 모델 자체의 생성·인페인팅 능력으로 합성해 만든다. 실험 결과, 기존의 모듈식 파이프라인에 비해 시각적 품질, 입술 동기화, 복잡한 움직임에 대한 견고성이 크게 향상됨을 보인다.

상세 분석

본 연구는 최근 급부상한 오디오‑비주얼 Foundation Model을 영상 더빙이라는 구체적 응용에 직접 적용한다는 점에서 의미가 크다. 핵심 아이디어는 두 가지 단계로 나뉜다. 첫째, 강력한 사전학습 확산 모델(LTX‑2)을 그대로 활용해 ‘언어 전환 영상’을 생성한다. 이 과정에서 하나의 클립 안에 화자가 영어→프랑스어 등으로 자연스럽게 전환하는 모습을 만들고, 이를 기반으로 양쪽 절반을 각각 마스크한 뒤 동일 모델을 이용해 오디오·비디오 인페인팅을 수행한다. 이렇게 하면 동일 화자·포즈·조명·배경을 유지하면서 언어만 바뀐 두 영상 쌍이 얻어진다. 여기서 저자들은 ‘Latent‑Aware Fine Masking’이라는 기법을 도입해, VAE 인코더의 넓은 수용 영역으로 인해 발생하는 주변 토큰의 ‘누수’를 정밀히 측정·마스킹함으로써 모델이 원본 입술 움직임을 그대로 복제하지 못하도록 강제한다. 또한, 발음 다양성을 확보하기 위해 ‘Phonetic Diversity Augmentation’을 적용, 문자 단위로 과장된 입술 움직임을 유도해 시각적 구분성을 높인다.

두 번째 단계는 위에서 만든 쌍을 이용해 경량 LoRA(LoRA‑IC)를 학습하는 것이다. LoRA는 전체 파라미터를 고정한 채 몇 백만 개 정도의 저차원 가중치만 업데이트하므로, 사전학습된 LTX‑2의 풍부한 멀티모달 지식을 그대로 보존한다. 학습 시에는 번역 텍스트 프롬프트와 원본 오디오‑비디오 컨텍스트를 동시에 입력해, 모델이 ‘음성 → 시각’ 교차주의(attention) 메커니즘을 통해 번역된 음성과 그에 맞는 입술 움직임을 공동으로 생성하도록 유도한다. 이때 텍스트 프롬프트는 전체 전사와 목표 언어 번역문을 모두 포함하므로, 실제 번역 모델이 필요 없으며, 모델 자체가 조건부 생성 과정에서 시간적 정렬을 자동으로 맞춘다.

기술적 강점은 다음과 같다. (1) 단일 모델 구조: 오디오와 비디오를 별도 모듈로 처리하지 않고 하나의 확산 트랜스포머가 동시에 다루어, 두 모달리티 간의 상호 의존성을 자연스럽게 학습한다. (2) 데이터 효율성: 실제 다국어 영상 쌍이 부족한 상황에서도, 자체 생성 파이프라인을 통해 대규모 합성 데이터셋을 자동으로 만들 수 있다. (3) 정밀 마스킹: Latent‑Aware Fine Masking은 기존 인페인팅 방식에서 발생하던 ‘원본 누수’를 효과적으로 차단해, 진정한 의미의 리다이렉션을 가능하게 한다. (4) 경량 파인튜닝: LoRA‑IC는 수백만 파라미터만 조정하므로, GPU 메모리와 학습 시간 측면에서 실용적이며, 새로운 언어 쌍이나 도메인에 빠르게 적응할 수 있다.

실험에서는 다양한 실세계 영상(비정형 배경, 부분 가림, 비정면 촬영 등)과 5개 이상의 언어쌍을 대상으로 기존 모듈식 파이프라인(음성 변환 + 오디오‑드리븐 립싱크, 혹은 비디오‑디프레임 기반 편집)과 비교했다. 정량 평가지표인 LSE(입술 동기화 오류), FID(시각 품질), 그리고 주관적 MOS 평가에서 모두 유의미하게 우수한 결과를 보였다. 특히, 비정면 혹은 빠른 머리 움직임이 있는 경우에도 입술‑음성 정렬이 깨지지 않는 점이 큰 차별점으로 강조된다.

한계점으로는 (a) 현재는 텍스트 프롬프트에 번역문을 직접 삽입하는 방식이라 번역 품질이 외부 번역 엔진에 의존한다는 점, (b) 매우 긴 영상(수십 초 이상)에서는 확산 샘플링 비용이 급증한다는 점, (c) 다중 화자가 동시에 등장하는 씬에서는 화자 구분이 아직 미흡하다는 점을 들 수 있다. 향후 연구에서는 자동 번역-조건화 통합, 효율적인 장기 시퀀스 샘플링, 그리고 화자 분리 모듈을 LoRA와 결합하는 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기