다운스트림 피드백을 활용한 가치 기반 사전학습

초록

V‑Pretraining은 소량의 검증용 다운스트림 라벨을 이용해 프리트레인 단계의 목표를 동적으로 재설계함으로써, 기존의 고정된 프리트레인 손실(예: 다음 토큰 예측)보다 더 높은 다운스트림 가치(예: 수학 추론, 밀집 시각 인식)를 얻는다. 언어와 비전 양쪽에서 0.5B‑7B 규모 모델에 적용해 동일한 학습 예산 하에 GSM8K 정확도 18% 향상, ADE20K mIoU 1.07 상승 등 실험적 이득을 확인한다.

상세 분석

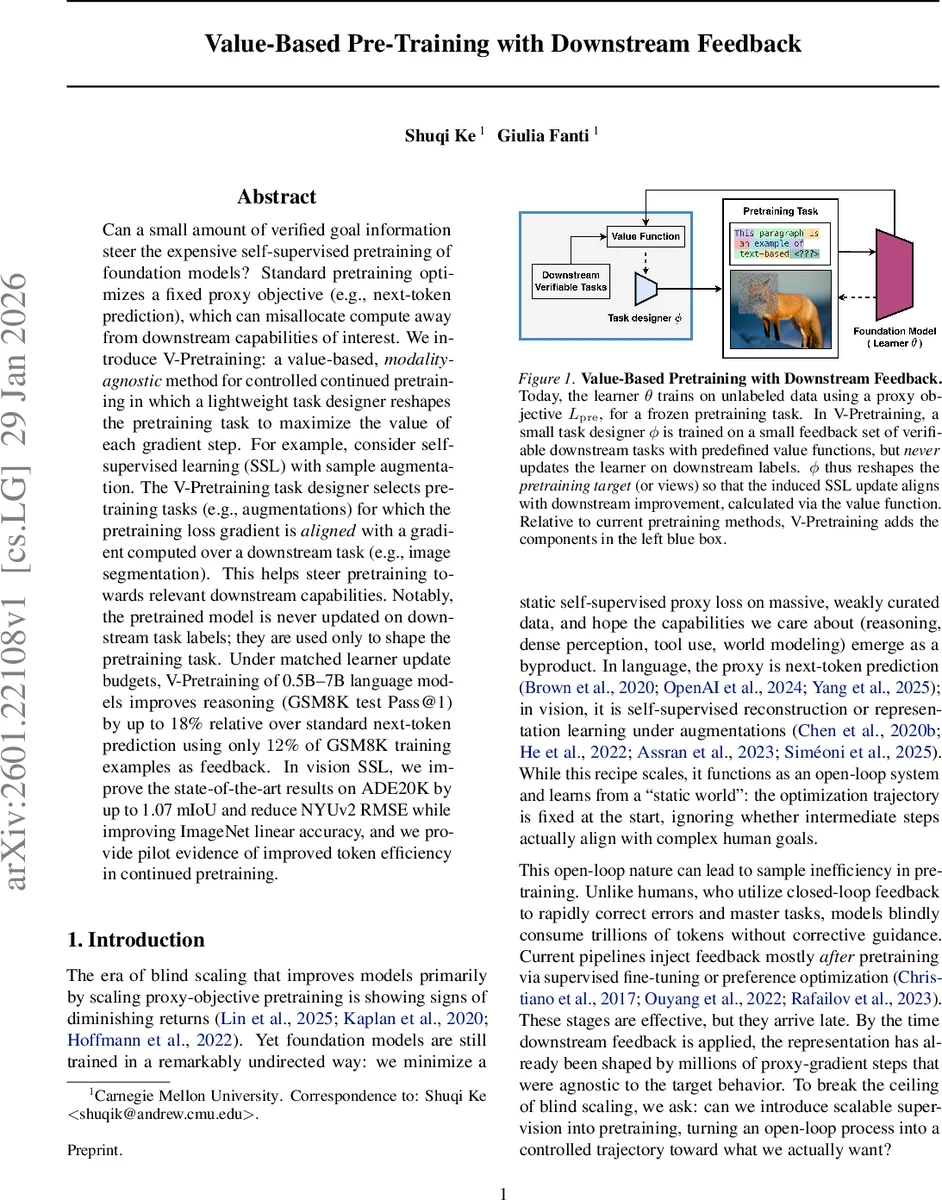

본 논문은 “가치 기반 사전학습(Value‑Based Pre‑training, V‑Pretraining)”이라는 프레임워크를 제안한다. 핵심 아이디어는 두 개의 모듈을 분리하는 것이다. 대규모 학습 파라미터 θ를 가진 ‘학습자(learner)’는 기존과 동일하게 방대한 비라벨 데이터에 대해 예측 손실 L_pre을 최소화한다. 반면, 작은 파라미터 ϕ를 가진 ‘작업 설계자(task designer)’는 제한된 검증용 라벨 집합(예: GSM8K, ADE20K)을 이용해 다운스트림 손실 L_down의 그래디언트와 학습자의 현재 프리트레인 그래디언트 g_pre을 정렬하도록 목표 V(ϕ;θ)=g_downᵀ g_pre을 최대화한다. 이 정렬은 1차 테일러 전개를 기반으로 하며, 단일 프리트레인 스텝이 다운스트림 손실을 얼마나 감소시킬지를 근사한다.

계산 효율성을 위해 전체 파라미터가 아닌 어댑터 혹은 최상위 레이어에 대해 헤시안‑벡터 곱을 수행한다. 언어에서는 토큰의 원-핫 라벨을 학습자의 상위 K 예측에 기반한 소프트 타깃으로 교체하고, 비전에서는 고정된 데이터 증강 대신 인스턴스‑별로 학습 가능한 뷰 A_ϕ를 생성한다. 이렇게 설계된 목표는 기존 프리트레인 루프를 거의 변경하지 않으면서도, 매 스텝마다 ‘가치’를 높이는 방향으로 신호를 변형한다.

실험에서는 동일한 업데이트 예산(예: 0.5B‑7B 파라미터 모델에 0.5 B 토큰 수준의 추가 학습) 하에 V‑Pretraining이 표준 다음‑토큰 예측 대비 GSM8K Pass@1을 2‑14% 향상시켰으며, 전체 GSM8K 데이터의 12%만 사용했다는 점이 주목할 만하다. 비전 분야에서는 MAE‑style 마스크드 오토인코더에 인스턴스‑별 뷰를 적용해 ADE20K mIoU를 최대 1.07 포인트, NYUv2 깊이 RMSE를 감소시키고, 동시에 ImageNet 선형 정확도도 유지 혹은 소폭 개선하였다.

또한 토큰 효율성, 파라미터‑예산 대비 가치 향상, 그리고 다른 다운스트림 태스크에 대한 일반화 손실이 없음을 다양한 ablation과 파레토 분석을 통해 검증한다. 이 프레임워크는 기존 스케일링, 데이터 커리큘럼, 사후 정렬 기법과 독립적으로 결합 가능하다는 점에서, ‘작은 피드백을 통한 폐쇄‑루프 사전학습’이라는 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기