MasalBench 페르시아 속담 이해 벤치마크

초록

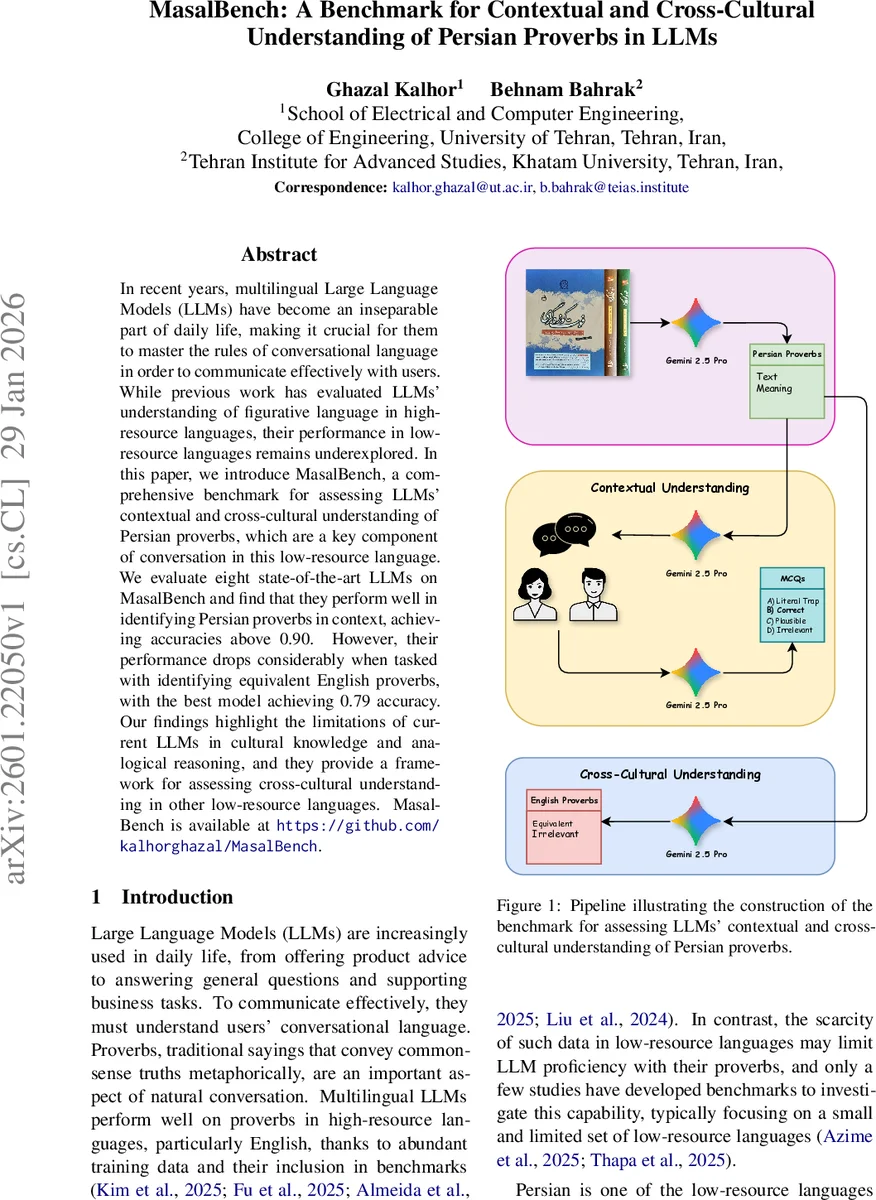

MasalBench는 페르시아 속담의 문맥 이해와 영어 등가 속담 매칭을 평가하기 위해 1,000개의 다중선택 질문과 700개의 이진 선택 질문으로 구성된 벤치마크이다. 8개의 최신 다국어 LLM을 실험한 결과, 모델들은 문맥 내 속담 의미 파악에서는 0.90 이상 높은 정확도를 보였지만, 영어 등가 속담을 찾는 교차문화 과제에서는 0.65~0.79 수준으로 성능이 크게 떨어졌다. 모델 크기와 instruction‑tuning이 성능에 영향을 미치며, 오류는 주로 의미적으로 타당하지만 잘못된 ‘plausible’ 선택지에서 발생한다.

상세 분석

MasalBench는 두 차원—문맥적 이해와 교차문화 매핑—을 동시에 측정하도록 설계되었다. 문맥 이해 파트는 1,000개의 대화형 다중선택 문제로, 각 문제는 ‘문자 그대로의 함정(literal trap)’, ‘논리적이지만 틀린 해석(plausible)’, ‘무관한 선택지(irrelevant)’라는 세 종류의 교란 옵션을 포함한다. 이러한 설계는 모델이 단순히 표면적인 단어 매칭이 아니라 은유적 의미와 화자 의도를 파악하도록 강제한다. 교차문화 파트는 700개의 이진 선택 문제로, 페르시아 속담과 의미가 가장 유사한 영어 속담을 찾게 한다. 여기서 교란 선택지는 형태·톤·이미지는 유사하지만 의미는 다른 속담으로, 문화적 아날로지를 요구한다.

실험에서는 Llama 4 Scout, Llama 3.3 70B Instruct, Qwen 2.5 72B Instruct, Qwen QwQ 32B, DeepSeek V3.1, DeepSeek R1, GPT‑4.1 mini, GPT‑4o mini 등 8개 모델을 zero‑shot 설정(temperature = 0, top‑p = 1)으로 평가했다. 문맥 이해에서는 DeepSeek V3.1(671 B 파라미터)이 0.943의 최고 정확도를 기록했으며, 전반적으로 모델 크기와 instruction‑tuning이 성능을 끌어올렸다. 오류 분석에서 대부분이 ‘plausible’ 교란 선택지에 몰렸으며, 이는 모델이 의미적으로 일관된 답변을 선호하지만 정확한 문화적 해석을 놓치는 경향을 보여준다. 반면 ‘literal’과 ‘irrelevant’ 오류는 0~2% 수준에 불과했다.

교차문화 매핑에서는 DeepSeek R1이 0.793으로 가장 높은 점수를 받았지만, 전체적으로는 0.65~0.79 사이에 머물렀다. 이는 단순 언어 변환을 넘어 문화적 배경지식과 아날로지 추론이 필요함을 의미한다. instruction‑tuning이 일부 개선을 가져왔지만, 훈련 데이터에 문화적 사례가 충분히 포함되지 않은 경우 성능 향상이 제한적이었다. 또한, 영어 등가 속담 자체가 제한적이어서 평가 난이도가 높아졌다는 점도 논의되었다.

본 연구는 저자원이지만 문화적으로 풍부한 언어(페르시아)에서 LLM의 한계를 명확히 드러낸다. 모델이 문맥 내 은유를 파악하는 능력은 이미 높은 수준에 도달했으나, 문화 간 전이와 아날로지 추론에서는 여전히 큰 격차가 존재한다. 향후 연구는 다국어 LLM의 문화적 데이터 증강, 멀티모달 학습, 그리고 교차문화 추론을 위한 전용 프롬프트 설계 등을 통해 이러한 격차를 메우는 방향으로 나아가야 할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기