양자 앙상블 학습을 위한 차별력·복잡도 계층 구조

초록

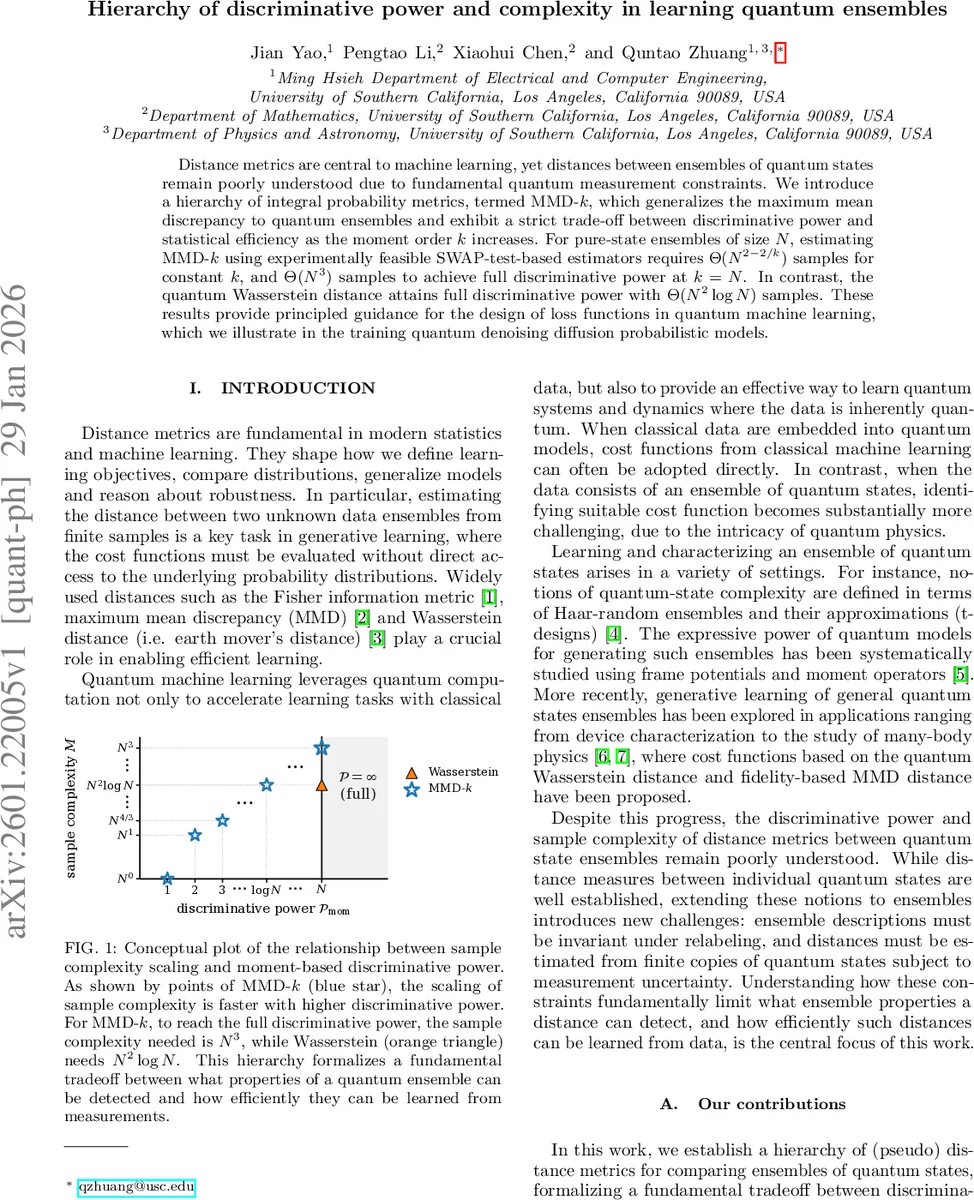

본 논문은 양자 상태 앙상블을 비교하기 위한 새로운 적분 확률 거리인 MMD‑k를 제안한다. k‑차 순간을 이용해 차별력과 샘플 복잡도 사이의 엄격한 트레이드오프를 보이며, 순수 상태 앙상블 크기 N에 대해 MMD‑k를 SWAP‑테스트 기반 추정기로 구현할 경우 k가 고정된 경우 Θ(N^{2‑2/k}) 샘플이 필요하고, 완전 차별력(k = N)에서는 Θ(N³) 샘플이 요구된다. 반면 양자 Wasserstein 거리의 경우 Θ(N² log N) 샘플만으로 완전 차별력을 얻는다. 이러한 이론적 결과를 바탕으로 양자 디노이징 확산 확률 모델(QuDDPM)의 손실 함수 설계에 적용해 실험적 유효성을 확인한다.

상세 분석

논문은 먼저 양자 앙상블을 “라벨이 붙은 (pₓ, ρₓ) 쌍의 집합”으로 정의하고, 라벨 순열에 불변하는 거리의 필요성을 강조한다. 기존의 클래식‑양자(CQ) 상태 표현은 라벨에 의존해 동일한 앙상블을 서로 다른 상태로 매핑하므로, 라벨‑불변성을 보장하지 못한다는 점을 지적한다. 이를 해결하기 위해 저자들은 적분 확률 거리(IPM)의 한 형태인 MMD‑k를 도입한다. MMD‑k는 두 앙상블의 k‑차 순간 연산자 ρ^{⊗k}와 σ^{⊗k} 사이의 Hilbert‑Schmidt 거리로 정의되며, k가 커질수록 더 높은 차원의 순간 정보를 활용한다. 핵심 정리 III.3은 D^{(k)}(E₁,E₂)=0 ⇔ E₁와 E₂의 k‑차 순간 연산자가 동일함을 보이며, k₁ > k₂이면 D^{(k₁)}가 D^{(k₂)}보다 강한 차별력을 가진다(즉, C_{k₂}⊂C_{k₁}). 정리 II.4는 N개의 서로 다른 순수 상태를 포함하는 앙상블에 대해 k ≥ N이면 순간 연산자가 전체 앙상블을 완전히 규정하므로 차별력이 무한(Full)임을 증명한다.

샘플 복잡도 분석에서는 SWAP‑테스트 기반 추정기를 설계한다. 두 상태 |ψ⟩,|ϕ⟩에 대해 |⟨ψ|ϕ⟩|^{2k}를 추정하려면 k번의 SWAP‑연산을 연쇄적으로 적용해야 하며, 이는 각 순간에 O(N)개의 샘플을 필요로 한다. 저자들은 이 과정을 수학적으로 전개해, 고정된 k에 대해 평균 제곱 오차 ε를 달성하려면 Θ(N^{2‑2/k}) 샘플이 필요함을 도출한다. k를 N까지 증가시키면 복잡도는 Θ(N³)으로 급격히 상승한다. 반면, 양자 Wasserstein 거리의 경우 최적 운송 행렬을 추정하기 위한 샘플 복잡도가 Θ(N² log N)으로, MMD‑k보다 효율적임을 확인한다.

실험 섹션에서는 QuDDPM(Quantum Denoising Diffusion Probabilistic Model) 학습에 MMD‑k를 손실 함수로 적용한다. 저차 MMD‑1은 평균 상태만을 맞추므로 복잡한 구조를 가진 목표 앙상블을 구분하지 못한다. 반면, MMD‑3, MMD‑4 등 고차 순간을 활용한 손실은 훈련 초기에 빠른 수렴을 보이며, 최종적으로 Wasserstein 거리와 동등하거나 더 나은 퍼포먼스를 달성한다. 이는 차별력과 샘플 효율성 사이의 트레이드오프를 실제 모델 설계에 반영할 수 있음을 실증한다.

전체적으로 이 논문은 양자 머신러닝에서 손실 함수 선택이 “얼마나 많은 순간 정보를 활용하느냐”와 “그 정보를 얼마나 효율적으로 추정하느냐” 사이의 균형을 필요로 함을 이론·실험적으로 입증한다. 특히, MMD‑k라는 계층적 거리 패밀리를 제시함으로써, 사용자는 목표 앙상블의 복잡도에 맞춰 최소 차별력(k)만을 선택해 샘플 비용을 최소화할 수 있다. 이는 양자 데이터가 제한된 실험 환경에서 효율적인 학습을 가능하게 하는 중요한 설계 원칙을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기