중심 논문 제목 기반 그래프 최적화와 커뮤니티 탐지를 통한 LLM 과학 질문응답 강화

초록

CE‑GOCD는 논문 제목을 중심 엔터티로 활용해 학술 지식 그래프에서 관련 서브그래프를 추출하고, 의미 기반 가중치로 정제·보완한 뒤, 모듈러리티 기반 커뮤니티 탐지를 적용한다. 이를 통해 LLM이 다수 논문의 연관성을 파악하고, 보다 정확하고 구체적인 과학 QA를 수행한다. 세 개의 NLP 분야 QA 데이터셋에서 기존 KG·검색 기반 방법들을 크게 앞섰으며, 의료 도메인에서도 경쟁력을 보였다.

상세 분석

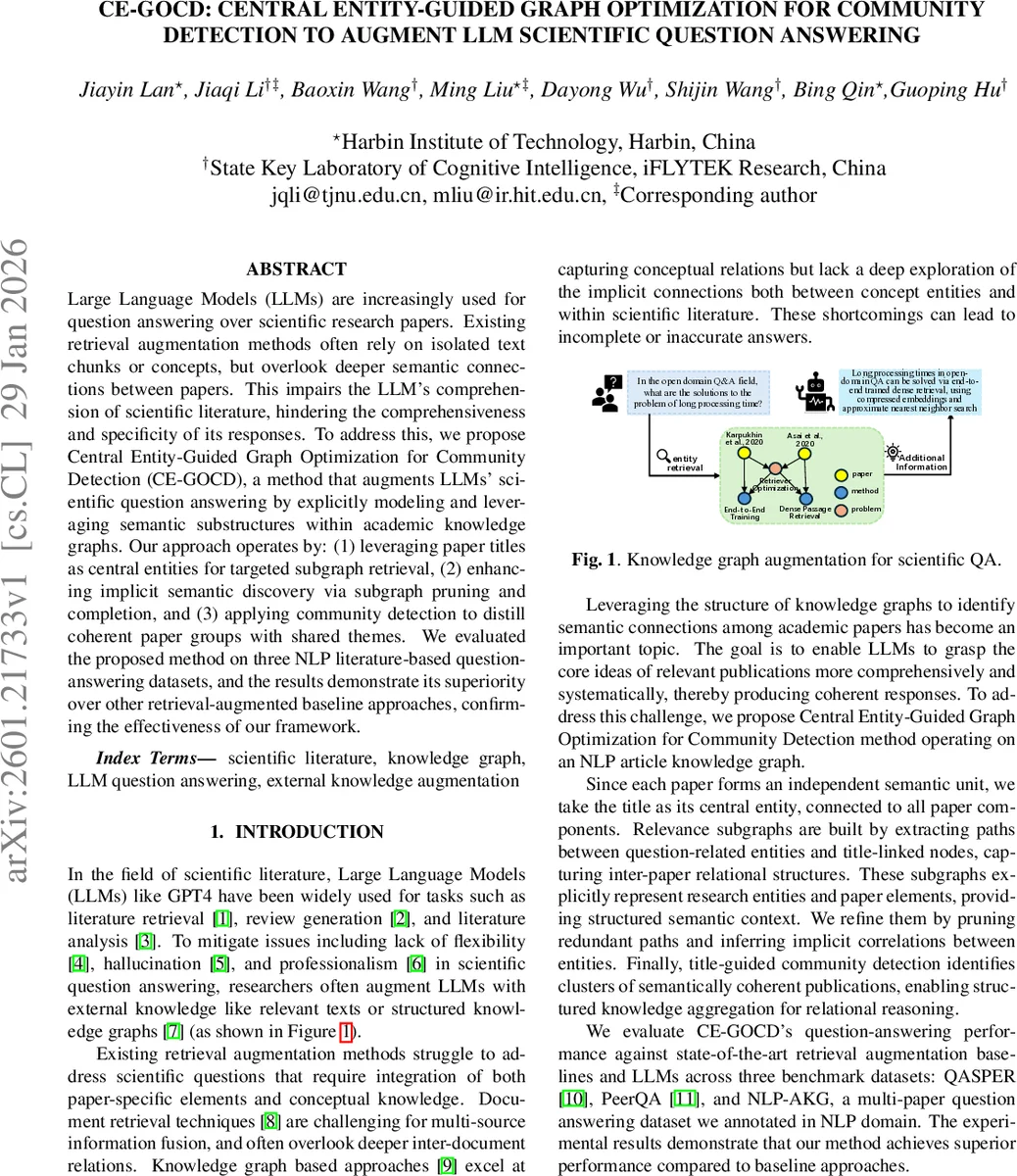

CE‑GOCD는 기존 LLM‑기반 과학 질문응답이 텍스트 청크나 단일 개념에만 의존해 논문 간 깊은 의미 연결을 놓치는 문제를 해결하고자 설계되었다. 핵심 아이디어는 논문 제목을 ‘중심 엔터티’로 정의하고, 질문에서 추출된 키워드와 엔터티 타입을 기반으로 타이틀과 연결된 서브그래프를 구축하는 것이다. 구체적으로, 질문 Q에서 LLM이 키워드 집합 K와 엔터티 타입 T를 도출하고, 각 키워드에 대해 TF‑IDF 매칭으로 상위 10개 엔터티를 후보로 선정한다. 이후 LLM‑필터링을 통해 불필요한 엔터티·관계를 제거하고, 서로 다른 키워드에서 나온 엔터티 쌍을 연결하는 경로를 최대 5홉까지 탐색한다. 이렇게 얻어진 경로와 타이틀‑엔터티 직접 연결을 포함한 이웃 서브그래프가 초기 ‘관련 서브그래프’가 된다.

다음 단계인 서브그래프 최적화는 ‘프루닝’과 ‘컴플리션’ 두 과정으로 이루어진다. 프루닝에서는 (엔터티 i, 엔터티 j) 사이의 가중치 w_ij를 계산한다. w_ij는 (엔터티 i, 관계 r, 엔터티 j) 삼중항과 질문 키워드 K 사이의 의미 유사도 S_semantic와 관계 타입 r에 부여된 가중치 W_type을 곱한 값이다. 자동 조정되는 임계값 θ보다 낮은 가중치를 가진 엣지는 삭제되고, 고립된 노드도 제거된다. 컴플리션 단계에서는 동일 타입 엔터티들을 임베딩(v_i)으로 변환하고 1차원 의미 공간(z_i)으로 투사한다. 연속된 z_i 간의 유클리드 거리 δ_i를 기반으로 IQR‑보정된 거리 임계값 θ를 설정해, 의미적으로 가까운 엔터티 쌍을 후보로 만든다. LLM이 이 후보 쌍에 숨겨진 상관관계를 판단하고, 새로운 관계와 가중치를 서브그래프에 삽입한다. 이 과정을 통해 명시적·암시적 의미 연결이 모두 반영된 고품질 서브그래프 e_G가 완성된다.

마지막으로 커뮤니티 탐지는 Louvain 알고리즘을 이용한 모듈러리티 최적화로 수행된다. 가중치 w_ij를 사용해 논문 타이틀 노드가 가장 높은 가중치 차수를 갖는 중심 타이틀을 각 커뮤니티의 대표로 선정한다. 이렇게 형성된 커뮤니티는 논문 간 주제·방법론·데이터셋 등 공유된 의미 구조를 내포한다. 각 커뮤니티의 관계를 자연어 서술로 변환한 뒤 LLM에 제공하면, LLM은 커뮤니티 수준에서 정보를 통합·요약해 최종 답변을 생성한다.

실험에서는 61 826개의 ACL 논문을 기반으로 구축한 NLP‑AKG(620 353 엔터티, 2 271 584 관계)를 활용했다. QASPER, PeerQA, 자체 구축 NLP‑MQA 세 데이터셋에서 GPT‑4, DeepSeek‑V3, Qwen‑Plus 등 다양한 LLM에 CE‑GOCD를 적용했으며, F1 점수에서 기존 BM25, 임베딩 검색, KAG, MindMap, PathRAG 등 모든 베이스라인을 앞섰다. 특히 GPT‑4와 결합했을 때 평균 F1 0.79 ~ 0.81 수준을 기록, LLM‑only 대비 6 ~ 9% 향상을 달성했다. 의료 도메인(ChatDoctor5K)에서도 MindMap에 근접한 성능을 보여, 분야 간 일반화 가능성을 시사한다.

Ablation 연구에서는 서브그래프 최적화 없이(-SO) 혹은 커뮤니티 탐색 없이(-CD) 수행했을 때 성능이 크게 떨어짐을 확인했다. 프루닝·컴플리션이 의미적 정밀도를 높이고, 커뮤니티 기반 집합적 요약이 답변의 일관성과 포괄성을 강화한다는 결론을 얻었다. 또한 그래프 처리 전후의 삼중항 정확도·관련도 변화를 인간·LLM 평가로 검증했으며, 프루닝·컴플리션이 관계 수는 약간 감소하지만 정확도·관련도는 각각 0.95 → 0.94, 0.48 → 0.66으로 개선됨을 보고했다.

전반적으로 CE‑GOCD는 (1) 논문 제목을 중심으로 한 타깃 서브그래프 추출, (2) 의미 기반 가중치와 자동 임계값을 활용한 정교한 그래프 정제·보완, (3) 커뮤니티 탐지를 통한 구조적 지식 집합이라는 세 축을 결합해, LLM이 다문헌 과학 질문에 대해 더 깊이 있고 정확한 답변을 생성하도록 지원한다.

댓글 및 학술 토론

Loading comments...

의견 남기기