다중모달 스탠스 탐지를 위한 분리형 전문가 모델 DiME

초록

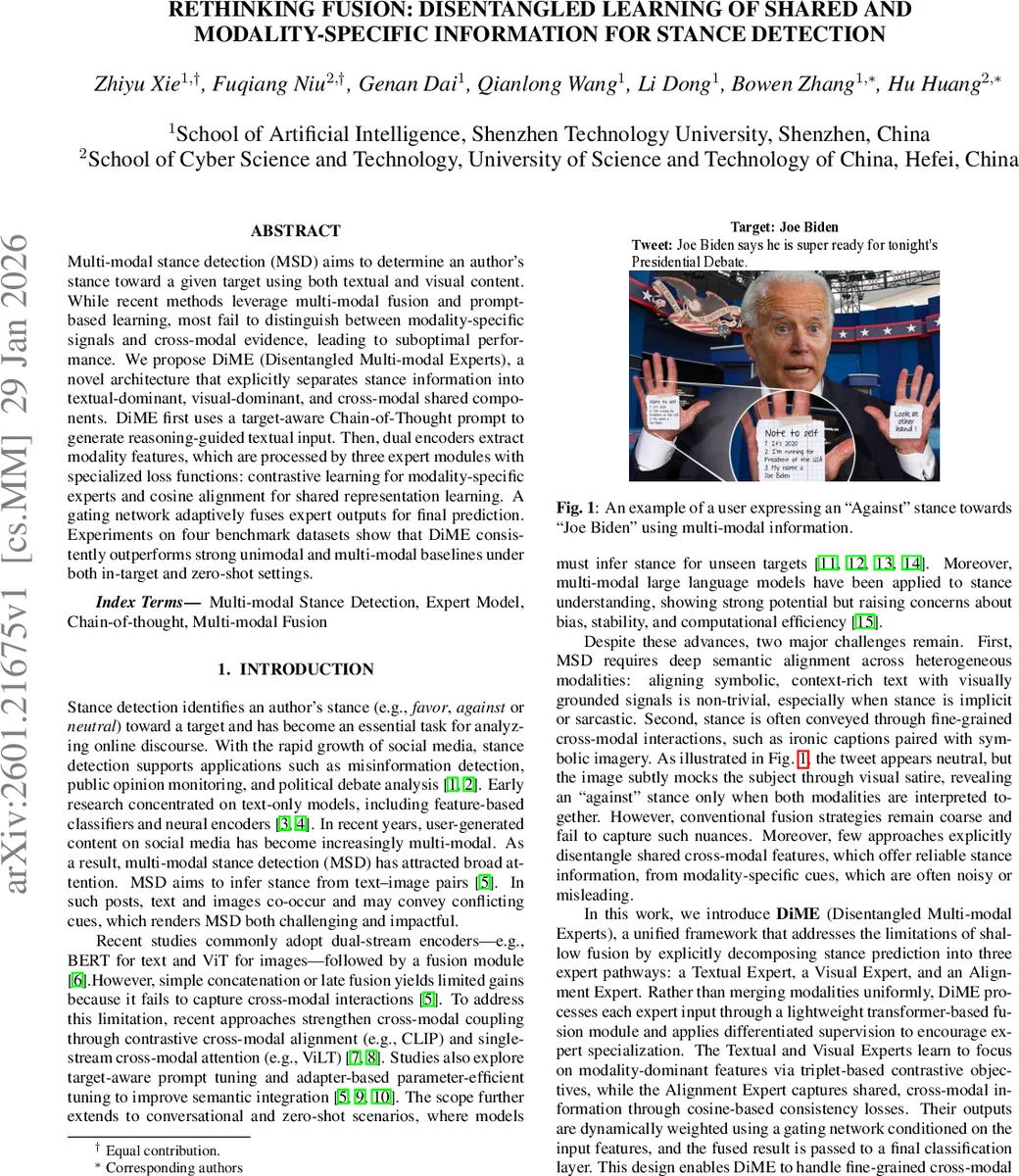

DiME는 텍스트‑주도, 이미지‑주도, 그리고 양모달 공통 정보를 각각 담당하는 세 개의 전문가 모듈을 도입하고, 목표‑인식 체인‑오브‑생각 프롬프트와 가중치 게이팅을 통해 모달별 신호를 명확히 구분한다. 전용 손실(텍스트·이미지 전문가용 트리플렛 마진, 정렬 전문가용 코사인 정합)으로 각 전문가를 전문화시키고, 최종 예측에서는 동적 가중합을 적용한다. 네 개의 MMSD 벤치마크와 제로샷 설정에서 기존 최첨단 모델들을 일관적으로 능가한다.

상세 분석

본 논문은 다중모달 스탠스 탐지(MSD)에서 “모달 간 신호 혼합”이 성능 저하의 주요 원인이라는 점을 정확히 짚어낸다. 기존의 단순 연결(concatenation)이나 late‑fusion 방식은 텍스트와 이미지가 각각 제공하는 독립적·상호보완적 단서를 충분히 활용하지 못한다. DiME는 이러한 한계를 극복하기 위해 세 가지 핵심 설계를 제시한다. 첫째, 목표‑인식 체인‑오브‑생각(CoT) 프롬프트를 이용해 LLM이 텍스트와 이미지를 동시에 해석하도록 유도함으로써, 암시적·풍자적 관계를 명시적인 언어 형태로 변환한다. 이는 특히 텍스트와 이미지가 서로 모순되거나 풍자를 담고 있는 경우에 유용하다. 둘째, 텍스트와 이미지 각각에 대해 BERT와 ViT 기반 인코더를 사용하고, 이를 동일 차원(d)으로 투영한다. 여기서 랜덤 벡터를 시각 프롬프트로 삽입해 시각 특성의 다양성을 확보하고, 모달 간 과적합을 방지한다. 셋째, 세 개의 전문가 모듈을 도입한다. 텍스트 전문가와 이미지 전문가는 각각 (E_t,v, E_t, E_v)와 (E_t,v, E_v, E_t) 형태의 트리플렛을 구성해 마진 손실을 최소화함으로써, “텍스트‑우선”·“이미지‑우선” 신호를 명확히 구분한다. 정렬 전문가(Alignment Expert)는 코사인 유사도 기반 손실을 통해 E_t,v와 각각의 단일 모달 표현(E_t, E_v) 사이의 정렬을 촉진, 양모달 공통 정보를 강화한다. 마지막으로, 두 인코더 출력(e_t, e_v)을 입력으로 하는 두 층 MLP 게이팅 네트워크가 소프트맥스(온도 스케일링)로 각 전문가의 가중치 π_t, π_v, π_t,v를 동적으로 산출한다. 이는 입력마다 텍스트‑우선, 이미지‑우선, 혹은 공통‑우선 전략을 자동 선택하게 해, 특히 텍스트가 지배적인 경우와 이미지가 핵심인 경우 모두에서 유연성을 제공한다. 실험 결과는 네 개의 MMSD 데이터셋(MTSE, MCCQ, MWTWT, MRUC)에서 평균 macro‑F1 68.95점으로, 기존 최고 성능 모델 대비 25%p 상승을 기록한다. 특히 시각·텍스트 상호작용이 복잡한 DF, UKR, JB 도메인에서 88.04, 65.76, 70.85점이라는 뛰어난 점수를 얻어, 전문가 분리와 정렬 손실이 실제로 미묘한 풍자·상징을 포착함을 증명한다. 제로샷 실험에서도 MTSE 60.29, MRUC 53.83 등 목표가 전혀 보이지 않는 상황에서도 경쟁 모델을 앞선다. Ablation 연구는 CoT 프롬프트와 정렬 전문가가 각각 성능에 미치는 영향을 확인해, 두 요소가 없을 경우 macro‑F1가 23%p 하락함을 보여준다. 전체적으로 DiME는 모달 별 신호를 명시적으로 분리하고, 손실 설계와 게이팅 메커니즘을 통해 동적 융합을 구현함으로써, 기존의 얕은 융합 방식보다 더 정교하고 일반화 가능한 MSD 솔루션을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기