멀티모달 시각 대체 압축으로 알츠하이머 진단 혁신

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

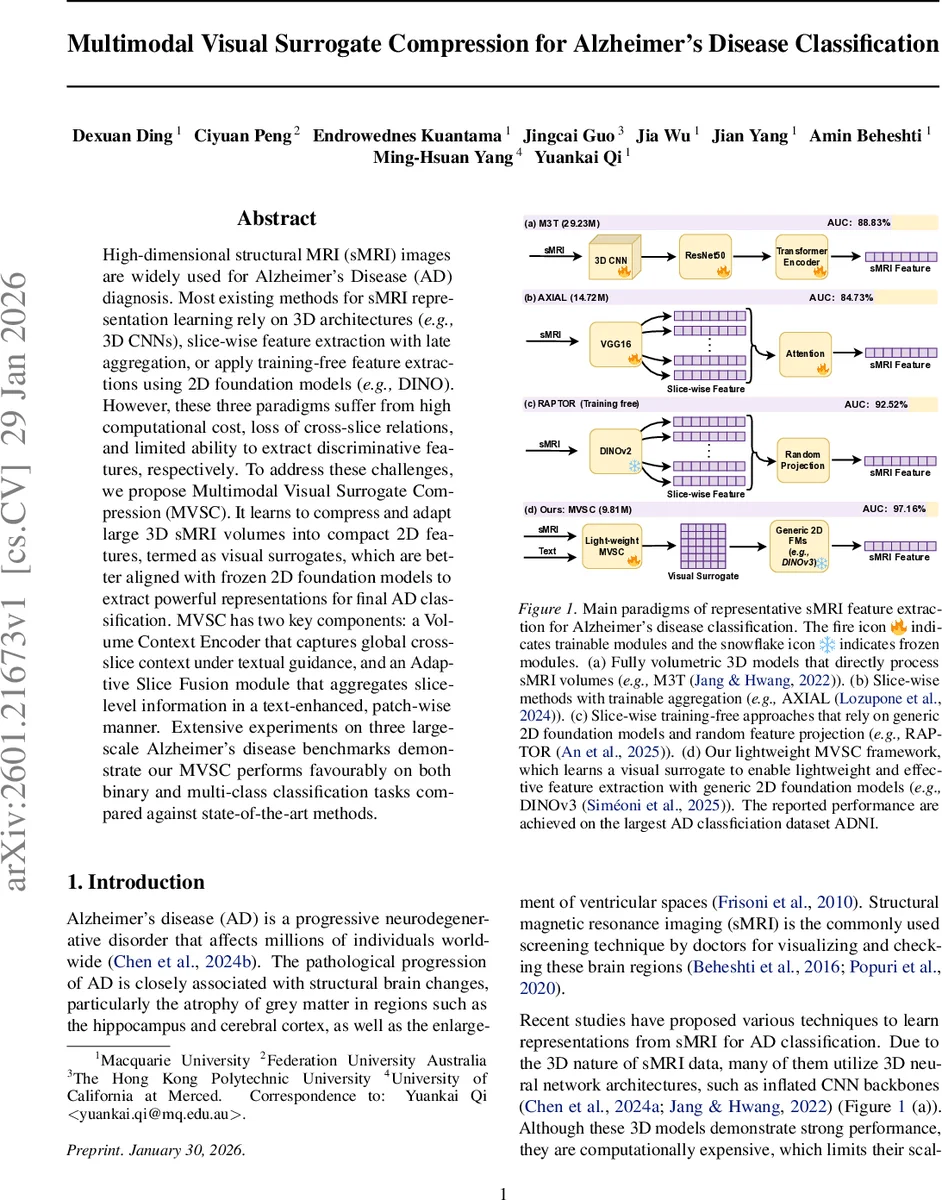

본 논문은 3차원 구조 MRI(sMRI)를 2차원 시각 대체(visual surrogate)로 압축해, 사전 학습된 2D 비전 파운데이션 모델(DINOv3 등)과 효과적으로 결합하는 경량 프레임워크 MVSC를 제안한다. Volume Context Encoder와 Adaptive Slice Fusion 두 모듈을 통해 전역적인 볼륨 컨텍스트와 슬라이스‑레벨 텍스트 정보를 동시에 활용, 교차‑슬라이스 패치 정렬 융합을 수행한다. ADNI 등 대규모 알츠하이머 데이터셋에서 기존 3D CNN, 슬라이스‑와이즈 모델, 훈련‑프리 방법들을 능가하는 성능을 기록한다.

상세 분석

MVSC는 기존 3D CNN 기반 방법이 안고 있는 높은 연산 비용과 메모리 요구, 슬라이스‑와이즈 접근법이 놓치는 장거리 슬라이스 간 상관관계, 그리고 사전 학습된 2D 파운데이션 모델을 그대로 적용했을 때 발생하는 도메인 불일치 문제를 동시에 해결한다는 점에서 혁신적이다. 핵심 아이디어는 3D sMRI 볼륨을 세 가지 변환(정규화된 강도 이미지, 조직 분할, 뇌 마스크)으로 만든 후, 각 변환을 2D 패치 단위로 인코딩하고, 이를 하나의 3채널 이미지(visual surrogate)로 재구성하는 것이다.

-

Volume Context Encoder (VoCE)

- 모든 슬라이스와 패치를 2D CNN 기반 패치 인코더로 임베딩한 뒤, LLaVA‑Med이 생성한 전역 텍스트(g)와 K개의 학습 가능한 전역 쿼리 토큰(Q)을 결합한다.

- 텍스트‑가이드된 쿼리 L = Q + g가 멀티‑헤드 크로스‑어텐션을 통해 전체 시각 토큰에 접근, 전역 볼륨 특징 C를 추출한다.

- 이 과정은 슬라이스 간 장거리 의존성을 한 번에 요약함으로써, 이후 슬라이스‑레벨 융합 단계에서 풍부한 전역 컨텍스트를 제공한다.

-

Adaptive Slice Fusion (ASF)

- 슬라이스 내부에서는 자체 어텐션(SA)으로 패치 간 관계를 모델링하고, 슬라이스‑레벨 텍스트(uₙ)를 선형 변환 ψ(uₙ) 후 모든 패치에 더한다. 이는 각 슬라이스의 해부학·병리적 의미를 시각 특징에 직접 주입한다.

- 전역 특징 C와 결합된 패치‑레벨 특징을 “패치‑정렬” 방식으로 재구성한다. 즉, 동일 공간 위치(p)의 모든 슬라이스 토큰을 모아 하나의 시퀀스 Sₚ에 연결하고, 여기서 다시 크로스‑어텐션을 수행해 전역·슬라이스·패치 정보를 통합한다.

- 평균된 레퍼런스 토큰 rₚ를 구하고, FiLM(γ(g), β(g))을 이용해 전역 텍스트 g에 의해 조절함으로써 텍스트‑조건부 특성 변조를 구현한다. 최종적으로 변환된 패치 특징은 전치(Transposed) 2D CNN을 통해 3채널 visual surrogate 이미지로 디코딩된다.

-

파운데이션 모델 연계

- 생성된 visual surrogate는 DINOv3 같은 사전 학습된 2D 비전 파운데이션 모델에 그대로 입력된다. 파운데이션 모델은 고차원 표현을 추출하고, 이를 가벼운 MLP 분류기로 전달해 AD(정상, MCI, AD) 라벨을 예측한다.

- 전체 파이프라인은 9.81M 파라미터만을 사용해 기존 3D 모델(예: M3T 29.23M)보다 3배 가량 가볍고, 연산량도 크게 감소한다.

-

실험 및 결과

- ADNI, OASIS‑3, AIBL 등 세 개의 대규모 데이터셋에서 이진(AD vs CN) 및 다중 클래스( CN, MCI, AD) 분류를 수행했다. MVSC는 AUC 97.16% (ADNI) 등 최고 수준의 성능을 기록했으며, 기존 3D CNN, AXIAL, RAPTOR 등과 비교해 평균 3~5%p 이상의 향상을 보였다.

- Ablation study에서는 VoCE와 ASF 각각을 제거했을 때 성능이 현저히 떨어지는 것을 확인했으며, 텍스트 가이드가 없는 경우에도 전역 컨텍스트만으로는 충분한 구분력을 제공하지 못함을 입증했다.

-

의의와 한계

- MVSC는 “3D → 2D 압축 + 텍스트‑가이드”라는 새로운 패러다임을 제시함으로써, 고해상도 의료 영상에 파운데이션 모델을 손쉽게 적용할 수 있는 길을 열었다.

- 다만, 텍스트 생성에 LLaVA‑Med을 사용하므로 해당 모델의 품질에 의존한다는 점, 그리고 시각 대체가 원본 3D 구조를 완전히 보존하지 못한다는 잠재적 정보 손실 가능성이 남아 있다. 향후 멀티모달 텍스트‑이미지 사전 학습 모델과의 통합, 그리고 다양한 신경퇴행성 질환에 대한 일반화 검증이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기