언어모델을 통한 인공 학습자 교차언어 영향 연구

초록

본 논문은 언어 모델을 통제된 통계 학습자로 활용해 L1 지배도와 L2 노출 시기를 변형함으로써 교차언어 영향(CLI)을 정량적으로 시뮬레이션한다. 5개의 L1(독일어, 스페인어, 그리스어, 한국어, 터키어)과 영어(L2) 쌍을 대상으로 BLiMP와 FCE 데이터셋을 이용해 문법 정확도와 비원어민 작문 선호도를 측정하고, LogitLens를 통해 L1 활성화를 내부적으로 확인한다. 결과는 L1 지배도가 높고 L2 숙련도가 낮을수록 부정적 전이가 강해지며, 문법 구조의 프라이밍은 양방향이지만 비문법 구조는 지배도에 민감함을 보여준다.

상세 분석

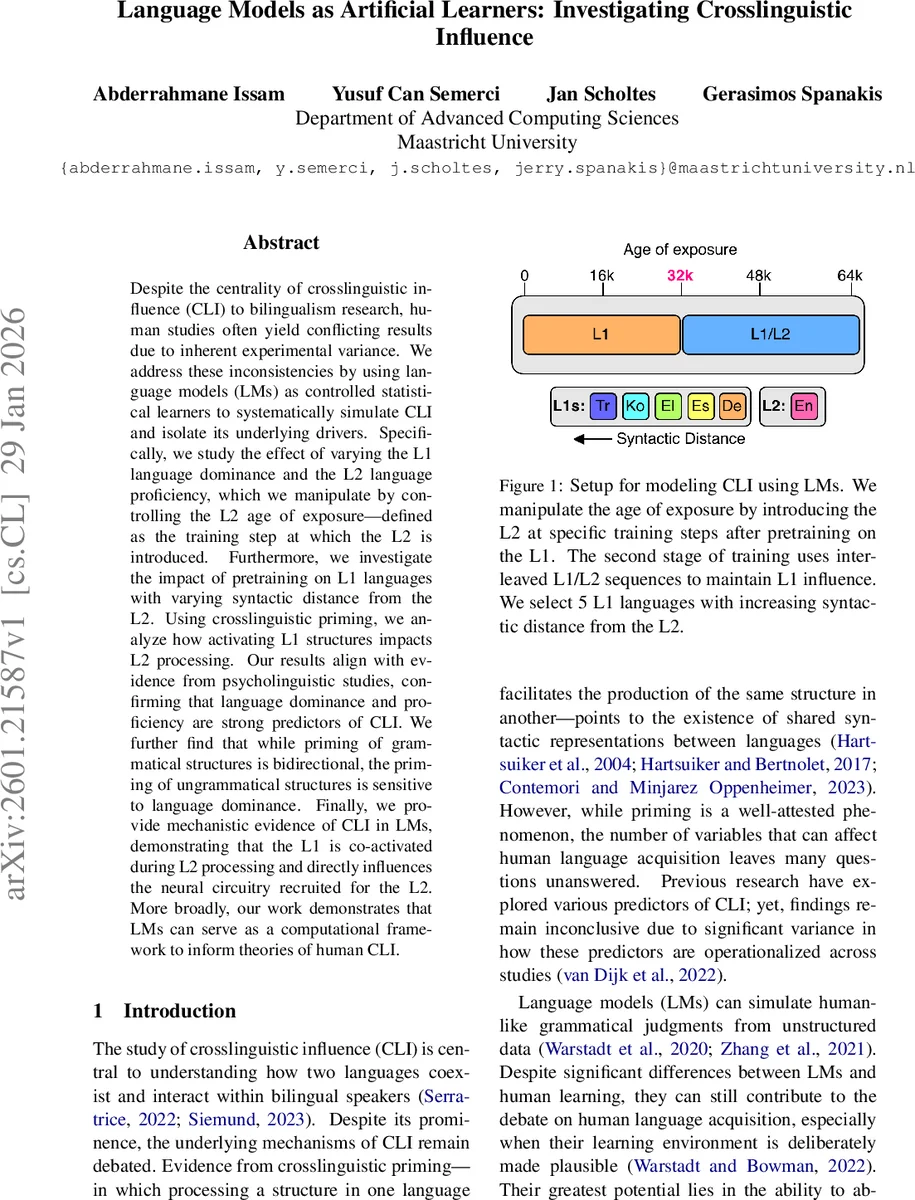

이 연구는 언어 모델을 ‘인공 학습자’로 설정하고, 인간 bilingual acquisition에서 핵심 변수인 L1 지배도와 L2 숙련도를 모델 훈련 단계(age of exposure)로 정밀하게 조작한다는 점에서 방법론적 혁신성을 가진다. L2를 0, 16K, 32K, 48K 단계에서 도입함으로써 L1에 대한 파라미터 고착화 정도와 L2에 대한 총 노출량을 동시에 변화시켰으며, interleaved L1/L2 시퀀스를 사용해 catastrophic forgetting을 방지했다. 이는 인간의 언어 습득에서 연령에 따른 가소성 감소와 입력량 제한을 모델링한 것으로, 실험 통제가 뛰어나다.

언어 선택은 syntactic distance를 9~27 수준으로 측정한 5개의 L1을 사용했으며, 이는 WALS 기반 비공유 특징 수로 정의된다. 이렇게 다양한 거리의 L1을 도입함으로써 ‘언어 간 거리’가 L2 문법 습득에 미치는 영향을 직접 검증한다. 평가에는 BLiMP의 67,000개 최소쌍을 활용해 문법적 정확도를 측정하고, monolingual baseline과의 차이를 CLI 효과(CLI L1→L2)로 정량화했다. 긍정적 값은 L1이 L2에 부정적 전이(interference)를, 부정적 값은 긍정적 전이(transfer)를 의미한다.

또한, FCE 데이터셋을 이용해 비원어민 작문에서 L1 특유의 오류 패턴을 모델이 얼마나 선호하는지를 surprisal 차이(ΔS)로 측정했다. 이는 단순 정확도 외에 ‘interlanguage’ 현상을 포착하는 정교한 방법이다.

프라이밍 실험에서는 NLLB-200-distilled-600M 모델로 L1 번역 프라임을 생성하고, 프라임 유무에 따른 BLiMP 정확도 변화를 분석했다. 결과는 문법 구조 프라밍은 양방향(bidirectional)으로 작동하지만, 비문법 구조 프라밍은 L1 지배도가 높은 경우에만 유의미하게 나타난다는 점을 밝혀, shared‑syntax 가설과 separate‑but‑connected 가설 사이의 중간 입장을 제시한다.

내부 메커니즘 분석에서는 LogitLens를 활용해 L2 문장 처리 중 L1 토큰에 대한 활성화 비중을 시각화했고, L1‑L2 간 neuron overlap을 syntactic distance와 상관시켜 L1이 L2 학습에 구조적으로 영향을 미침을 증명했다. 이는 ‘co‑activation’ 현상이 단순 통계적 상관을 넘어 실제 신경 회로 수준에서 발생한다는 강력한 증거다.

전체적으로, 이 논문은 (1) L1 지배도와 L2 숙련도를 정량적으로 조작하는 새로운 bilingual LM 훈련 프레임워크, (2) syntactic distance가 CLI에 미치는 영향을 BLiMP와 FCE를 통해 다각도로 검증, (3) 프라밍과 내부 활성화 분석을 결합해 인간 CLI 이론에 기계 학습 기반 메커니즘을 제공한다는 세 가지 주요 공헌을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기