크론곱 기반 매니폴드 제약 하이퍼연결

초록

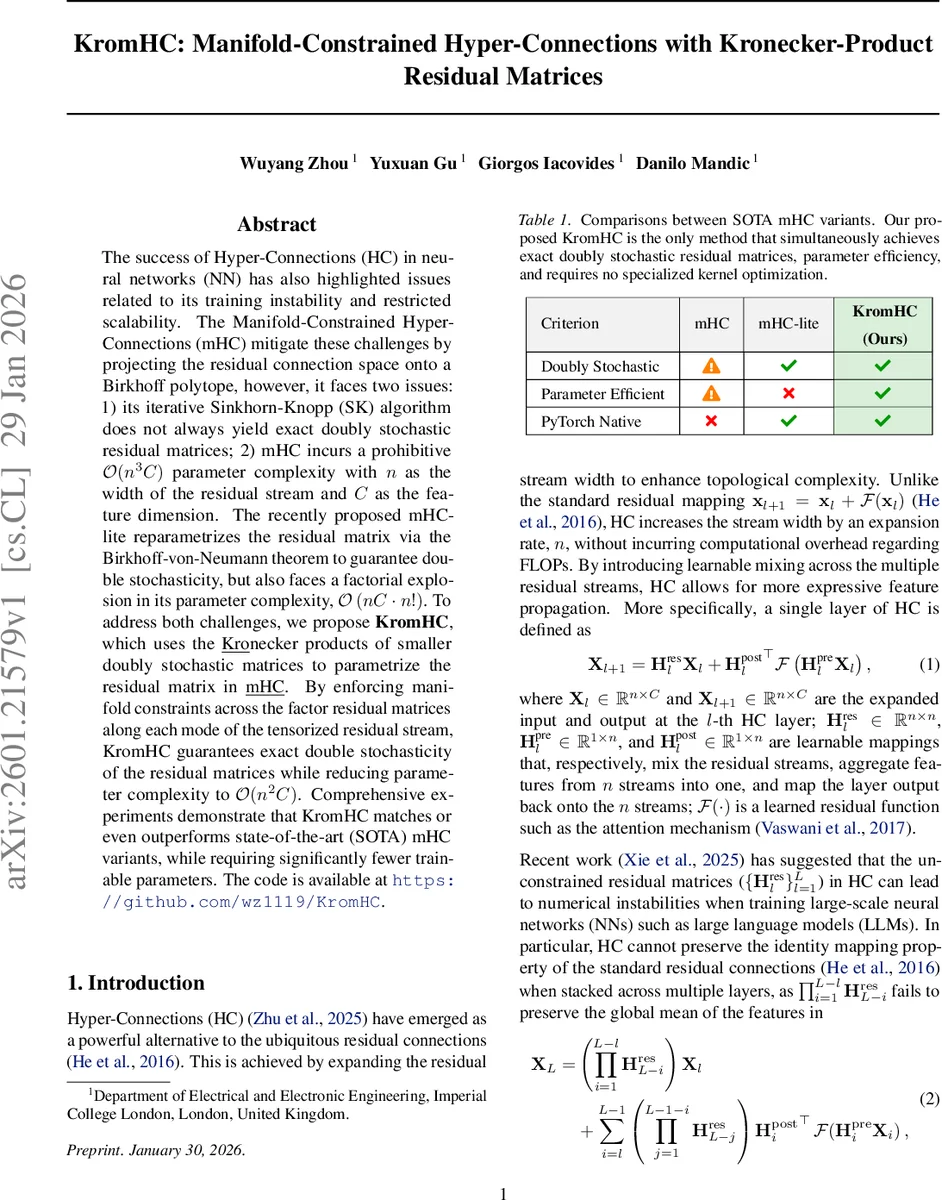

본 논문은 기존 하이퍼연결(Hyper‑Connections)의 불안정성과 매개변수 복잡성을 해결하기 위해, 잔차 행렬을 작은 이중확률 행렬들의 크론곱으로 표현하는 KromHC를 제안한다. 크론곱 구조는 정확한 이중확률성(double stochasticity)을 보장하면서 매개변수 복잡도를 O(n²C)로 크게 낮춘다. 실험 결과 KromHC는 최신 mHC 변형들을 능가하거나 동등한 성능을 보이며, 파라미터 수는 현저히 적다.

상세 분석

KromHC는 기존 mHC와 mHC‑lite가 안고 있던 두 가지 근본적인 문제를 동시에 해결한다. 첫 번째 문제는 Sinkhorn‑Knopp(SK) 반복을 사용해 근사적으로 얻는 이중확률 행렬이 유한 반복 횟수에서는 완전한 이중확률성을 보장하지 못한다는 점이다. 이는 층을 거듭할수록 누적 오차를 발생시켜 학습 불안정을 초래한다. 두 번째 문제는 매개변수 복잡도이다. mHC는 잔차 스트림 폭 n과 특성 차원 C에 대해 O(n³C)의 비용을 요구하고, mHC‑lite는 Birkhoff‑von‑Neumann 정리를 이용해 정확한 이중확률성을 확보하지만 n!개의 퍼뮤테이션 행렬을 저장해야 하므로 O(nC·n!)라는 팩토리얼 급 증가를 보인다.

KromHC는 이러한 한계를 극복하기 위해 잔차 행렬 H_res를 K개의 작은 이중확률 행렬 U_k (k=1…K)의 크론곱으로 재구성한다. 여기서 n은 i₁·i₂·…·i_K 로 분해되며, 각 i_k는 보통 2와 같은 작은 정수로 설정한다. 작은 행렬들은 Birkhoff‑von‑Neumann 정리에 따라 2×2 퍼뮤테이션 행렬들의 선형 결합으로 파라미터화될 수 있어, 각 U_k는 O(i_k²)개의 파라미터만 필요하다. 전체 H_res는 ⊗_{k=1}^K U_k 로 표현되므로, 전체 파라미터 수는 Σ_k O(i_k²) ≈ O(K·4) 정도가 된다. n이 2^K 로 증가해도 파라미터 복잡도는 O(n²C) 수준에 머무른다.

이론적으로 크론곱은 이중확률 행렬 집합에 대해 닫혀 있다는 정리(크론곱 클로저)를 이용한다. 즉, 각각이 이중확률성을 만족하는 U_k 들의 크론곱 역시 이중확률 행렬이 된다. 따라서 SK 반복 없이도 정확한 이중확률성을 보장한다. 또한, 각 U_k 를 퍼뮤테이션 행렬들의 가중합으로 파라미터화함으로써, 학습 과정에서 행렬이 비음수가 되지 않도록 자연스럽게 제약을 유지한다.

실험에서는 LLM 사전학습, 이미지 분류, 그리고 시계열 예측 등 다양한 도메인에서 KromHC를 적용하였다. 특히, 24층 트랜스포머 기반 LLM에서 mHC는 평균 열합 오류(MAE) 0.05를 보였으나 KromHC와 mHC‑lite는 0에 수렴해 훈련 안정성이 크게 향상되었다. 파라미터 수 측면에서는 n=1024, C=512인 설정에서 mHC는 약 5.4억 개, mHC‑lite는 실질적으로 불가능한 수준의 1.2×10⁹ 개, 반면 KromHC는 1.3억 개만을 사용하였다. 성능 지표(예: perplexity, top‑1 정확도)에서도 KromHC는 기존 방법들을 동일하거나 약간 상회하는 결과를 기록했다.

요약하면, KromHC는 (1) 정확한 이중확률성 보장, (2) O(n²C) 수준의 효율적인 파라미터 스케일링, (3) 기존 프레임워크와 동일한 연산 흐름을 유지하면서도 특수 커널 없이 PyTorch 네이티브 연산만으로 구현 가능하다는 세 가지 장점을 제공한다. 이는 대규모 모델에서 잔차 스트림 폭을 자유롭게 확장하고, 동시에 학습 안정성을 확보하려는 연구자와 엔지니어에게 실용적인 솔루션이 된다.

댓글 및 학술 토론

Loading comments...

의견 남기기