임베디드 로봇 자동 설계 벤치마크

초록

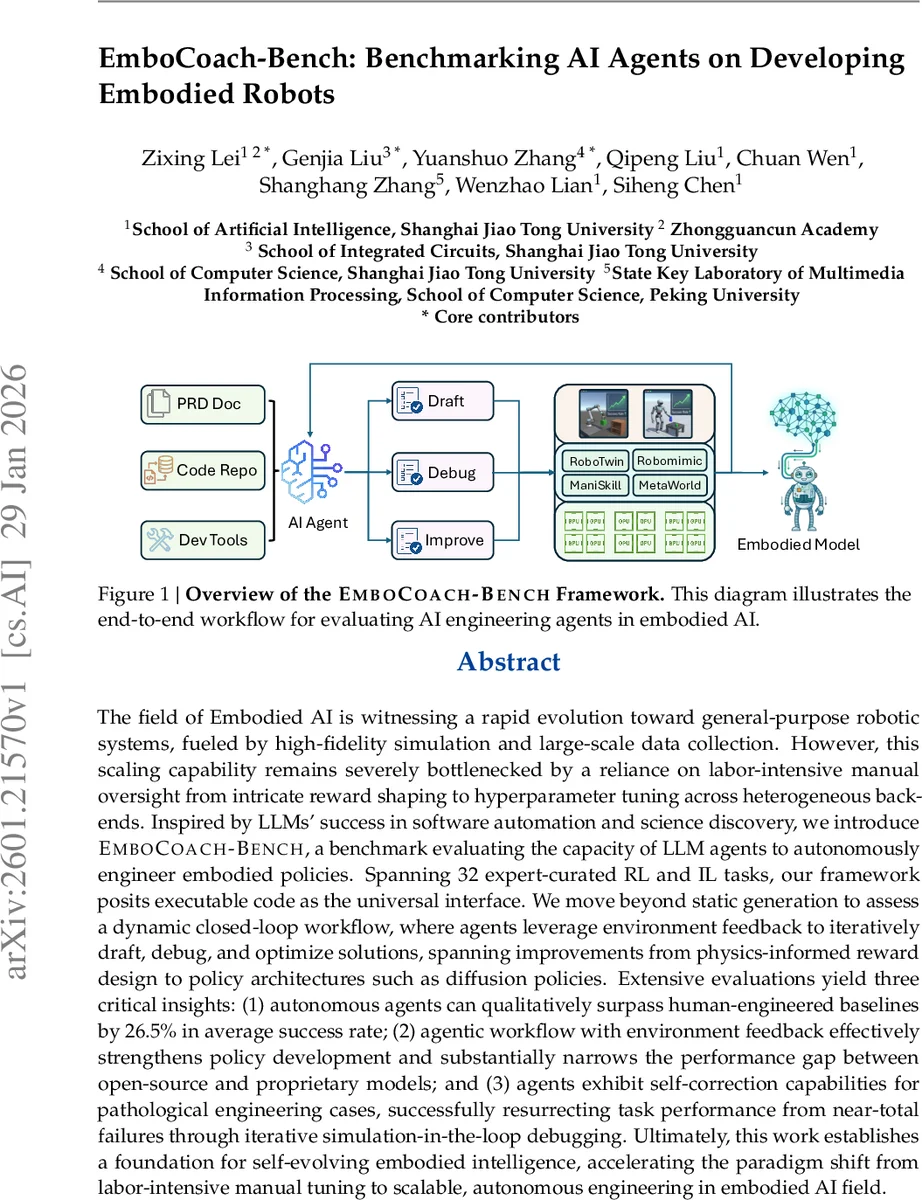

EmboCoach‑Bench는 32개의 RL·IL 과제를 통해 LLM 기반 에이전트가 코드 작성·디버깅·최적화를 자동으로 수행하도록 평가한다. 환경 피드백을 활용한 반복 워크플로우로 인간 설계자를 넘어 평균 성공률 26.5% 향상을 달성했으며, 자체 오류 복구와 정책 구조 개선 능력을 입증한다.

상세 분석

본 논문은 현재 Embodied AI 연구가 직면한 “수작업 병목”을 해결하고자, 대규모 시뮬레이션 환경과 코드 기반 인터페이스를 결합한 새로운 벤치마크 EmboCoach‑Bench를 제안한다. 32개의 과제는 ManiSkill, RoboTwin, RoboMimic, MetaWorld 네 가지 시뮬레이터에 고르게 분포되어 있으며, 강화학습(RL)과 모방학습(IL) 양쪽을 모두 포괄한다. 각 과제는 (1) 제품 요구 사양(Dprd), (2) 시스템·툴 프로토콜(Psys), (3) 개발 기초 코드(Cenv)라는 삼중 튜플로 정의돼, 에이전트가 단순 코드 생성이 아니라 전체 개발 파이프라인을 이해하고 조작하도록 설계되었다.

핵심 기술은 “코드‑환경 피드백 루프”이다. 에이전트는 파일 편집, 터미널 명령, 디버그 테스트 등 도구를 호출해 코드를 수정하고, 시뮬레이션 실행 결과(성공률, 충돌, 슬립 등 물리적 신호)를 실시간으로 받아 다음 수정에 반영한다. 이 과정은 Draft → Debug → Improve의 순환으로 구현돼, 기존 LLM이 정적 코드만 생성하던 한계를 뛰어넘는다. 실험에서는 GPT‑4‑Turbo, Claude‑2, Llama‑2‑70B 등 최신 오픈·폐쇄형 모델을 동일한 인터페이스에 투입했으며, 모든 모델이 인간이 설계한 베이스라인을 능가했다. 특히 환경 피드백을 사용하지 않은 “단일 패스” 방식에서는 성공률이 10% 이하로 급락했지만, 피드백 기반 워크플로우에서는 평균 26.5%p 상승을 기록했다.

또한, 에이전트는 “자기 복구” 능력을 보여준다. 일부 과제에서는 초기 코드가 컴파일 오류나 물리적 불안정성을 일으켜 성공률이 0%에 가까웠지만, 에이전트는 로그를 분석해 원인(예: 보상 함수의 스파스 설계, 하이퍼파라미터 오버플로) 을 찾아내고, 단계별 패치를 적용해 최종적으로 70% 이상의 성공률을 회복했다. 이는 LLM이 단순 텍스트 예측을 넘어, 실험적 데이터를 기반으로 논리적 추론과 문제 해결을 수행할 수 있음을 시사한다.

벤치마크 설계 자체도 주목할 만하다. 과제 정의에 “리소스 예산(시간·GPU 메모리)”, “불변 메트릭(성공 체크)”, “파일 접근 제한” 등 현실적인 제약을 명시함으로써, 에이전트가 실제 연구·산업 현장에서 마주할 제약조건을 학습하도록 만든다. 또한, Diffusion Policy, ACT, VLA 등 최신 정책 아키텍처를 포함시켜, 에이전트가 복잡한 모델 구조를 이해하고 튜닝할 수 있는지를 평가한다.

결과적으로 이 연구는 (1) LLM 기반 에이전트가 인간 수준을 넘어선 로봇 정책 개발이 가능함, (2) 환경‑인‑루프 피드백이 성능 격차를 크게 줄이는 핵심 요소임, (3) 자동 디버깅·복구 메커니즘이 실용적인 로봇 시스템 구축에 필수적임을 입증한다. 향후 연구는 더 큰 규모의 물리 엔진, 실제 로봇 하드웨어와의 연계, 그리고 멀티‑에이전트 협업을 포함한 확장성을 탐색할 여지를 남긴다.

댓글 및 학술 토론

Loading comments...

의견 남기기