노트투챗: 의료 기록을 활용한 다회전 임상 병력 청취 LLM 향상

초록

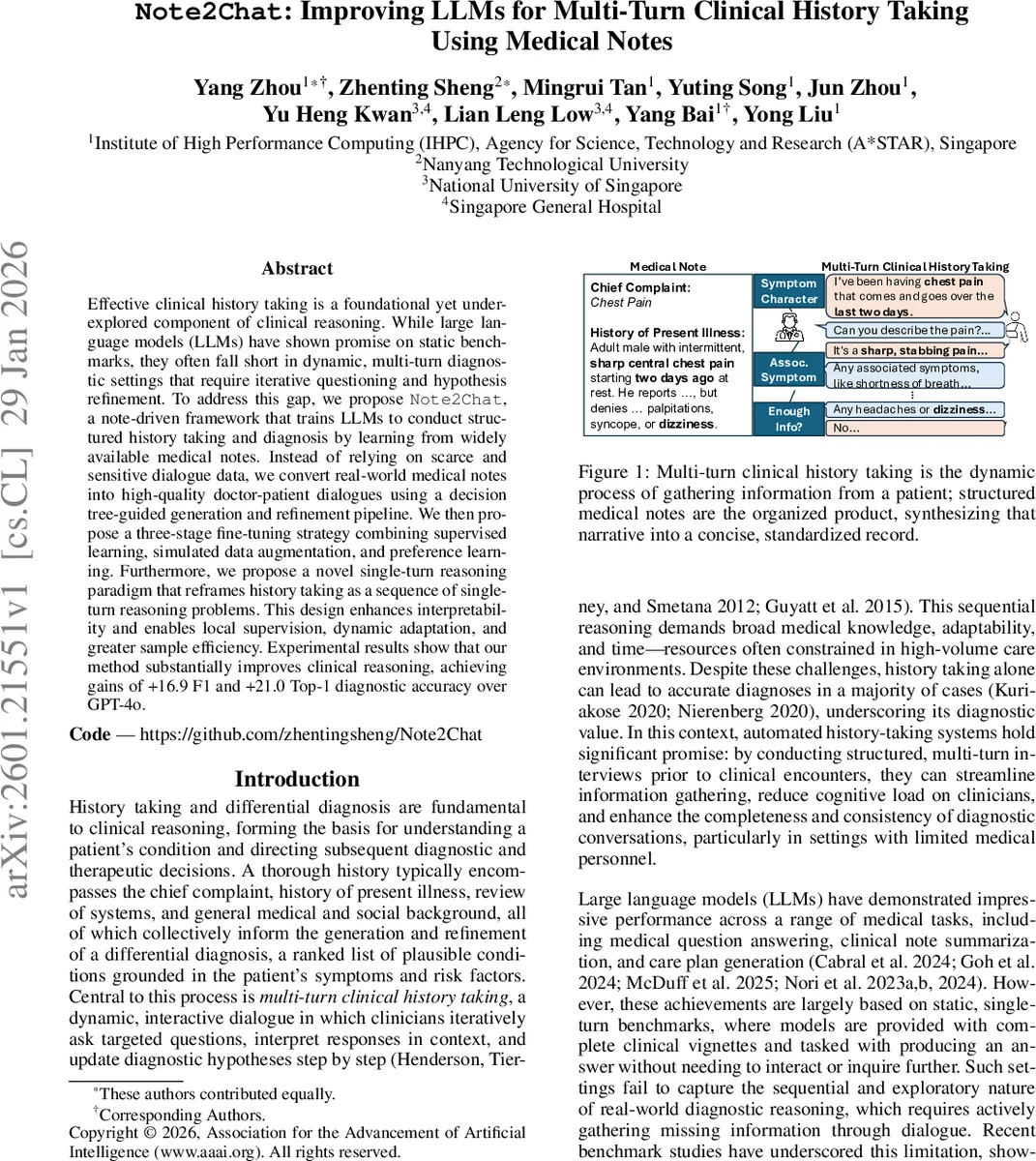

Note2Chat은 방대한 임상 기록을 의사‑환자 대화로 변환하고, 세 단계(지도학습·시뮬레이션 증강·선호 학습) 파인튜닝과 단일턴 추론 패러다임을 도입해 LLM의 다회전 병력 청취와 진단 능력을 크게 끌어올린다. GPT‑4o 대비 F1 +16.9, Top‑1 정확도 +21.0을 달성했다.

상세 분석

본 논문은 임상 현장에서 가장 핵심적인 “병력 청취”를 LLM이 수행하도록 설계된 최초의 프레임워크 중 하나로 평가된다. 주요 기술적 기여는 다음과 같다.

-

노트‑투‑대화 파이프라인: 저자들은 MIMIC‑IV에서 HPI와 주요 진단을 추출해 환자 상태를 정의하고, 진단 트리를 기반으로 질문‑응답 흐름을 설계한다. 이후 LLM‑기반 ‘critic‑revise’ 단계에서 누락된 증상이나 과도한 추론을 자동 교정함으로써, 실제 임상 상황에 근접한 고품질 대화를 생성한다. 이 과정은 인간 어노테이션 없이도 8,944개의 대화와 67,077개의 성공적인 롤아웃을 확보한다는 점에서 데이터 스케일링 측면에서 큰 의미가 있다.

-

3단계 파인튜닝 전략

- Cold‑start SFT: Qwen2.5‑7B를 베이스로, 생성된 대화 데이터를 이용해 기본적인 질문‑응답 구조와 초기 진단 흐름을 학습한다.

- Self‑augmentation: 모델이 자체적으로 환자 에이전트(Qwen2.5‑32B)와 셀프플레이를 수행해 비이상적인 상황(오답, 누락, 불필요 질문 등)을 경험하게 함으로써 일반화 능력을 강화한다.

- Preference Learning (DPO): 인간 혹은 모델이 만든 ‘선호 쌍’(11,403개)을 활용해, 정보 획득 효율과 진단 정확도를 동시에 최적화한다.

-

단일턴 추론 패러다임: 기존의 “전체 대화 흐름을 한 번에 학습”하는 접근과 달리, 각 턴을 독립적인 의사결정 문제로 재구성한다. 이는 (i) 각 질문에 대한 정보이득을 명시적으로 보상 설계에 반영, (ii) 대화 히스토리를 입력으로 활용해 투명한 추론 과정을 제공, (iii) 로컬 슈퍼비전이 가능해 데이터 효율성을 크게 높인다.

-

실험 결과: Note2Chat은 GPT‑4o 대비 F1 점수에서 +16.9, Top‑1 진단 정확도에서 +21.0% 향상을 보였으며, 정보 획득 측면에서는 +57.53%의 상대적 개선을 기록한다. 이는 “진단 정확도만을 목표로 한 기존 RL/멀티‑에이전트 방식”보다 병력 청취 단계 자체의 품질을 높이는 것이 전체 파이프라인 성능에 크게 기여함을 시사한다.

-

비교 및 한계: AMIE, DoctorAgent‑RL 등과 달리 Note2Chat은 공개된 의료 기록을 활용해 데이터 접근성을 확보했으며, 비공개 데이터 의존성을 최소화한다. 그러나 현재는 영어 기반 MIMIC‑IV에 국한돼 있어 다언어·다문화 적용 가능성은 추가 검증이 필요하다. 또한 ‘시뮬레이션 환자’가 실제 환자와 동일한 변이성을 보장하지 못한다는 점에서 실제 임상 현장 적용 전 파일럿 테스트가 요구된다.

전반적으로 Note2Chat은 “데이터·학습·추론” 전 단계에서 임상 친화성을 설계한 통합 솔루션으로, 향후 의료 LLM의 실용화에 중요한 이정표가 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기