전문가 조절 기반 다중모달 시계열 예측

초록

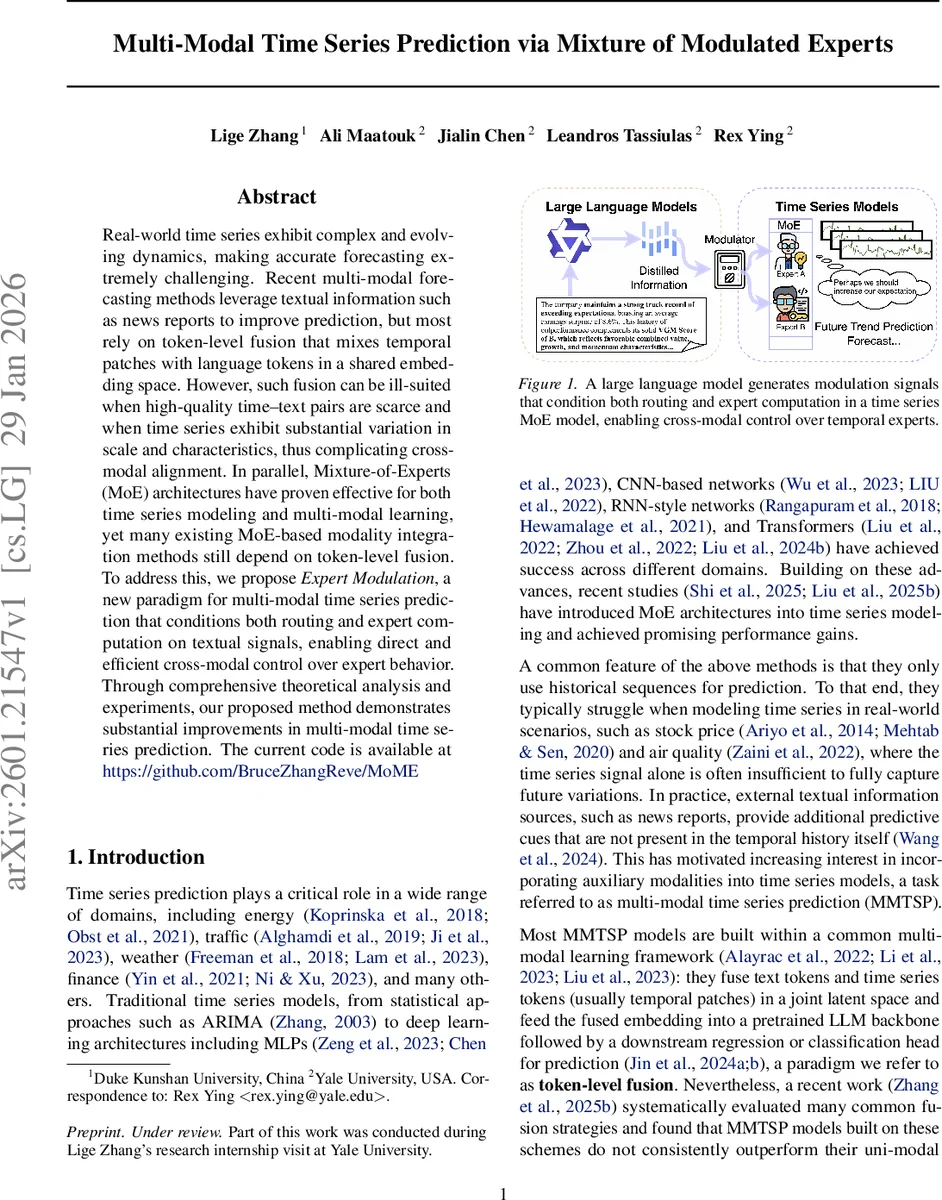

본 논문은 텍스트와 시계열 데이터를 동시에 활용하는 예측 모델에서, 토큰‑레벨 융합 대신 텍스트 신호가 전문가 라우팅과 연산을 직접 조절하도록 설계한 “전문가 조절(Expert Modulation)” 방식을 제안한다. MoE 구조를 기하학적으로 해석하고, 라우팅 점수를 에너지 기반으로 재해석함으로써 텍스트가 전문가 선택과 출력에 미치는 영향을 효율적으로 구현한다. 다양한 시계열 백본에 적용한 실험 결과, 기존 토큰‑레벨 융합 방식보다 일관된 성능 향상을 확인하였다.

상세 분석

이 논문은 다중모달 시계열 예측(MMTSP) 분야에서 가장 흔히 사용되는 토큰‑레벨 융합이 데이터 쌍의 부족, 텍스트의 잡음, 시계열의 스케일·비정상성 등으로 인해 한계가 있음을 지적한다. 이러한 문제를 해결하기 위해 저자들은 Mixture‑of‑Experts(MoE) 구조를 새로운 관점에서 재해석한다. 먼저, dense MLP를 여러 개의 작은 서브‑MLP로 분해할 수 있다는 수학적 정리를 제시하고, 이를 “전문가 방향 신호”라는 개념으로 확장한다. MoE는 이 방향 신호에 입력‑의존적인 가중치(g_i(x))를 곱해 재조합하는 과정이며, Top‑K 희소 라우팅은 가중치가 작은 신호를 잘라내는 에너지 기반 트렁케이션으로 이해한다. 이 해석을 바탕으로 텍스트 신호가 라우팅 점수와 전문가 출력 자체를 직접 변조(modulate)하도록 설계하였다. 구체적으로는 (1) 사전학습된 대형 언어 모델(LLM)로부터 텍스트 임베딩을 추출하고, 다중 헤드 어텐션을 통해 m개의 요약 토큰 Z를 만든다. (2) Z를 풀링해 얻은 컨텍스트 벡터 z를 라우터에 선형 변환(G_β′(z))을 더해 라우팅 점수를 조정한다(Router Modulation). (3) 각 전문가 f_i에 대해 스케일 γ_i(z)와 바이어스 β_i(z)를 생성하는 선형 변조(I_γ_i, I_β_i)를 적용해 전문가 출력 자체를 변형한다(Expert‑independent Linear Modulation). 최종 출력은 변조된 라우팅 점수와 변조된 전문가 출력의 Top‑K 가중합으로 계산된다. 이 설계는 텍스트가 “전문가 선택”과 “전문가 행동”을 동시에 제어함으로써, 서로 다른 스케일·특성을 가진 시계열과 텍스트 간의 정교한 상호작용을 가능하게 한다. 이론적으로는 라우팅 점수를 확률 분포가 아닌 비정규화된 에너지 스칼라로 해석함으로써, Top‑K 트렁케이션이 노이즈 억제와 정보 보존 사이의 트레이드오프를 자연스럽게 수행한다는 점을 강조한다. 실험에서는 기존 토큰‑레벨 융합 기반 모델(예: Cross‑Attention, Concatenation)과 비교해, 다양한 도메인(에너지, 교통, 금융 등)과 여러 백본(Transformer, CNN, RNN)에서 평균 2~5% 이상의 MAE/SMAPE 개선을 기록하였다. 또한, 라우팅 스파스성 K를 조절했을 때 이론적 오류 경계와 일치하는 성능 변화를 관찰했으며, 이는 제안된 기하학적 해석이 실제 모델 동작을 잘 설명한다는 증거가 된다. 전체적으로, 텍스트를 전문가 레벨에서 직접 조절하는 접근법은 데이터 쌍이 희소하거나 시계열 변동성이 큰 상황에서도 강인한 멀티모달 학습을 가능하게 한다는 중요한 인사이트를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기