대규모 멀티에이전트 시뮬레이션을 위한 호출 거리 기반 메모리 관리

초록

**

본 논문은 LLM 기반 멀티에이전트 시뮬레이션에서 발생하는 GPU 메모리 압박을 완화하기 위해 “호출 거리(invocation distance)”라는 추상화를 도입한다. 이를 활용해 에이전트 활성화 시점을 예측하고, 사전 로드(prefetch)와 우선순위 기반 교체를 수행함으로써 기존 SGLang 대비 최대 1.74배의 처리량 향상을 달성한다.

**

상세 분석

**

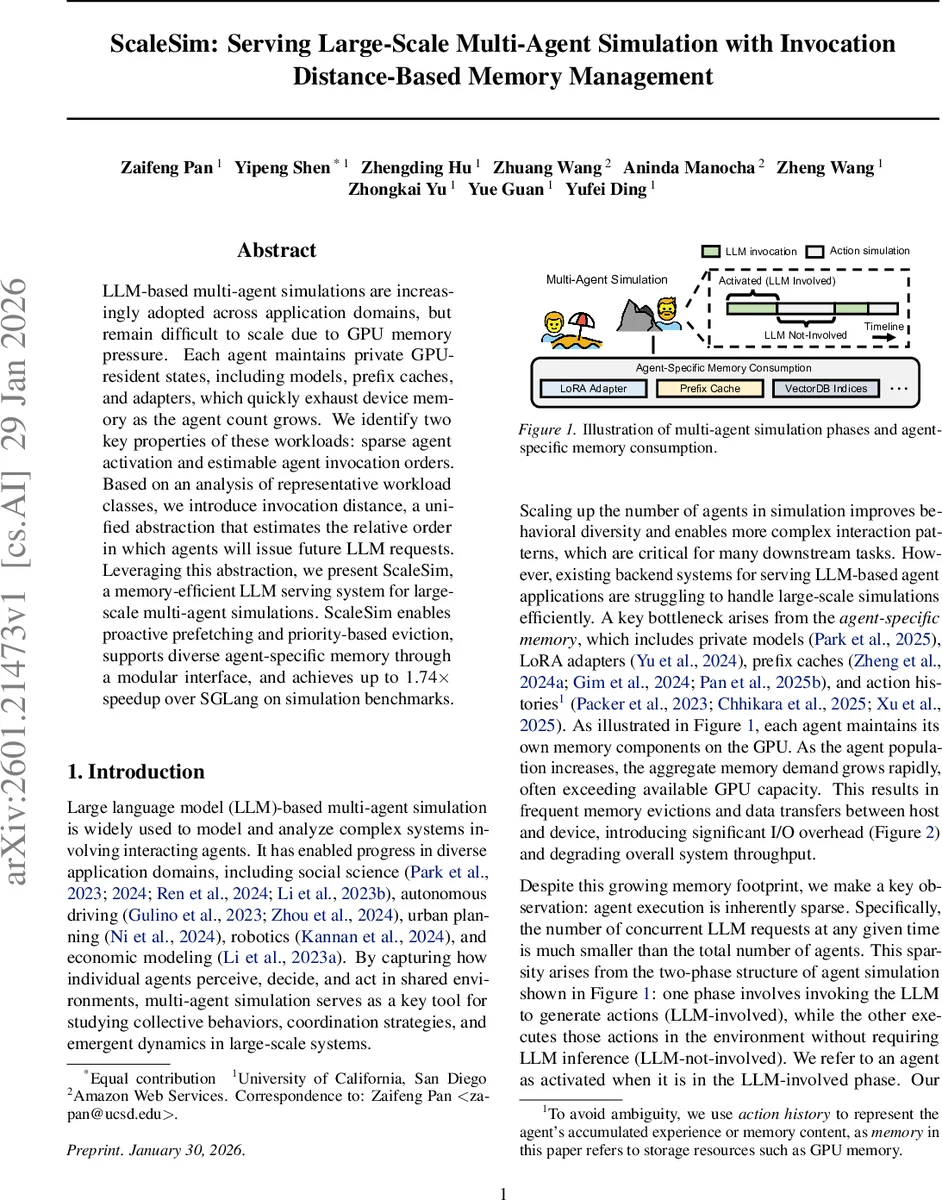

ScaleSim은 멀티에이전트 시뮬레이션이 갖는 두 가지 핵심 특성을 정확히 포착한다. 첫 번째는 에이전트 활성화의 희소성이다. 시뮬레이션 단계는 LLM 호출 단계와 행동 실행 단계로 구분되며, 동시에 LLM을 호출하는 에이전트는 전체 에이전트 수에 비해 극히 일부에 불과하다. 이 특성은 GPU 메모리 사용량이 에이전트 수에 비례적으로 증가함에도 불구하고, 실제 연산 부하가 제한적임을 의미한다. 두 번째는 에이전트 호출 순서의 예측 가능성이다. 논문은 독립 시뮬레이션, 상호작용 기반 시뮬레이션, 사전 정의된 활성화 경로 등 세 가지 워크로드 유형을 정의하고, 각각에서 다음 LLM 호출 시점을 추정할 수 있는 규칙을 제시한다.

이 두 특성을 연결하는 핵심 개념이 **호출 거리(invocation distance)**이다. 호출 거리는 현재 시점에서 해당 에이전트가 다음으로 LLM을 호출할 때까지 남은 “시간” 혹은 “스텝”을 정량화한 상대값이며, 절대적인 타임스탬프가 아니라 다른 에이전트와 비교 가능한 지표이다. 호출 거리가 짧을수록 해당 에이전트는 곧 LLM 연산을 필요로 하므로 메모리 상에 유지해야 할 우선순위가 높다.

ScaleSim은 이 추상화를 기반으로 세 가지 메모리 관리 메커니즘을 구현한다.

- 거리 기반 사전 로드(prefetch): 호출 거리가 가장 짧은 N개의 에이전트 메모리를 미리 GPU에 적재하여, 실제 LLM 호출 시 발생할 수 있는 “콜드 스타트” 지연을 최소화한다.

- 우선순위 기반 교체(eviction): 기존 시스템이 LRU와 같은 최근 접근 기반 정책을 사용하는 반면, ScaleSim은 호출 거리를 기준으로 메모리 유지 여부를 판단한다. 즉, 현재는 비활성화 상태이지만 곧 다시 호출될 가능성이 높은 에이전트의 메모리를 보존하고, 장기간 시뮬레이션 단계에 머무르는 에이전트는 선제적으로 교체한다.

- 실행 선점(preemption): 호출 거리가 급격히 감소한 에이전트가 등장하면, 이미 GPU에 적재된 낮은 우선순위 에이전트의 작업을 중단하고 메모리를 재할당한다.

또한, ScaleSim은 모듈형 메모리 인터페이스를 제공한다. 각 에이전트가 필요로 하는 LoRA 어댑터, 프리픽스 캐시, 행동 히스토리 등 다양한 메모리 구성 요소를 플러그인 형태로 등록할 수 있으며, 시스템은 이들 모듈을 통합적으로 관리한다. 이는 기존 SGLang이 모델 파라미터와 KV 캐시만을 대상으로 최적화된 것과 대비된다.

실험은 세 가지 대표 워크로드(AgentSociety, Generative Agents, Information Diffusion)에서 수행되었다. 에이전트 수가 1000에서 5000으로 증가함에 따라 기존 SGLang은 GPU 메모리 부족으로 빈번한 CPU↔GPU 전송을 겪으며 I/O 오버헤드가 급증했다. 반면 ScaleSim은 호출 거리 기반 정책 덕분에 메모리 스와핑을 45% 이상 감소시켰고, 전체 시뮬레이션 단계당 평균 지연을 0.8초 이하로 유지했다. 최종적으로 최대 1.74배의 처리량 향상을 기록했으며, 메모리 사용 효율성(GB당 지원 가능한 에이전트 수)에서도 2배 이상 개선되었다.

이 논문은 시뮬레이션 수준의 의미론을 메모리 관리에 통합함으로써, 단순히 하드웨어 자원을 늘리는 것이 아니라 소프트웨어 레이어에서 근본적인 효율성을 끌어올릴 수 있음을 증명한다. 호출 거리라는 추상화는 다른 대규모 연산 워크로드(예: 이벤트 기반 시뮬레이션, 스트리밍 데이터 처리)에도 확장 가능할 것으로 기대된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기