과잉사고 완화와 난이도 인식 강화 강화학습

초록

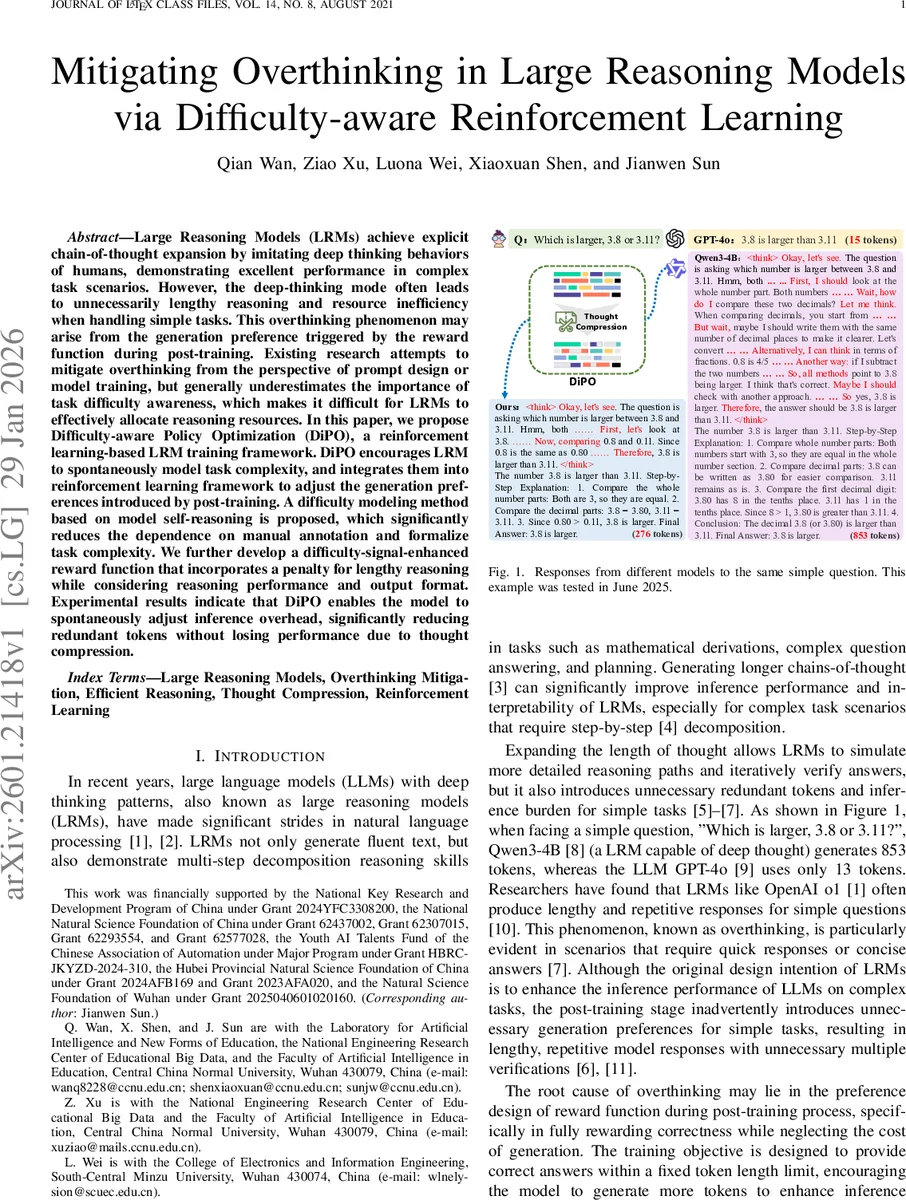

본 논문은 대규모 추론 모델(LRM)이 단순 과제에서 불필요하게 긴 사유 과정을 생성하는 ‘과잉사고’ 문제를 해결하고자, 난이도 인식 기반 강화학습 프레임워크인 DiPO를 제안한다. 모델 자체의 자기추론을 활용해 과제 난이도를 자동으로 추정하고, 난이도 신호를 포함한 보상 함수를 설계해 토큰 길이를 억제하면서 정확성을 유지한다. 실험 결과, DiPO는 토큰 사용량을 크게 줄이면서도 성능 저하 없이 추론 효율을 높였다.

상세 분석

DiPO는 크게 네 단계로 구성된다. 첫째, 난이도 신호 정의 단계에서 기존의 수작업 라벨링을 배제하고, “let’s think step by step” 프롬프트를 이용해 LRM이 자체적으로 생성한 사유 체인의 길이를 난이도 지표로 활용한다. 여기서 길이 L(x) 를 직접 보상에 사용하면 장-tail 분포로 인한 학습 불안정이 발생하므로, 논문은 L(x)에 평활화 함수 ˜L(x)=p·L(x) 를 적용하고, 평균 µ와 표준편차 σ 로 정규화한 Z(x) 를 구한다. 정답 여부 δ를 오류 패널티 α와 결합해 최종 난이도 점수 Diff(x)=clip(Z(x),1−ξ,1+ξ) 로 클리핑한다. 이 과정은 난이도 신호를 연속적이고 안정적으로 만들며, 라벨링 비용을 크게 절감한다.

둘째, 보상 함수 설계에서는 정확도 점수 s, 포맷 오류 p, 정답 오류 f 를 기본 보상으로 두고, λ_i = min(ε, len(o_i)/c)·(Diff(q_i)+φ) 로 정의된 길이·난이도 가중 패널티를 차감한다. 즉, 난이도가 낮은(간단한) 과제일수록 긴 토큰에 대한 벌칙이 크게 적용돼 모델이 자연스럽게 ‘생각을 압축’하도록 유도한다.

셋째, 강화학습 최적화는 최신 정책 최적화 알고리즘인 GRPO를 기반으로 하며, 난이도 신호가 포함된 보상을 통해 정책 π_θ 를 업데이트한다. 샘플링 단계에서 K개의 후보 답안을 생성하고, 각 후보에 대해 위 보상을 계산해 advantage 를 추정한다. 이는 기존 PPO 기반 길이 조정 방법보다 난이도 감지를 명시적으로 반영한다는 점에서 차별화된다.

넷째, 실험에서는 네 개의 인도메인 데이터셋과 세 개의 아웃오브도메인 데이터셋을 사용해 토큰 감소 비율, 정확도 유지율, 그리고 일반화 성능을 평가했다. DiPO는 평균 토큰 수를 30~70% 감소시키면서도 정확도는 0.5% 이내로 유지했으며, 특히 간단한 수치 비교 질문에서 GPT‑4o 수준의 간결성을 달성했다. 아웃오브도메인 테스트에서도 난이도 신호가 잘 전이되어, 기존 길이‑보상 기반 방법보다 안정적인 성능을 보였다.

핵심 인사이트는 (1) 모델 자체의 출력 길이가 과제 난이도의 강력한 프록시가 될 수 있다는 점, (2) 평활·정규화·클리핑을 통한 연속형 난이도 신호 설계가 보상 설계에 유연성을 제공한다는 점, (3) 난이도‑가중 패널티가 과도한 사유를 억제하면서도 복잡한 문제에서는 충분한 사유 깊이를 유지한다는 점이다. 이러한 설계는 향후 LRM이 동적으로 추론 깊이를 조절하는 메커니즘의 기반이 될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기