사용자 중심 증거 순위 매김으로 효율적인 사실 검증 구현

초록

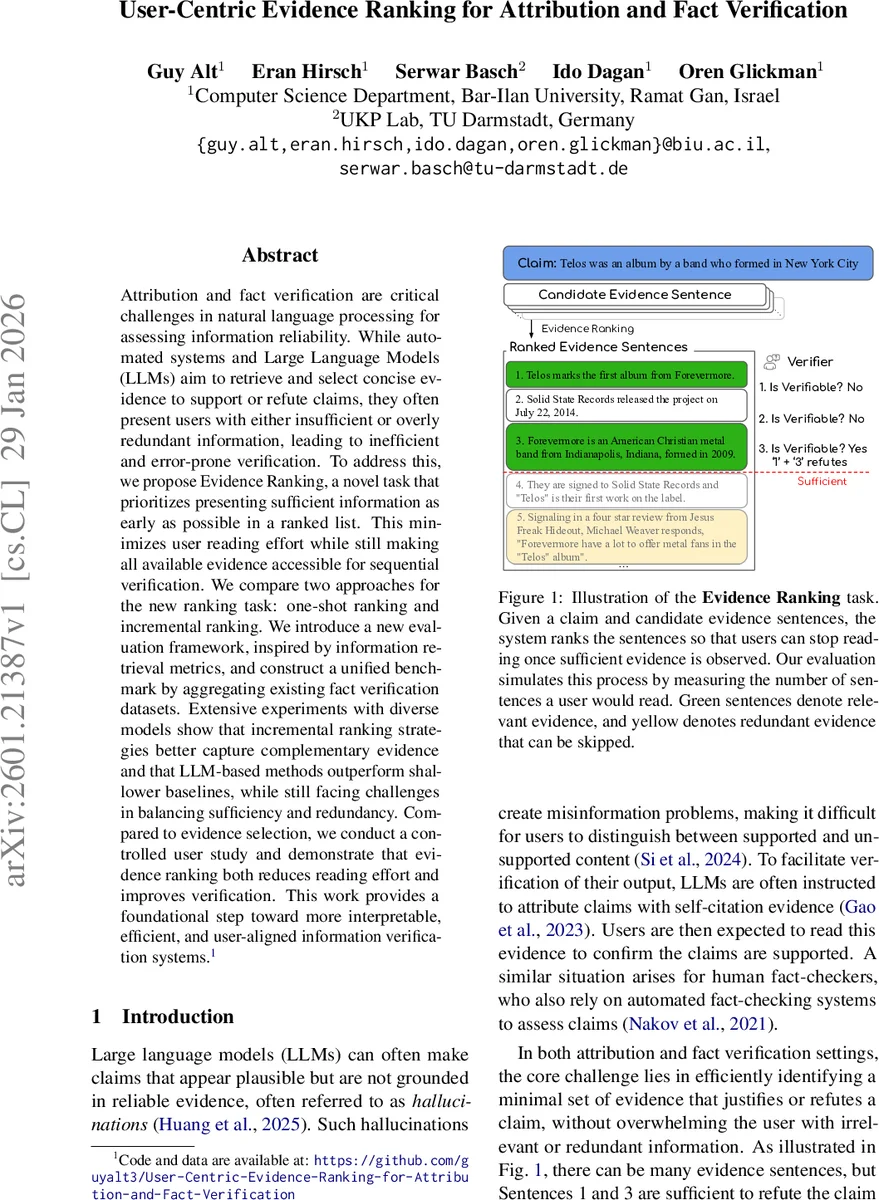

본 논문은 주장 검증 시 사용자가 최소한의 증거만 빠르게 확인하도록, 모든 후보 문장을 순위화하는 “증거 순위 매김(Evidence Ranking)” 과제를 제안한다. 기존 증거 선택 방식의 과잉·부족 문제를 해결하기 위해 일회성(one‑shot)과 점진적(incremental) 두 접근법을 비교하고, IR 기반의 MRR·SR·NDCG 변형 평가 지표와 FEVER·HoVer·WICE를 통합한 벤치마크를 구축한다. 실험 결과 LLM 기반 모델이 가장 높은 성능을 보였으며, 점진적 방식이 보완적 증거를 더 잘 포착한다. 사용자 실험에서도 순위 매김이 읽기 부담을 줄이고 검증 정확도를 높이는 것으로 확인되었다.

상세 분석

이 논문은 사실 검증 시스템이 제공하는 증거의 양과 질 사이에서 발생하는 근본적인 트레이드오프를 ‘증거 순위 매김’이라는 새로운 작업 정의를 통해 해결하고자 한다. 기존 연구는 증거를 이진 선택(정밀·재현율 기반)하거나 고정된 k개만 반환하는 방식에 머물렀지만, 실제 사용자는 증거를 순차적으로 읽으며 충분한 정보를 얻는 즉시 검증을 종료한다는 인지적 모델을 반영한다. 이를 위해 저자들은 ‘Minimal Sufficient Rank(MSR)’라는 개념을 도입해, 최소한의 충분한 증거가 포함된 가장 짧은 접두사 길이를 최소화하는 목표를 설정한다.

평가 측면에서는 전통적인 IR 메트릭을 변형해 MRR(정규화된 역순위), Success Rate(SR), NDCG를 사용한다. 특히 MRR은 관찰된 충분한 순위와 이상적인 최소 충분 순위(IMSR) 차이를 정규화해, 사용자가 추가로 읽어야 하는 문장 수를 직접적으로 측정한다. SR은 시스템이 이상적인 위치에서 정확히 충분성을 달성했는지를 평가해, 순위의 최적성을 엄격히 검증한다.

데이터 구축에서는 FEVER, HoVer, WICE 세 개의 유명 사실 검증 데이터셋을 통합해 1,000여 개의 인스턴스를 선정했다. 각 데이터셋은 단일 홉, 다중 홉, 부분 증거 등 다양한 난이도를 제공하므로, 증거 순위 매김 모델의 일반화 능력을 폭넓게 시험할 수 있다. 후보 증거 집합 평균 크기는 1342문장에 이르며, 골드 증거 집합은 평균 13문장으로 최소성을 유지한다.

모델링에서는 네 가지 접근을 비교한다. (i) 문장 임베딩 기반 코사인 유사도, (ii) NLI 모델을 미세조정한 스코어링, (iii) 추론 기반 재랭킹 모델, (iv) 대형 언어 모델(LLM) 프롬프트와 체인‑오브‑생각. 일회성 방식은 모든 후보를 한 번에 점수 매겨 전역 순위를 만든 반면, 점진적 방식은 이미 선택된 증거를 컨텍스트에 포함시켜 다음 문장을 선택한다. 실험 결과, 점진적 접근이 특히 다중 홉 데이터인 HoVer와 WICE에서 보완적 증거를 더 효과적으로 앞쪽에 배치했으며, LLM 기반 방법이 전체적으로 가장 높은 MRR(0.75)과 SR을 기록했다. 그러나 여전히 평균 읽기 문장 수가 이상적인 최소값보다 크게 차이 나는 등, 충분성과 중복성 사이의 균형을 맞추는 데 한계가 있음을 확인했다.

사용자 연구에서는 60명의 참가자를 대상으로 증거 선택 방식과 증거 순위 매김 방식을 각각 사용하게 했다. 순위 매김을 적용한 그룹은 평균 2.1문장을 읽었으며, 정확도는 87%로 증거 선택(1.8문장 평균, 78% 정확도)보다 높았다. 이는 사용자가 불필요한 중복 정보를 건너뛰고, 필요한 증거를 빠르게 파악할 수 있음을 실증한다.

결론적으로, 이 연구는 사실 검증 시스템이 사용자 중심으로 전환될 필요성을 강조하고, 증거 순위 매김이라는 작업 정의와 평가 프레임워크를 제공한다. 향후 연구는 증거 간 논리적 연결성을 더 정교히 모델링하고, 문서 수준·다중 문서 증거까지 확장하는 방향으로 나아가야 할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기