LLM 라우팅 보안 방패 RerouteGuard: 위협 체계와 실시간 방어

초록

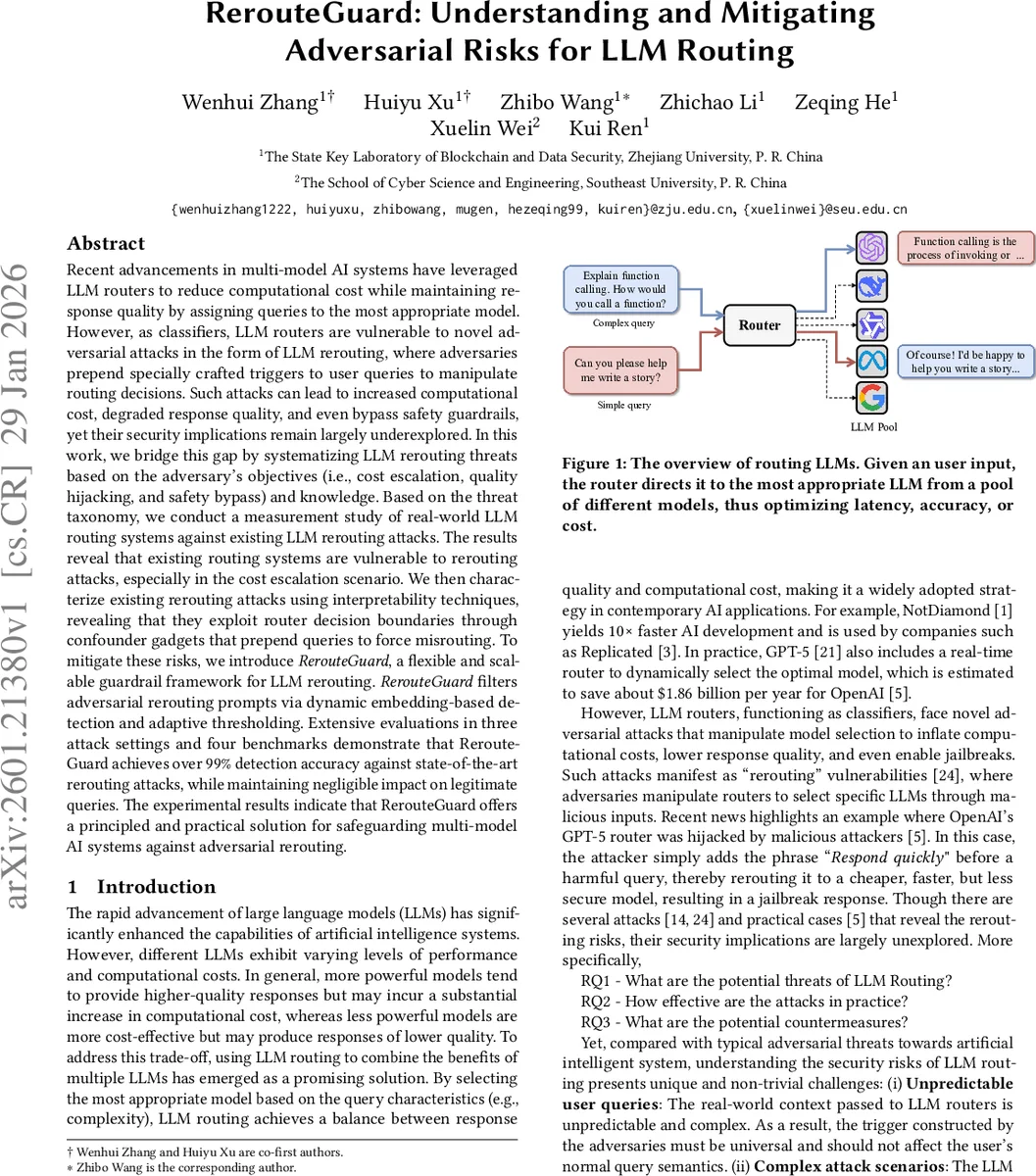

본 논문은 멀티모델 AI 시스템에서 LLM 라우터가 겪는 ‘재라우팅’ 공격을 체계화하고, 세 가지 위협(비용 상승, 품질 저하, 안전 우회)을 실험적으로 검증한다. 이후 동적 임베딩 기반 탐지와 적응형 임계값을 활용한 RerouteGuard를 제안하여, 99% 이상의 탐지 정확도와 2.5% 이하의 오탐률을 달성함을 보인다.

상세 분석

LLM 라우터는 입력 질의를 분석해 비용·성능이 가장 적합한 모델을 선택하는 분류기 역할을 한다. 이러한 구조적 특성 때문에, 공격자는 질의 앞에 ‘트리거’를 삽입해 라우터의 의사결정 경계를 교란시킬 수 있다. 논문은 이를 ‘LLM 재라우팅’이라 명명하고, 공격 목표를 비용 상승, 품질 탈취, 안전 우회로 구분한다. 비용 상승 시 공격자는 간단한 질의에 고성능·고비용 모델을 선택하도록 유도해 클라우드 비용을 급증시킨다. 품질 탈취는 복잡한 질의에 저성능 모델을 할당해 응답 정확도를 떨어뜨리고, 안전 우회는 위험한 질의를 저보안 모델에 전달해 기존 가드레일을 무력화한다.

세 가지 공격 시나리오는 백박스, 그레이박스, 박스프리로 나뉘며, 각각 라우터 내부 가중치·그라디언트, 승률 스코어, 전혀 알지 못하는 상황을 전제로 한다. 실험에서는 4개의 공개 라우팅 기법(유사도 기반, 분류기 기반, 스코어링 기반 등)과 3개의 벤치마크를 활용해 100%에 가까운 성공률을 기록했으며, 특히 비용 상승 공격에서 거의 완전한 라우팅 전환이 관찰되었다.

해석적 분석을 위해 SHAP·Attention 흐름 등을 적용했을 때, 트리거 문구가 정상 복잡 질의와 의미 공간에서 매우 근접함을 확인했다. 즉, 라우터는 ‘복잡성’이라는 은닉 특성을 과도하게 의존하고 있어, 트리거가 복잡한 문맥을 흉내내면 경계가 쉽게 넘어간다.

이를 방어하기 위해 제안된 RerouteGuard는 두 단계로 동작한다. 첫 단계는 대규모 정상·공격 샘플을 이용해 대비 학습(constrastive learning)으로 임베딩 공간을 형성한다. 긍정 쌍은 동일 카테고리(정상‑정상 또는 공격‑공격)이며, 부정 쌍은 서로 다른 카테고리이다. 이렇게 학습된 임베딩은 입력 질의와 몇 개의 대표 정상 질의를 조합해 ‘테스트 쌍’을 만들고, 각 쌍의 유사도 점수를 통해 다수결로 최종 라우팅 허용 여부를 판단한다. 임계값은 실시간 트래픽 특성에 맞춰 자동 조정되며, 탐지 연산은 경량화된 매트릭스 연산으로 구현돼 라우팅 지연을 거의 발생시키지 않는다.

평가 결과, 세 가지 공격 설정(백박스·그레이박스·박스프리)과 네 개의 데이터셋에서 평균 99.3% 이상의 탐지 정확도를 달성했으며, 정상 질의에 대한 오탐률은 2.1% 이하로 유지되었다. 또한, 라우터 자체에 부하를 주지 않으면서도 기존 라우팅 파이프라인에 플러그인 형태로 손쉽게 통합할 수 있다. 이러한 결과는 멀티모델 AI 서비스가 비용·품질·안전성을 동시에 보장하면서도 새로운 적대적 위협에 대비할 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기