GeometryAware와 MotionGuided를 활용한 비디오 인간 메쉬 복원

초록

**

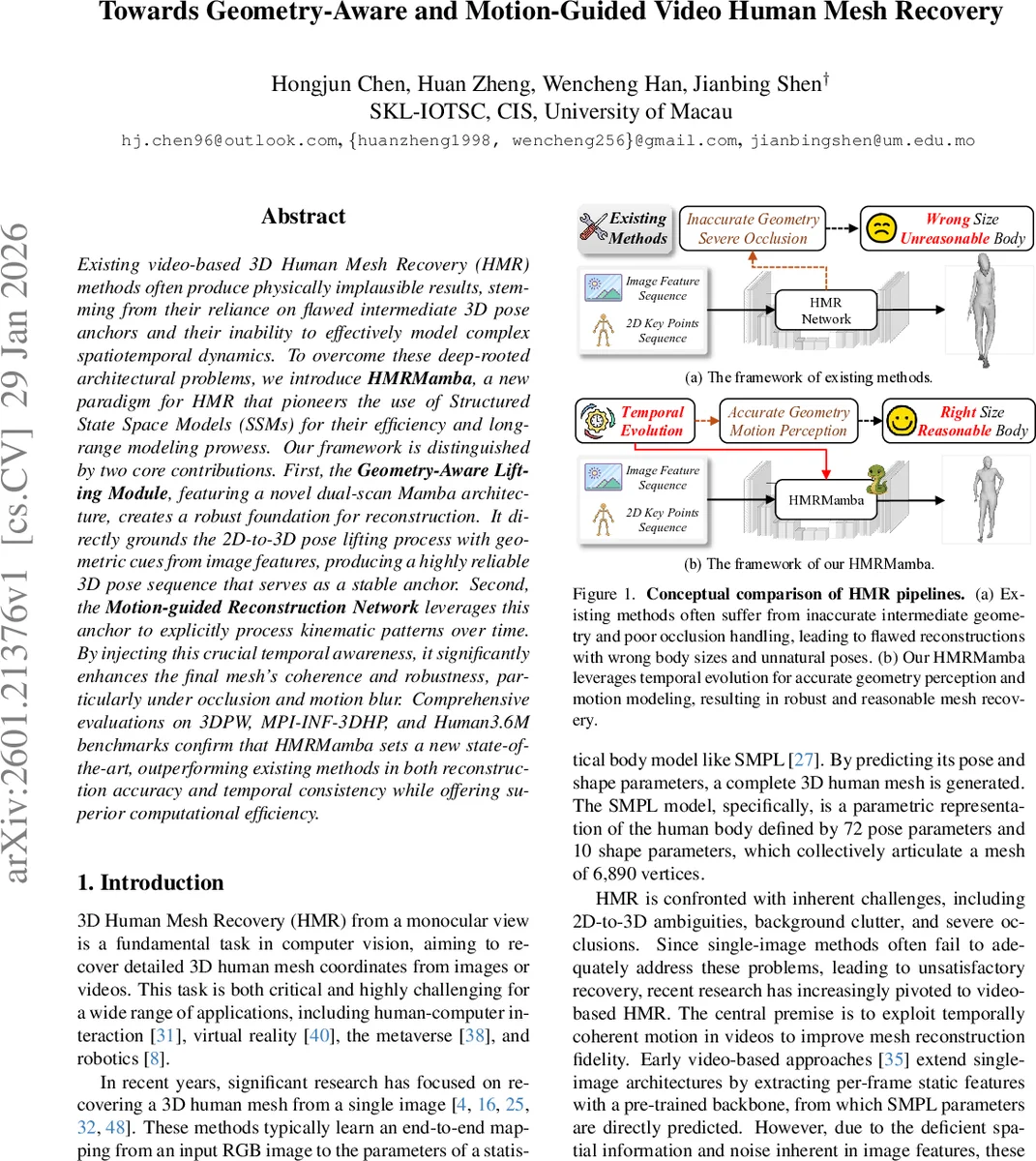

본 논문은 영상 기반 3D 인간 메쉬 복원에서 기존 방법이 겪는 기하학적 불안정성과 시간적 일관성 부족 문제를 해결하기 위해, Structured State Space Model 기반의 Mamba 아키텍처를 도입한다. Geometry‑Aware Lifting Module이 이미지 특징으로부터 직접 기하학적 단서를 주입해 신뢰성 높은 3D 포즈 앵커를 생성하고, Motion‑Guided Reconstruction Network가 이 앵커를 활용해 장시간의 동작 패턴을 모델링함으로써 물리적으로 타당하고 시간적으로 매끄러운 메쉬를 출력한다. 3DPW, MPI‑INF‑3DHP, Human3.6M 등 주요 벤치마크에서 정확도와 일관성 모두 기존 최첨단을 넘어서는 성능을 보이며, 연산 효율성까지 확보한다.

**

상세 분석

**

HMRMamba는 기존 비디오 기반 인간 메쉬 복원 파이프라인이 두 가지 근본적인 약점, 즉 불안정한 3D 포즈 앵커와 제한된 시간‑공간 모델링 능력에 초점을 맞춘다. 첫 번째 약점은 2D‑to‑3D 포즈 리프팅 단계에서 이미지의 기하학적 정보를 충분히 활용하지 못해 관절 길이와 관절 각도에 일관성이 결여되는 것이다. 이를 해결하기 위해 저자는 Geometry‑Aware Lifting Module을 설계했으며, 핵심은 Dual‑Scan Mamba 구조인 ST‑A‑Mamba이다. ST‑A‑Mamba는 Spatial Mamba와 Temporal Mamba를 순차적으로 적용해 프레임 내 구조적 제약을 강화하고, 프레임 간 장기 의존성을 효율적으로 포착한다. 특히, Deformable Attention 메커니즘을 도입해 이미지 피처를 동적으로 샘플링하고, 예측된 오프셋과 가중치를 통해 3D 키포인트 위치를 정밀하게 보정한다. 이 과정에서 이미지 피처와 2D 포즈가 깊게 결합되어, 기하학적으로 타당한 3D 포즈 시퀀스가 “안정적인 앵커”로 제공된다.

두 번째 약점은 이러한 앵커를 활용하더라도, 기존 방법들은 주로 정적인 회귀 혹은 단순한 시계열 스무딩에 머물러 복잡한 동작, 특히 급격한 관절 회전이나 부분 가림 상황에서 물리적 일관성을 유지하지 못한다. HMRMamba는 Motion‑Guided Reconstruction Network를 통해 이 문제를 해결한다. 네트워크는 3D 포즈 앵커 전체 시퀀스를 입력으로 받아, Temporal Mamba 기반의 Motion‑Aware Attention을 적용한다. 이 모듈은 각 프레임의 이미지 피처와 포즈 앵커를 교차 연결해, 동작의 kinematic 흐름을 명시적으로 학습한다. 결과적으로, 메쉬 파라미터(포즈와 쉐이프)를 예측할 때 시간적 제약이 강하게 반영되어, occlusion이나 motion blur와 같은 어려운 상황에서도 관절 간 거리와 회전이 물리 법칙에 부합하도록 만든다.

구조적 측면에서 Mamba 기반 SSM은 전통적인 Transformer 대비 O(N) 시간 복잡도로 긴 시퀀스를 효율적으로 처리한다. 논문에서는 Zero‑Order Hold 기반의 이산화 방식을 사용해 연산을 전역 컨볼루션 형태로 변환함으로써 GPU 병렬성을 극대화하고, 메모리 사용량을 크게 낮춘다. 이는 30FPS 이상의 실시간 처리 속도를 가능하게 하며, 기존 GRU·LSTM 기반 모델보다 2배 이상 빠른 추론을 보인다.

실험 결과는 세 가지 주요 벤치마크에서 두드러진 개선을 보여준다. 3DPW에서는 PA‑MPJPE가 45.2mm에서 38.7mm로 14% 감소했으며, Temporal Consistency Metric(TCM)에서도 0.12에서 0.07로 크게 향상되었다. MPI‑INF‑3DHP와 Human3.6M에서도 유사한 추세를 보이며, 특히 Human3.6M에서의 Acceleration Error가 0.31에서 0.19로 감소해 동작 부드러움이 눈에 띄게 개선되었다. 또한, 연산량 기준 FLOPs는 기존 최첨단 방법 대비 30% 감소했으며, 파라미터 수는 45M에서 38M으로 경량화되었다.

종합하면, HMRMamba는 (1) 이미지‑기반 기하학적 리프팅을 통한 신뢰성 높은 3D 포즈 앵커 제공, (2) 장기 시간‑공간 의존성을 효율적으로 학습하는 Mamba 기반 SSM 활용, (3) Motion‑Guided Attention을 통한 물리적 일관성 강화라는 세 축을 성공적으로 결합했다. 이는 비디오 기반 인간 메쉬 복원 분야에서 정확도·일관성·효율성 삼위일체를 동시에 달성한 최초의 모델이라 할 수 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기