ViTMAlis: 비전 트랜스포머 기반 모바일 영상 분석을 위한 지연 최소화 프레임워크

초록

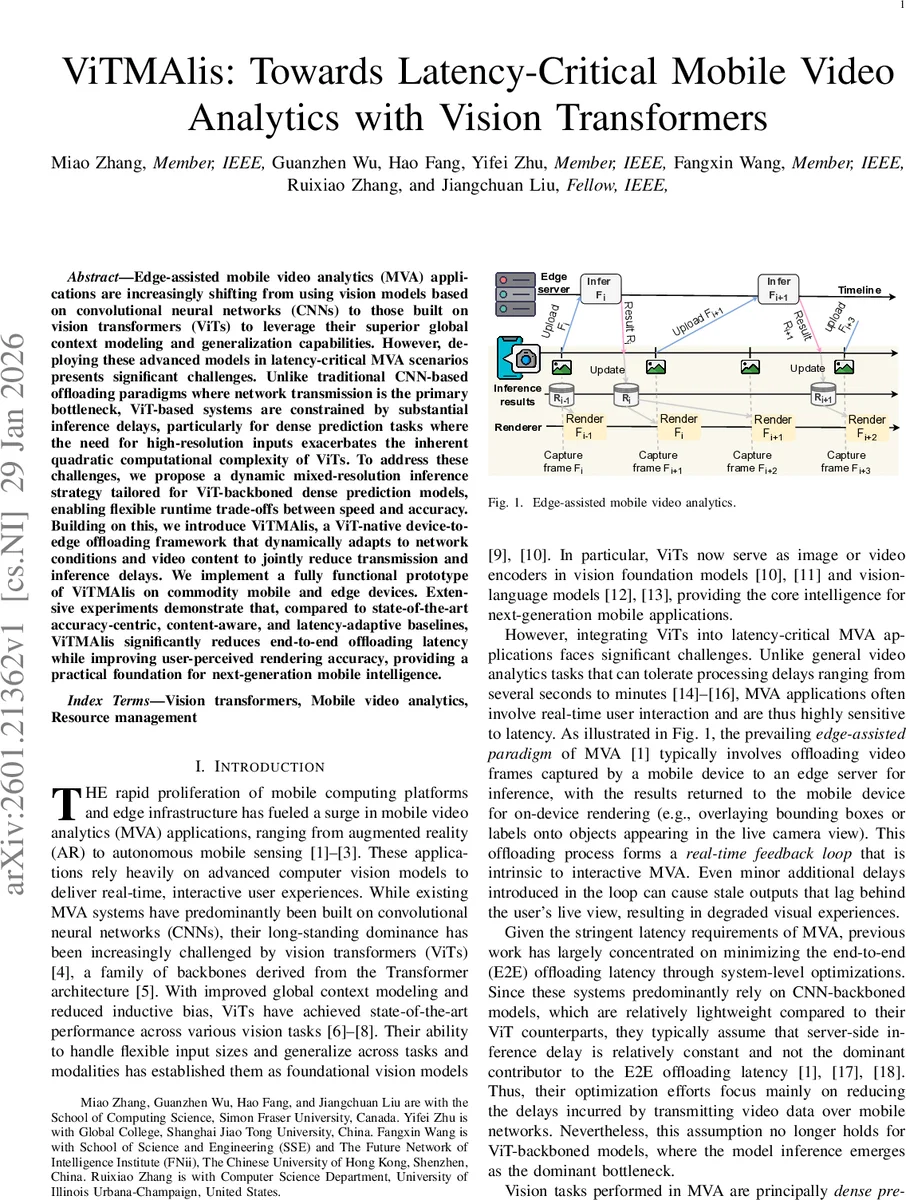

ViTMAlis는 비전 트랜스포머(ViT) 백본을 활용한 밀집 예측 모델의 고해상도 입력으로 인한 추론 지연을 완화하기 위해 동적 혼합 해상도 토큰화와 전송·추론 지연을 동시에 최적화하는 오프로드 시스템이다.

상세 분석

본 논문은 기존 CNN 기반 모바일 비디오 분석(MVA) 시스템이 네트워크 전송 지연을 주요 병목으로 가정하고 최적화해 온 반면, ViT 기반 모델은 자체적인 추론 지연이 지배적인 문제임을 정확히 지적한다. 특히, 객체 검출·세그멘테이션과 같은 밀집 예측 작업은 높은 해상도 입력을 요구하고, ViT의 자체‑어텐션 연산 복잡도가 토큰 수의 제곱에 비례하기 때문에 1080p 영상에서 280 ms 이상의 지연이 발생한다. 이를 해결하기 위해 저자는 두 가지 핵심 설계를 제안한다.

첫째, 동적 혼합‑해상도 토큰화이다. 이미지 전체를 균일한 16×16 패치가 아니라, 중요 영역은 고해상도 토큰을 유지하고, 덜 중요한 영역은 d배(예: 2배) 다운샘플링하여 토큰 수를 감소시킨다. 이때 ‘결정 영역(decision region)’을 윈도우 어텐션의 크기 w와 정합하도록 r = w·d 로 설정해, 다운샘플링된 토큰이 윈도우 경계와 정확히 맞물리게 함으로써 기존 ViT 구조와 호환성을 보장한다.

둘째, 유연한 해상도 복원 메커니즘이다. 혼합‑해상도 토큰은 원래의 2D 격자 정렬을 깨뜨리므로, 중간 레이어에서 선택적으로 저해상도 토큰을 복원해 전체 해상도 피처 맵을 재구성한다. 논문은 ViTDet 모델을 N개의 서브셋(기본 4)으로 나누고, 각 서브셋 내부에서 복원 지점을 지정함으로써 피처 피라미드 구축을 가능하게 한다. 이렇게 하면 다운샘플링으로 인한 연산 감소 효과를 유지하면서도, 밀집 예측 헤드가 요구하는 다중 스케일, 격자 정렬 피처를 제공한다.

시스템 차원에서는 동적 구성 관리가 핵심이다. 모바일 네트워크 대역폭, 프레임 복잡도, 현재 지연 목표 등을 실시간으로 측정하고, 중요 영역 선택을 위한 정확도‑지향 다운샘플링 정책과 성능 예측 모델을 결합한다. 이를 통해 각 프레임마다 최적의 토큰 수와 복원 시점을 결정, 전송량과 추론 시간을 동시에 최소화한다.

실험 결과, NVIDIA RTX 5090 기반 엣지 서버에서 ViTDet‑L을 사용했을 때 기존 고정‑해상도 오프로드 대비 평균 E2E 지연을 30 % 이상 감소시키고, 사용자 인지 정확도(mAP)도 2‑3 % 향상시켰다. 또한, 다양한 네트워크 조건(4G/5G/Wi‑Fi)과 비디오 시나리오(AR, 드라이브‑바이‑뷰)에서 제안 시스템이 기존 정확도‑중심, 콘텐츠‑인식, 지연‑적응 기반 베이스라인을 모두 능가함을 보였다.

이러한 설계는 ViT의 입력‑불변성(토큰 수 조절)과 윈도우 어텐션 구조를 활용해, 별도 재학습 없이 사전 학습된 백본을 그대로 사용할 수 있다는 실용적 장점도 제공한다. 따라서 ViTMAlis는 차세대 모바일 인텔리전스에서 ViT 기반 밀집 예측을 실시간으로 서비스하기 위한 핵심 인프라로 자리매김할 가능성이 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기