LLM 기반 판사 편집기 에이전트로 향상된 실어증 음성 인식

초록

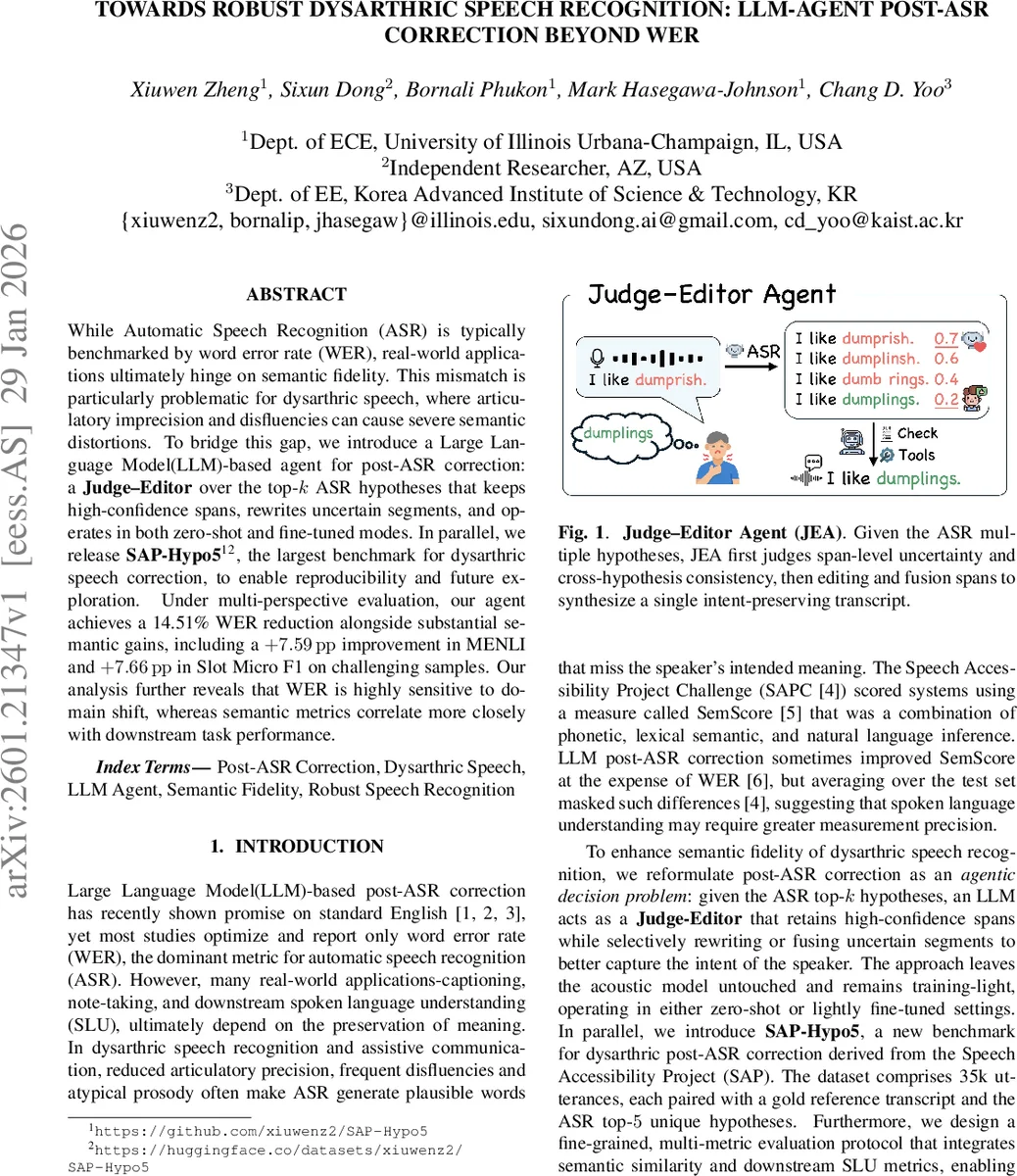

본 논문은 실어증 화자의 음성 인식 오류를 완화하기 위해, 상위 k개의 ASR 가설을 입력으로 받아 신뢰도가 높은 구간은 그대로 유지하고 불확실한 구간을 재작성·통합하는 LLM 기반 판사‑편집기(Judge‑Editor Agent)를 제안한다. zero‑shot과 경량 파인튜닝 두 모드로 구현했으며, 35 k 발화와 top‑5 가설을 제공하는 SAP‑Hypo5 벤치마크를 새로 공개한다. 실험 결과, 파인튜닝된 에이전트는 WER을 14.51 % 절감하고, 의미 기반 지표(MENLI, Slot Micro‑F1)에서 각각 7.59 pp·7.66 pp 향상시켰다. 또한 WER은 도메인 변동에 민감한 반면, 의미·태스크 지표는 실제 SLU 성능과 높은 상관성을 보였다.

상세 분석

이 연구는 기존 ASR 평가가 주로 WER에 의존해 의미적 충실도를 간과한다는 점을 지적하고, 특히 실어증 화자처럼 발음이 불명확하고 비정형적인 오류가 빈번한 경우에 의미 손실이 심각해질 수 있음을 강조한다. 이를 해결하기 위해 저자들은 “판사‑편집기”라는 두 단계 의사결정 프레임워크를 설계했다. 첫 번째 단계인 판사(Judge)는 top‑k 가설 간의 교차 일치를 분석해 고신뢰 구간을 식별한다. 여기서는 n‑gram 일치, 확률 점수, 그리고 토큰 레벨의 일관성을 활용해 “불확실도” 스코어를 산출한다. 두 번째 단계인 편집기(Editor)는 판사가 표시한 불확실 구간에 대해 LLM에게 재작성·통합을 요청한다. 이때 LLM은 사전 정의된 프롬프트(예: “신뢰도가 낮은 구간만 수정하고, 고유명사와 숫자는 그대로 유지”)에 따라 제약을 받으며, hallucination을 방지하기 위해 greedy decoding과 반복 구절 절단 알고리즘을 적용한다.

모델 선택 측면에서 저자들은 Qwen2‑7B‑Instruct, Qwen3‑8B, Llama‑2‑7B, Llama‑3‑8B 등 다양한 7~8 B 파라미터 규모의 LLM을 실험했다. zero‑shot 설정에서는 프롬프트만으로 동작하지만, 도메인 특성(실어증 발화의 비정형성)을 반영하지 못해 WER 개선 효과가 미미했다. 반면 LoRA 기반 경량 파인튜닝을 수행한 경우, 3 epoch(≈8 시간) 내에 수렴하며, 특히 Err 그룹(Top‑1 가설에 오류가 있는 경우)에서 WER을 22 %→≈19 % 수준으로 낮추었다. 이는 파인튜닝이 LLM에게 실어증 특유의 발음 변형, 반복 구절, 비표준 어휘 패턴을 학습시키는 데 효과적임을 보여준다.

평가 지표는 전통적인 WER 외에도 Q‑Emb(문장 수준 임베딩 유사도), BERTScore‑F1(토큰 수준 의미 정밀도), MENLI(NLI 기반 논리 함의)와 같은 의미 지표, 그리고 Intent Accuracy와 Slot Micro‑F1 같은 SLU 태스크 지표를 포함한다. 파인튜닝된 모델은 모든 의미·태스크 지표에서 일관된 상승을 보였으며, 특히 Llama‑3‑8B는 MENLI와 Slot F1에서 최고 점수를 기록했다. 이는 “문자 그대로의 정확도”보다 “의미적 일관성”이 실용적인 응용에 더 중요함을 실증한다.

또한 저자들은 WER가 도메인 이동(예: 새로운 화자, 다른 녹음 환경) 시 급격히 악화되는 반면, 의미 지표는 상대적으로 안정적이라는 현상을 분석했다. 이는 WER이 표면적인 문자 매칭에 과도하게 의존하고, 대소문자·구두점·축약형 차이에도 민감하게 반응하기 때문이다. 반면 MENLI와 Slot F1은 의미적 일관성을 평가하므로, 실제 의도 전달 여부를 더 정확히 반영한다.

마지막으로, 판사와 편집기 역할을 각각 비활성화한 Ablation 실험에서, 두 역할을 모두 활성화했을 때 가장 큰 성능 향상이 관찰되었다. 판사만 사용할 경우 고신뢰 구간을 그대로 두어 오류가 남고, 편집기만 사용할 경우 전체 가설을 무조건 재작성해 불필요한 변형이 발생한다. 따라서 두 모듈의 상호 보완성이 핵심 설계 원칙임을 확인할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기