동적 어댑터 융합: 사전학습 모델 기반 클래스 증분 학습을 위한 전역 어댑터 구축

초록

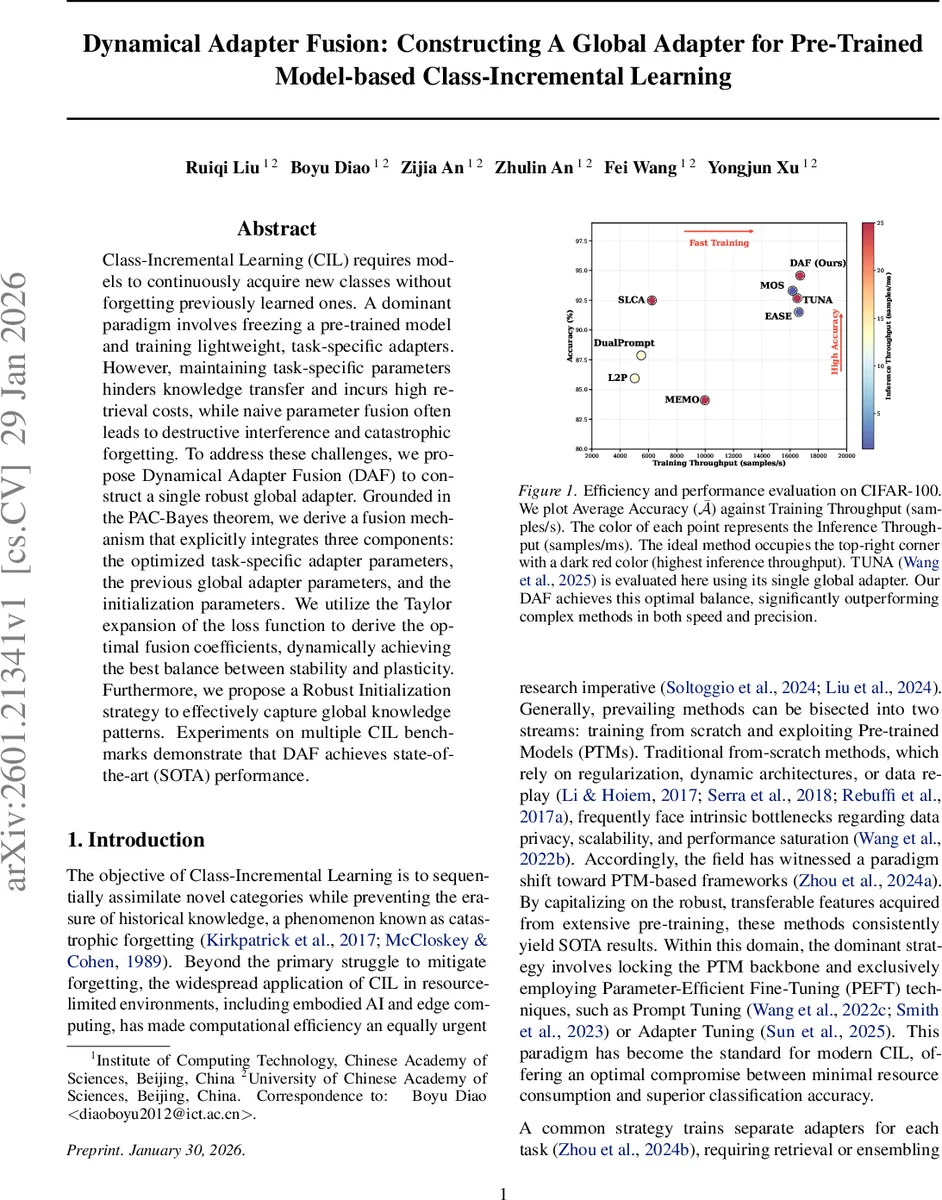

본 논문은 클래스 증분 학습(CIL)에서 매 작업마다 별도의 어댑터를 학습하고 저장하는 기존 방식의 비효율성을 해소하고자, PAC‑Bayes 이론에 기반한 최적의 파라미터 융합 메커니즘을 제안한다. 최적의 융합 계수를 라그랑주 승수를 이용해 도출하고, 과거 어댑터를 저장하지 않아도 전역 어댑터 하나만으로 모든 과거 클래스를 인식하도록 설계하였다. 또한, 과거 어댑터를 재귀적으로 평균화한 강건 초기화 전략을 도입해 안정성을 높였다. CIFAR‑100·ImageNet‑R 등 여러 CIL 벤치마크에서 기존 최첨단 방법 대비 1.5~2.7%p의 정확도 향상과 높은 추론·학습 효율을 달성하였다.

상세 분석

본 연구는 사전학습된 대규모 모델(PTM)을 고정하고, 각 증분 단계마다 경량 어댑터(adapter)를 학습하는 PEFT(Param‑Efficient Fine‑Tuning) 패러다임을 채택한다. 기존 방법은 작업별 어댑터를 별도로 보관하고 추론 시 task‑ID 기반 검색·앙상블을 수행해 메모리·연산 비용이 급증하고, 잘못된 검색 시 성능 저하가 발생한다는 한계를 지적한다. 이를 해결하기 위해 저자는 세 가지 파라미터 집합—(1) 현재 작업에서 최적화된 어댑터 θ_t, (2) 이전 단계에서 축적된 전역 어댑터 θ*_t‑1, (3) 초기화 파라미터 θ_p—를 하나의 전역 어댑터 θ*_t 로 융합하는 동적 어댑터 융합(Dynamical Adapter Fusion, DAF) 프레임워크를 제안한다.

핵심 이론적 근거는 PAC‑Bayes 정리이다. Theorem 3.1은 기대 위험 R을 경험 위험 ˆR, 일반화 정규화 KL(Q_s‖P_init), 그리고 망각 정규화 KL(Q_g‖Q_g^{t‑1}) 세 항으로 분해한다. 여기서 일반화 정규화는 현재 작업 어댑터가 초기화와 과도하게 차이 나는 것을 억제하고, 망각 정규화는 전역 어댑터가 이전 지식을 유지하도록 강제한다. 따라서 최적의 융합은 이 세 항을 동시에 최소화하는 방향으로 파라미터를 조정해야 한다.

DAF는 파라미터 융합을 다음과 같이 정의한다:

θ*t = β_t θ_p + β_t θ*{t‑1} + (1‑2β_t) θ_t,

여기서 β_t는 요소별(또는 전체) 스칼라 가중치이며, stability‑plasticity 트레이드오프를 조절한다. β_t는 라그랑주 승수를 도입한 제약 최적화 문제(식 5‑12)를 풀어 얻는다. 구체적으로, 손실 차이 L(θ*_t)‑L(θ_t)를 2차 테일러 전개로 근사하고, 파라미터 이동 Δθ = θ*t‑θ*{t‑1}+θ_t‑θ_p 를 도입해 제약식과 결합한다. 최종적으로 β_t는 1차·2차 미분값(L′, L″)과 현재 파라미터들의 선형 조합에 의해 닫힌 형태로 계산된다. 이는 매 단계마다 데이터 분포와 학습 진행 상황에 맞춰 동적으로 조정되므로, 고정된 EMA나 단순 평균보다 훨씬 효과적인 파라미터 통합을 가능하게 한다.

또한, “Robust Initialization” 전략은 과거 어댑터들을 재귀적으로 평균화해 θ_p 를 생성한다. 이는 과거 지식의 통계적 특성을 사전 초기값에 반영함으로써, 초기화 단계부터 전역 어댑터가 안정적인 방향으로 수렴하도록 돕는다. 중요한 점은 이 과정에서 실제 과거 어댑터를 저장하지 않아도 된다는 점이다; 대신 이전 단계의 전역 어댑터와 현재 단계의 최적화된 어댑터만을 이용해 θ_p 를 추정한다.

실험에서는 CIFAR‑100, ImageNet‑R, 그리고 여러 CIL 프로토콜(예: 10‑task, 20‑task 설정)에서 DAF를 적용하였다. 결과는 (1) 평균 정확도에서 기존 SOTA 방법 대비 1.5~2.7%p 상승, (2) 학습 스루풋(샘플/초)과 추론 스루풋(샘플/ms) 모두 크게 개선되어, Figure 1에 제시된 “상단‑우측” 최적점에 근접함을 보여준다. 특히, 메모리 사용량은 어댑터 하나만 유지하므로 O(1) 수준으로 감소하고, 추론 시 task‑ID 검색이 필요 없으므로 실시간 시스템에 적합한 구조를 제공한다.

요약하면, DAF는 (i) PAC‑Bayes 기반의 위험 분해를 통해 이론적 정당성을 확보하고, (ii) 라그랑주 최적화를 통해 손실·정규화·망각을 동시에 고려한 최적 융합 계수를 도출하며, (iii) 과거 어댑터를 저장하지 않는 강건 초기화와 결합해 메모리·연산 효율성을 극대화한다. 이러한 설계는 클래스 증분 학습의 핵심 과제인 “stability‑plasticity dilemma”를 효과적으로 해결한다.

댓글 및 학술 토론

Loading comments...

의견 남기기