다국어 수학 추론 평가를 위한 MGSM‑Pro: 변형 인스턴스로 강인성 검증

초록

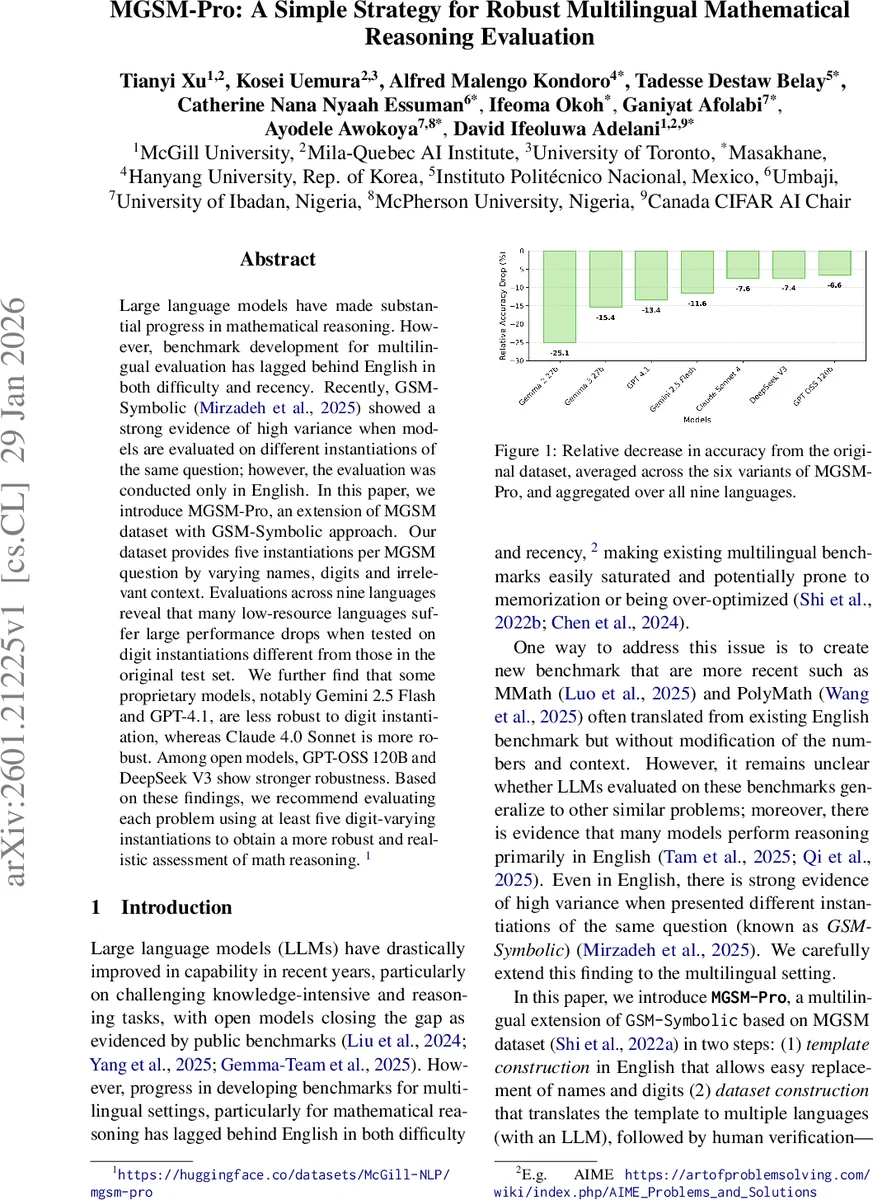

MGSM‑Pro는 기존 MGSM 데이터셋에 이름·숫자·불필요한 문맥을 변형한 5개의 인스턴스를 추가한 다국어 수학 추론 벤치마크이다. 9개 언어·12개 모델을 평가한 결과, 저자원 언어와 숫자 변형에 특히 취약함을 확인했으며, Gemini 2.5 Flash와 GPT‑4.1은 숫자 변형에 약하고 Claude Sonnet 4와 오픈 모델 GPT‑OSS 120B·DeepSeek V3는 상대적으로 강인함을 보였다. 저자들은 최소 5개의 변형 인스턴스로 평가할 것을 권고한다.

상세 분석

본 논문은 대형 언어 모델(LLM)의 수학적 추론 능력을 다국어 환경에서 보다 현실적으로 측정하기 위해 MGSM‑Pro 데이터셋을 설계·제공한다. 기존 MGSM은 250개의 영어 수학 문제를 9개 언어로 번역했지만, 숫자·이름·불필요한 문맥을 그대로 유지해 변형에 대한 모델의 일반화 능력을 평가하기 어려웠다. 이를 해결하기 위해 저자들은 두 단계(템플릿 구축·다국어 변환)를 거쳐 각 문제당 5개의 변형을 생성하였다. 변형은 크게 두 시리즈로 나뉜다. 첫 번째는 Symbolic(SYM) 시리즈로, SYM_N(이름 교체), SYM_#(숫자 교체), SYM_N#(이름·숫자 동시 교체)로 구성된다. 두 번째는 Irrelevant Context(IC) 시리즈로, 동일한 이름·숫자 변형에 추가로 무관한 문장을 삽입해 난이도를 높인다(IC_N, IC_#, IC_N#). 이러한 설계는 GSM‑Symbolic 연구에서 제시된 “같은 질문의 다른 인스턴스”가 모델 성능에 미치는 영향을 다국어로 확장한다는 점에서 의미가 크다.

실험에서는 12개의 최신 LLM(오픈·폐쇄형 모두)을 zero‑shot 설정으로 평가했으며, 각 변형을 5번씩 다른 숫자로 샘플링해 평균 정확도를 보고한다. 결과는 크게 세 가지 인사이트를 제공한다. 첫째, 이름 교체는 대부분의 모델에 큰 영향을 주지 않지만, 불필요한 문맥이 추가되면 특히 저자원 언어(LRL)에서 성능이 소폭 감소한다. 둘째, 숫자 교체는 성능 저하의 주된 원인으로, 평균 -8점 이상의 감소가 관찰됐으며, Gemma 3 27B와 Gemini 2.5 Flash는 -18점·-15점으로 가장 큰 손실을 보였다. 셋째, 고자원 언어(HRL)와 저자원 언어 사이에 강인성 차이가 존재한다. HRL(영어, 중국어, 프랑스어)은 변형에 비교적 견고했지만, Amharic, Igbo, Yoruba, Twi와 같은 LRL은 큰 정확도 감소를 겪었다. 흥미롭게도 Swahili와 같은 중간 자원 언어는 HRL 수준의 강인성을 보였다.

모델 규모와 강인성 사이의 관계는 일관되지 않았다. Gemma 계열은 파라미터가 늘어날수록 성능 저하가 심해졌지만, GPT‑OSS는 규모가 커질수록 변형에 대한 내성이 향상되었다. 또한, 폐쇄형 GPT‑4.1이 오픈형 GPT‑OSS 120B보다 변형에 더 취약한 점은 파라미터 수만으로 강인성을 판단하기 어렵다는 점을 시사한다.

리더보드 순위의 변동성도 중요한 발견이다. 원본 데이터(DO) 기준으로 Gemini 2.5 Flash가 1위를 차지했지만, 5개 인스턴스 평균(Avg‑5)에서는 Claude Sonnet 4가 1위로 상승했다. 이는 단일 인스턴스 평가가 모델의 실제 추론 능력을 과대평가할 위험이 있음을 의미한다. 따라서 저자들은 평균 5개 인스턴스(Avg‑5)를 기본 평가 방식으로 채택할 것을 강력히 권고한다.

데이터셋 구축 과정에서도 문화적 적합성을 강조한다. 이름·도시·동물 등 현지 고유 명사를 네이티브 어노테이터가 직접 선정·검증함으로써 번역 과정에서 발생할 수 있는 문화적 부조화를 최소화했다. 또한, 자동 정렬 검증과 인간 검수를 병행해 품질을 확보했다.

한계점으로는 언어 커버리지가 9개에 머물러 있어 아프리카·남아시아 언어 확장이 필요하고, 평가 모델 수가 제한적이며, 모든 프롬프트가 영어 사고(Chain‑of‑Thought)로 강제된 점을 들었다. 향후 연구에서는 다양한 프롬프트 언어, 더 많은 모델, 그리고 전체 250문제 모두에 대한 변형을 포함할 계획이다.

결론적으로 MGSM‑Pro는 다국어 수학 추론 평가에 있어 변형 인스턴스를 통한 강인성 검증이라는 새로운 패러다임을 제시하며, 기존 벤치마크가 갖는 과대적합·기억 의존성을 크게 완화한다. 이는 향후 LLM 개발·평가 시 보다 현실적인 목표 설정과 모델 설계에 중요한 지표가 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기