세밀한 추론 주입을 위한 서브스페이스 모델 병합

초록

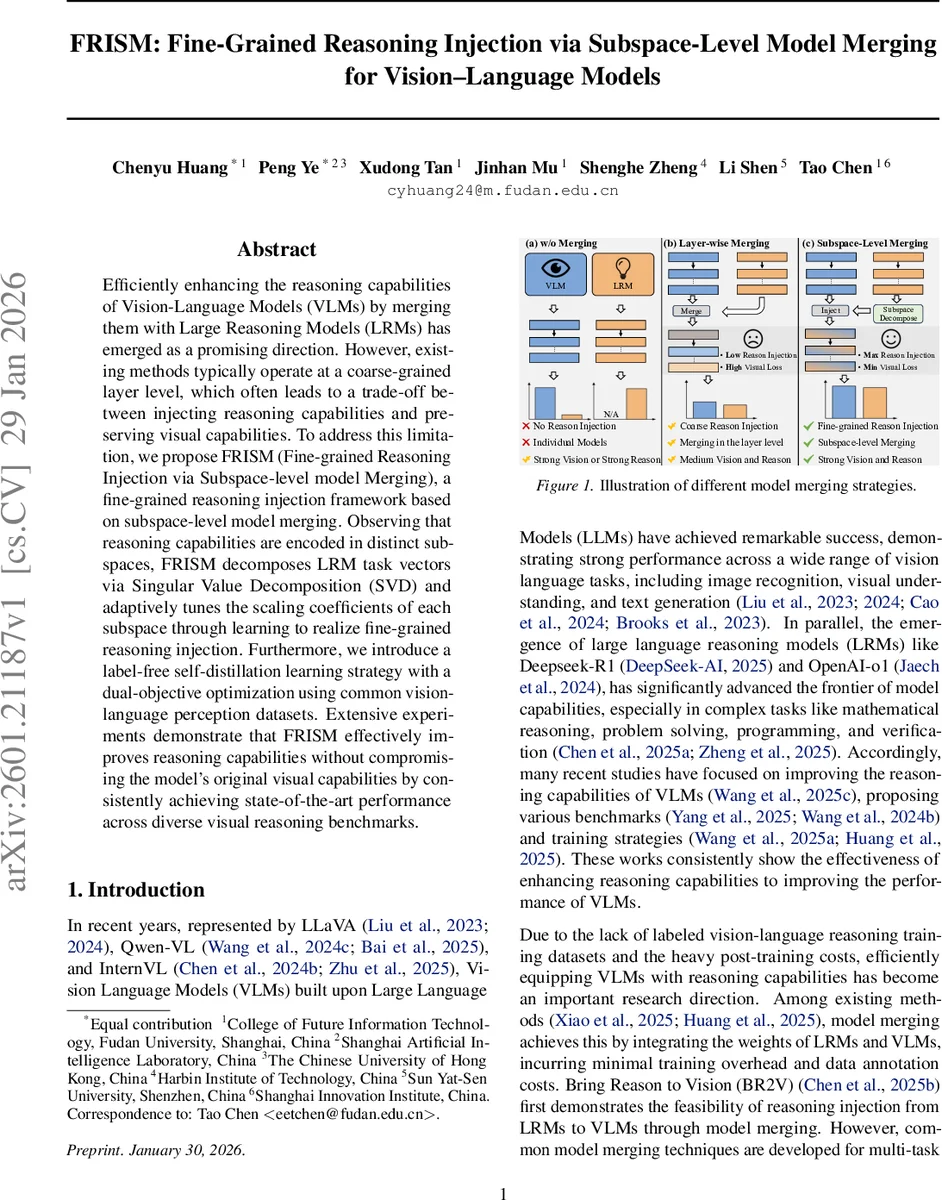

FRISM은 대규모 추론 모델(LRM)의 작업 벡터를 특이값 분해(SVD)로 서브스페이스로 분해하고, 각 서브스페이스의 스케일을 학습 가능한 게이트로 조절해 비전‑언어 모델(VLM)에 정밀하게 주입한다. 라벨이 없는 자기 증류를 이용해 시각 인식 성능을 유지하면서 추론 능력을 강화한다. 실험 결과, 다양한 비전‑언어 추론 벤치마크에서 시각 성능 손실 없이 최첨단 결과를 달성한다.

상세 분석

FRISM은 기존의 레이어‑단위 모델 병합이 “시각 vs. 추론” 트레이드오프를 피할 수 없다는 한계를 정확히 짚어낸다. 저자들은 추론 능력이 파라미터 공간 내 특정 저차원 서브스페이스에 집중된다는 가설을 세우고, 이를 검증하기 위해 LRM(DeepSeek‑R1‑Distill‑Qwen‑7B)의 작업 벡터를 SVD로 분해한다. 각 특이값(σ)은 해당 서브스페이스의 중요도를 나타내며, 레이어별로 동일한 스케일을 적용하면 시각 정보와 추론 정보가 혼합돼 성능 저하가 발생한다.

FRISM은 다음과 같은 두 단계로 구성된다.

1️⃣ 분해·초기화 단계: 레이어 l의 작업 벡터 τ_l^lrm을 U_l S_l V_l^T 로 분해하고, U와 V는 고정한다. 학습 가능한 파라미터 g_l∈ℝ^r(서브스페이스 수)를 도입해 Sigmoid(g_l)·S_l 형태로 각 특이값을 게이팅한다. 이렇게 하면 서브스페이스별 스케일을 0~1 사이에서 자유롭게 조절할 수 있다. 파라미터 수는 전체 모델 대비 극히 적어 효율적이다.

2️⃣ 주입·학습 단계: 라벨이 없는 멀티모달 데이터(예: TextVQA, POPE)를 활용해 자기 증류를 수행한다. 원본 VLM을 teacher, 서브스페이스가 주입된 모델을 student로 두고 KL‑다이버전스를 최소화해 시각 인식 출력을 유지한다. 동시에 “Spectral Injection Strength”라는 목표를 최대화해 서브스페이스의 총 스케일(∑σ·gate)을 크게 만든다. 이 듀얼 목표는 시각 손실을 억제하면서 추론 능력을 최대한 흡수하도록 모델을 유도한다.

실험에서는 Qwen2.5‑VL‑7B‑Instruct와 같은 최신 VLM에 FRISM을 적용했으며, 서브스페이스 순위별(예: rank‑1, rank‑5, rank‑10 등) 스케일링 곡선을 분석해 각 서브스페이스가 최적의 스케일을 갖는 지점을 발견했다. 이는 “추론은 고차원 서브스페이스에, 시각은 저차원 서브스페이스에”라는 기존 연구와 일맥상통한다.

결과적으로 FRISM은 기존 레이어‑단위 병합(예: BR2V, FRANK, IP‑Merging) 대비 추론 벤치마크(MMStar, R1‑OneVision)에서 평균 2~4%p 상승을 보였으며, 시각 인식 점수(TextVQA, POPE)에서는 거의 변동이 없었다. 또한 파라미터 오버헤드가 0.1% 이하에 불과해 실용적인 플러그‑앤‑플레이 솔루션으로 평가된다.

핵심 인사이트는 다음과 같다.

- 서브스페이스 수준의 정밀 제어가 레이어 수준보다 훨씬 효율적인 능력 전이 수단이다.

- SVD 기반 저차원 표현은 추론 특성을 명확히 분리해 불필요한 시각 파라미터와의 충돌을 최소화한다.

- 라벨‑프리 자기 증류는 대규모 멀티모달 라벨이 부족한 상황에서도 시각 정합성을 보장한다.

- 극소량 파라미터 학습(g_l)만으로도 강력한 성능 향상이 가능하므로, 다양한 VLM 아키텍처와 규모에 손쉽게 적용할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기