모바일 GUI 에이전트 실전 평가를 위한 종합 벤치마크 MobileBench OL

초록

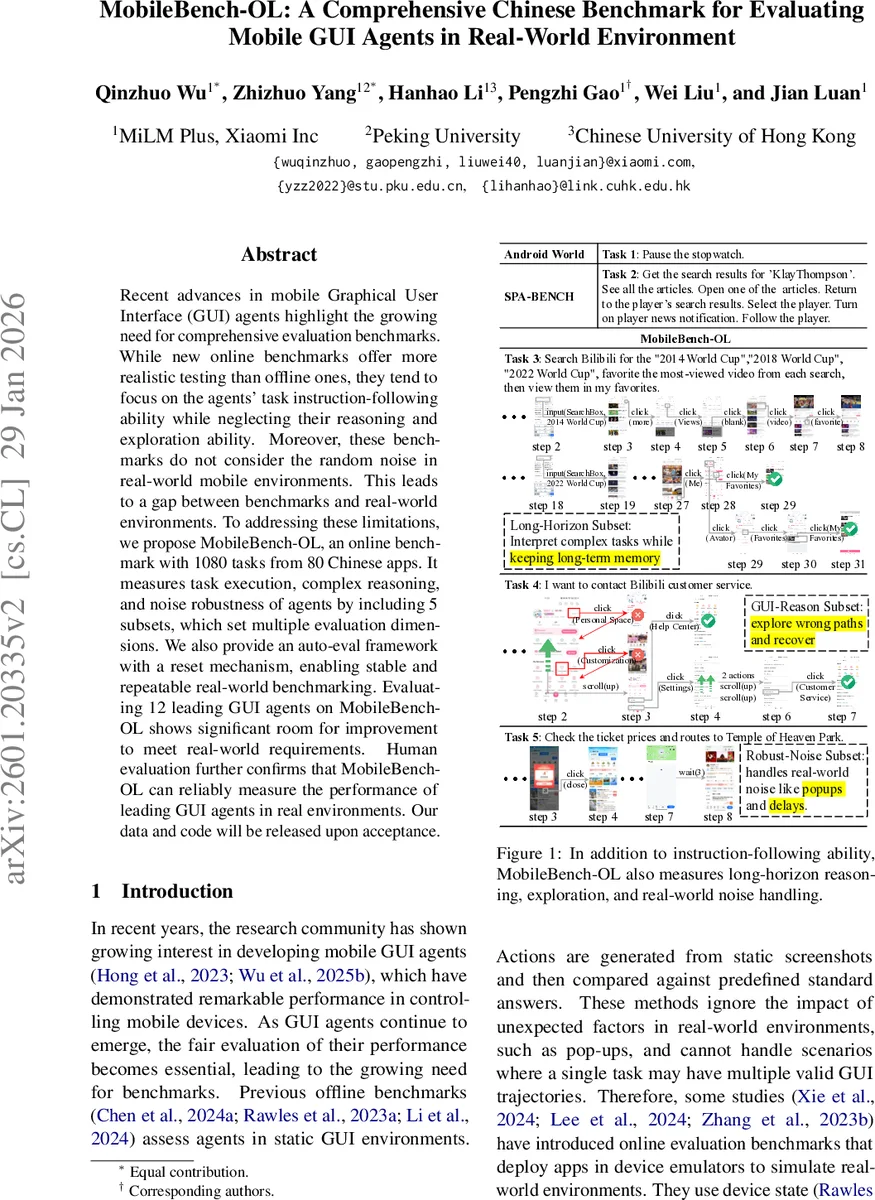

MobileBench-OL은 80개 중국 앱에서 1080개의 실제 모바일 GUI 작업을 수집하고, 기본 기능, 장기 추론, 탐색·노이즈 복원 등 5개의 하위 집합으로 나누어 에이전트의 수행 능력을 다각도로 평가한다. 자동 평가와 리셋 메커니즘을 도입해 실기기 환경에서도 안정적·재현 가능한 벤치마크를 제공한다.

상세 분석

본 논문은 기존 온라인 벤치마크가 단순 명령 수행에 치중하고, 실제 모바일 환경에서 발생하는 불확실성(팝업, 지연, 실행 실패 등)을 반영하지 못한다는 문제점을 정확히 짚어낸다. 이를 해결하기 위해 제안된 MobileBench-OL은 세 가지 핵심 차원을 설계한다. 첫째, 기본 역량(Base) 및 장기(롱테일) 하위 집합은 인기 앱과 비주류 앱을 골고루 포함해 UI 다양성에 대한 일반화 능력을 측정한다. 둘째, 복합 추론(Long‑Horizon, GUI‑Reasoning) 하위 집합은 20단계 이상을 요구하거나 아이콘 이해·숨겨진 기능 탐색·계층적 네비게이션과 같은 고난이도 탐색 능력을 검증한다. 셋째, 노이즈‑Robust 하위 집합은 팝업, 반복 실행, 미실행, 지연 네 가지 노이즈를 무작위로 삽입해 에이전트가 비정상적인 UI 변화를 자동 복구할 수 있는지를 평가한다.

난이도는 “골든 스텝”(인간이 최소 수행해야 하는 화면 전환 수)과 “탐색 가중치”(아이콘·숨김·계층별 가중치 합)로 정량화돼, Easy·Medium·Hard로 구분된다. 이러한 정량적 난이도 정의는 동일 작업에 대해 여러 정답 경로가 존재하는 현실을 반영한다.

데이터 구축 파이프라인은 (1) 앱 선정 → (2) 작업 설계 → (3) 골든 트래젝터리 정의 → (4) 성공 조건 명시 → (5) 트래젝터리 샘플링 → (6) 자동 평가·조건 검증 순으로 진행된다. 특히 Auto‑Eval 프레임워크는 화면 캡처와 UI 요소 메타데이터를 실시간으로 비교해 수동 라벨링 없이도 성공 여부를 판단한다. 또한 Reset Mechanism은 작업 종료 후 기기를 초기 상태로 복구해 연속 실행 시 상태 누적을 방지하고, 실기기 재현성을 크게 높인다.

실험에서는 12개의 최신 GUI 에이전트를 MobileBench-OL에 적용했으며, 전반적으로 30% 이하의 성공률을 기록해 현존 에이전트가 실제 환경에서 아직 충분히 성능을 발휘하지 못함을 보여준다. 특히 노이즈‑Robust 하위 집합에서 대부분의 에이전트가 팝업 차단이나 지연 처리에 실패했으며, GUI‑Reasoning 영역에서는 탐색 경로를 잘못 선택하거나 아이콘을 오인식하는 경우가 빈번했다. 인간 평가 결과는 자동 평가와 높은 상관관계를 보였으며, MobileBench-OL이 실제 사용자 관점에서 에이전트 성능을 신뢰성 있게 측정한다는 점을 입증한다.

본 연구의 주요 기여는 (1) 80개 앱·1080작업으로 구성된 대규모 실세계 벤치마크 제공, (2) 다차원 평가를 위한 5가지 하위 집합 설계, (3) 자동화된 평가·리셋 메커니즘을 통한 재현 가능성 확보, (4) 최신 에이전트들의 한계 진단이다. 향후 연구는 더 다양한 언어·지역 앱 확대와, 노이즈 유형을 실제 사용자 로그 기반으로 정교화하는 방향으로 확장될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기