어둠 속 자율 비행 로봇을 위한 패시브 광학 기반 깊이 추정 및 내비게이션

초록

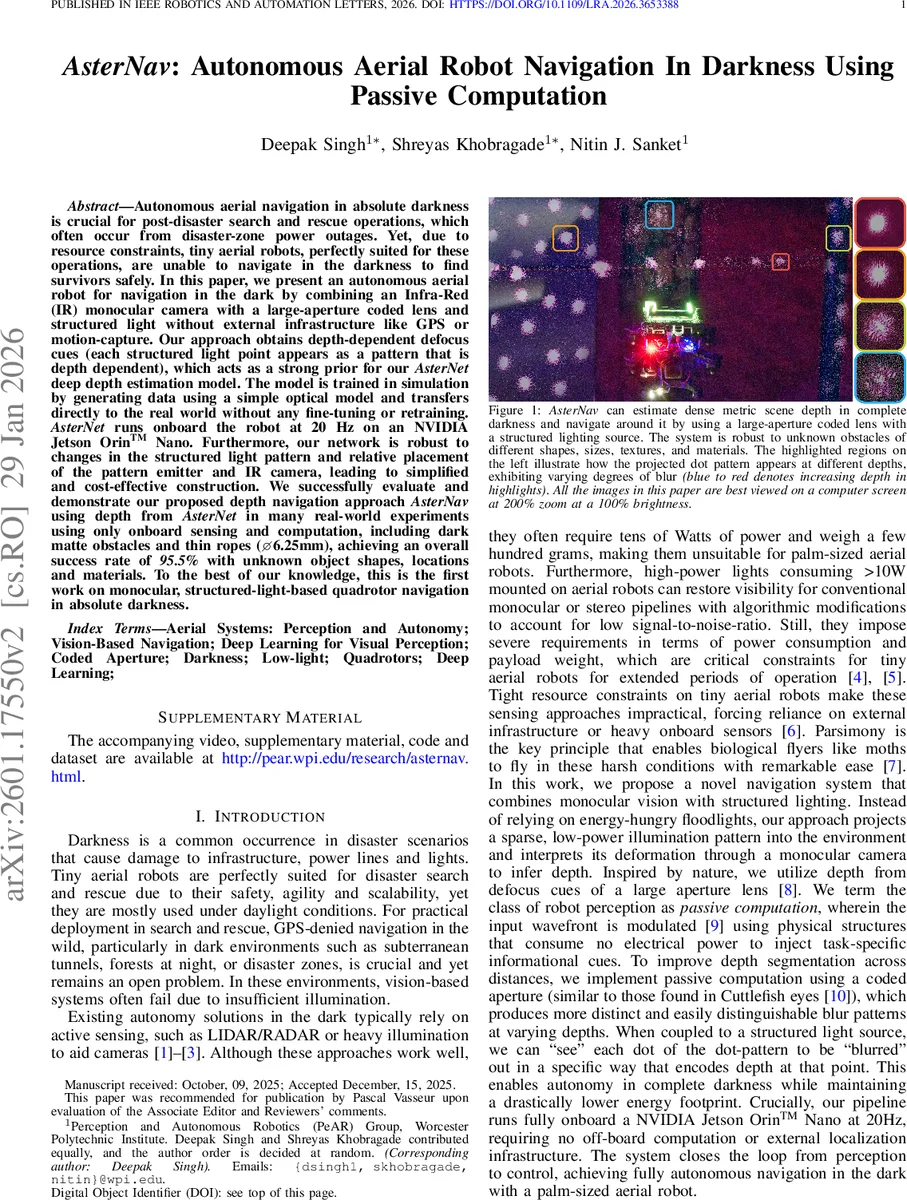

본 논문은 적외선 단일 카메라와 대구경 코딩 렌즈, 저전력 구조광을 결합해 완전 어두운 환경에서 깊이 정보를 획득하고, 이를 기반으로 소형 쿼드로터가 온보드 연산만으로 장애물을 회피하도록 하는 시스템(AsterNav)을 제안한다. 깊이‑의존적 디포커스 패턴을 활용한 AsterNet 모델은 시뮬레이션만으로 학습돼 실제 환경에 바로 적용되며, Jetson Orin Nano에서 20 Hz 실시간 추론이 가능하다. 실험 결과 95.5 %의 성공률을 기록한다.

상세 분석

AsterNav은 “패시브 컴퓨테이션”이라는 개념을 핵심으로 한다. 대구경 코딩 aperture는 광학적으로 깊이에 따라 서로 다른 블러 패턴을 생성하도록 설계되었으며, 이는 구조광 점광원과 결합될 때 각 점이 깊이에 비례한 형태로 퍼지는 특징을 만든다. 이러한 디포커스 힌트를 강력한 사전(prior)으로 활용해, 단일 이미지에서 메트릭 깊이를 직접 추정하는 딥 CNN인 AsterNet을 학습한다.

데이터 생성 과정은 실제 렌즈와 코딩 aperture의 PSF(Point Spread Function)를 여러 깊이에서 캡처한 “PSF bank”를 구축한 뒤, 이를 이용해 COCO 배경 이미지와 무작위 다각형 장애물을 합성함으로써 대규모 합성 데이터셋을 만든다. 중요한 점은 실제 캘리브레이션 이미지(실제 벽에 투사된 점패턴)를 사용함으로써 렌즈 왜곡·회절 등 복잡한 광학 현상을 정확히 반영한다는 것이다. 이 방식 덕분에 라벨링된 실제 깊이 데이터 없이도 “제로‑샷” 일반화가 가능해졌다.

네트워크 구조는 encoder‑decoder 형태의 경량 UNet 변형으로, 입력은 적외선 이미지(역전된 밝기)이며 출력은 밀도 높은 깊이 맵이다. 학습은 L1 손실과 구조적 유사도(SSIM) 손실을 결합해 정밀도와 경계 보존을 동시에 최적화한다. 모델은 NVIDIA Jetson Orin Nano에서 20 Hz, 약 8 ms의 추론 시간을 보이며, 전력 소모는 5 W 이하로 소형 비행체에 적합하다.

시스템의 강인성은 두 가지 측면에서 검증된다. 첫째, 구조광 패턴(점의 밀도·배열)과 광원·카메라 간 상대 위치가 변해도 깊이 추정 정확도가 크게 떨어지지 않는다. 이는 코딩 aperture가 생성하는 블러 패턴이 구조광의 구체적인 형태에 크게 의존하지 않기 때문이다. 둘째, 고전적인 깊이‑from‑defocus 파이프라인과 비교했을 때, AsterNet은 잡음·왜곡에 대한 복원력이 뛰어나며, 동일한 하드웨어에서 실시간으로 동작한다.

제한점으로는 정적 장면을 전제로 한다는 점이다. 움직이는 장애물이나 급격한 조명 변화(예: 외부 광원 유입)에는 현재 파이프라인이 민감할 수 있다. 또한, 구조광 점이 매우 멀리 있거나 반사율이 낮은 표면에서는 신호‑대‑노이즈 비가 감소해 깊이 추정 오차가 증가한다. 향후 연구에서는 동적 장면에 대한 연속적인 깊이 추정과, 반사율 추정·보정 메커니즘을 통합하는 방향이 제시된다.

댓글 및 학술 토론

Loading comments...

의견 남기기