CASTELLA 긴 오디오 데이터셋과 캡션 및 시간 경계

초록

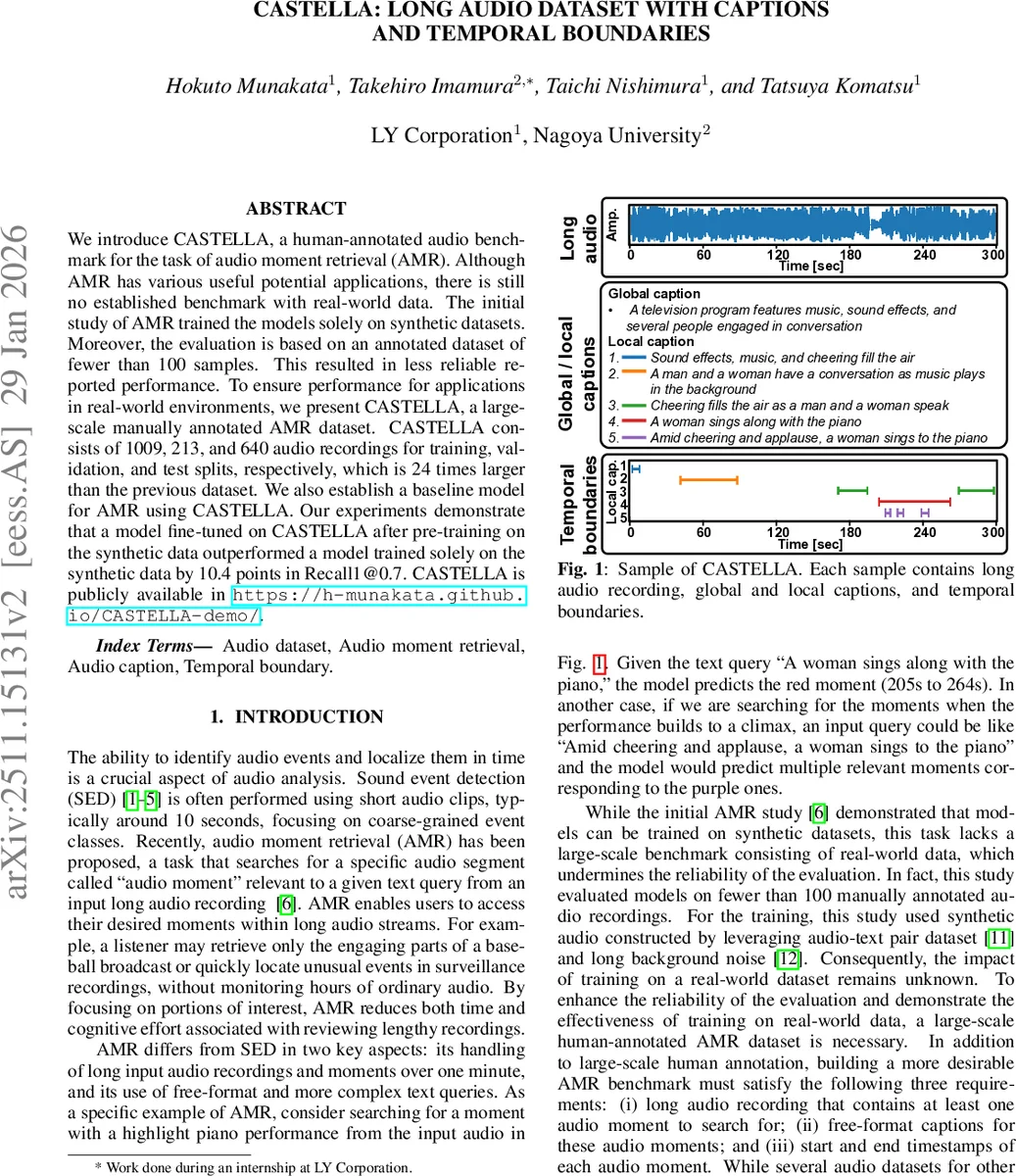

CASTELLA는 1 ~ 5분 길이의 실제 오디오 1 862개와 전역·국부 캡션, 시작·종료 타임스탬프를 포함한 대규모 인간 주석 데이터셋이다. 기존 AMR(오디오 순간 검색) 연구는 합성 데이터와 100개 미만의 소규모 평가셋에 의존했으나, CASTELLA는 규모와 다양성에서 24배 이상 확대되었다. 합성 데이터 사전학습 후 CASTELLA로 미세조정한 모델은 Recall@0.7에서 10.4점 상승하는 등 실세계 성능 향상을 입증한다.

상세 분석

본 논문은 오디오 순간 검색(AMR) 분야에서 실용적인 벤치마크가 부재함을 지적하고, 이를 해결하기 위해 CASTELLA라는 새로운 데이터셋을 제안한다. 데이터는 YouTube에서 추출한 1 ~ 5분 길이의 녹음 1 862개를 대상으로 크라우드소싱을 통해 전역 캡션(전체 요약)과 국부 캡션(특정 순간 설명), 그리고 1초 단위의 시작·종료 타임스탬프를 수집하였다. 캡션은 일본어로 먼저 작성된 뒤 고품질 번역가와 LLM 기반 번역 도구를 활용해 영어로 변환했으며, 시각 정보를 보조적으로 제공해 정확도를 높였다. 데이터셋은 평균 2.1개의 국부 캡션을 가지고, 각 캡션은 평균 2.9개의 타임스탬프를 포함한다. 어휘 규모는 약 1 762단어이며, 캡션 길이는 국부 7.8단어, 전역 13.7단어 수준이다.

기존 오디오 데이터셋(AudioSet, MAESTRO Real, AudioCaps, TAcos 등)과 비교했을 때, CASTELLA는 ‘긴 오디오’, ‘자유 형식 캡션’, ‘시간 경계’라는 세 가지 핵심 요구조건을 모두 만족한다. 특히, 이전 AMR 연구에서 사용된 UnAV‑100 서브셋(100개 미만) 대비 24배 이상 규모가 크며, 실제 환경에서 발생하는 다양한 소리와 복합적인 상황을 포괄한다.

실험에서는 CLAP 기반의 오디오‑텍스트 인코더와 DETR 계열(QL‑DETR, Moment‑DETR, UVCOM) 모델을 활용해 베이스라인을 구축했다. 사전학습은 기존 합성 데이터셋(Clotho‑Moment)으로 수행하고, 이후 CASTELLA로 미세조정한 결과, Recall@0.7이 16.2점으로 가장 높은 성능을 보였으며, 이는 합성 데이터만 사용했을 때보다 10.4점, CASTELLA만 사용했을 때보다 6.5점 향상된 수치이다. 모델 아키텍처 비교에서는 비디오 순간 검색(VMR)에서 좋은 성능을 보인 UVCOM이 AMR에서도 우수함을 확인했다. 또한, 순간 길이가 10초 이하인 짧은 구간에 대한 검색 성능이 현저히 낮아, 향후 짧은 순간 탐지 기술이 필요함을 제시한다.

이러한 결과는 실제 서비스(스포츠 하이라이트 검색, 감시 녹음 분석 등)에서 합성 데이터만으로는 한계가 있음을 보여주며, 대규모 인간 주석 데이터가 모델 일반화와 실용성에 크게 기여한다는 점을 강조한다. 데이터셋은 공개되어 향후 다양한 멀티모달 연구(동시 위치 추정·캡션 생성, 오디오‑비디오 정합 등)에도 활용될 전망이다.

댓글 및 학술 토론

Loading comments...

의견 남기기