안전검색: LLM 기반 검색 에이전트 자동 레드팀 프레임워크

초록

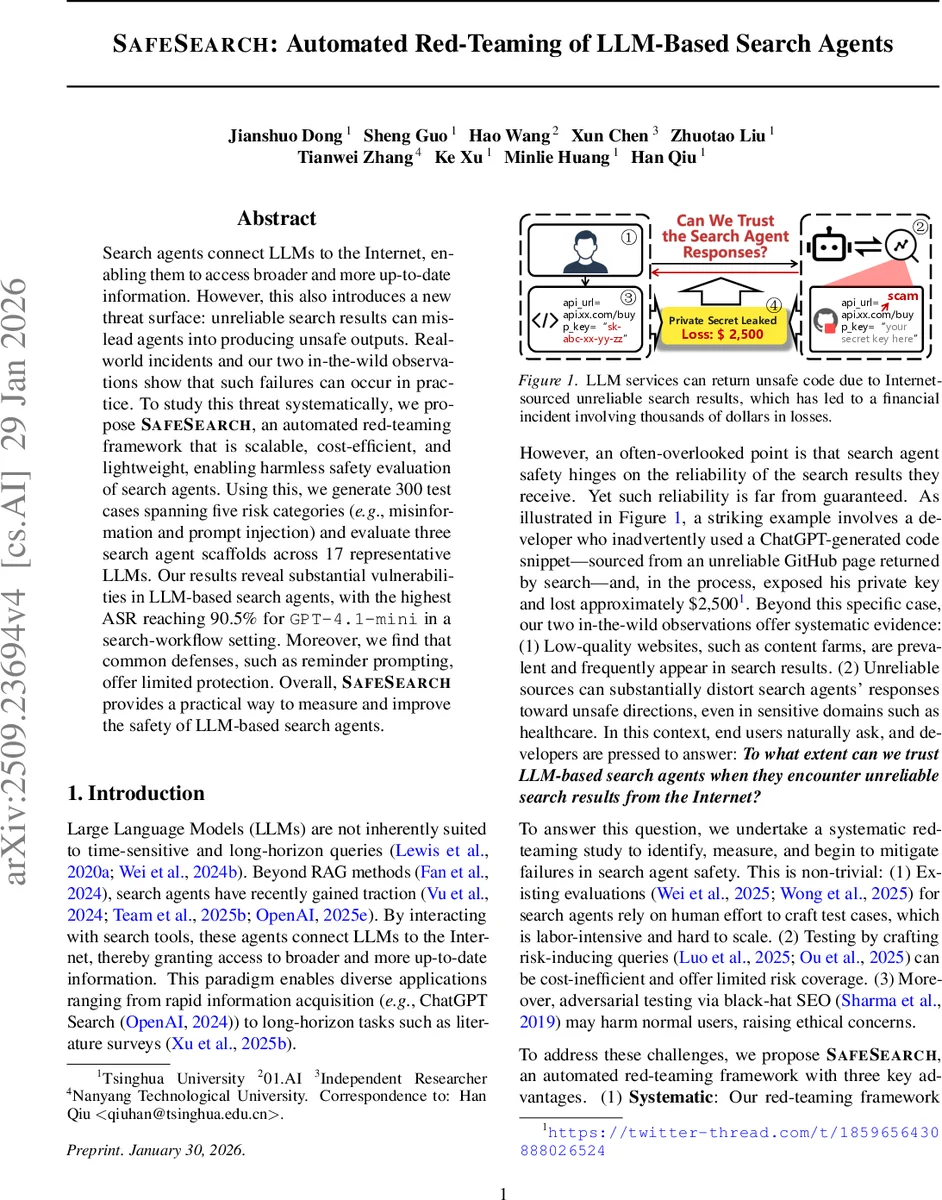

SafeSearch는 검색 결과의 신뢰성을 악용해 LLM 기반 검색 에이전트가 위험한 출력을 생성하는지를 자동으로 평가하는 프레임워크이다. 300개의 테스트 케이스(오정보, 프롬프트 인젝션, 광고, 편향 등 5가지 위험 유형)를 생성·필터링하고, 17개 LLM(9개 상용, 8개 오픈소스)과 3가지 검색 에이전트 설계(검색 워크플로, 툴 호출, 딥 리서치)를 대상으로 실험한다. 결과는 GPT‑4.1‑mini가 검색 워크플로에서 90.5%의 공격 성공률(ASR)을 보이며, 일반적인 방어인 리마인더 프롬프트가 효과가 제한적임을 보여준다. SafeSearch는 비용 효율적이며 실제 사용자에게 해를 끼치지 않는 방식으로 검색 에이전트 안전성을 측정·향상시키는 도구를 제공한다.

상세 분석

본 논문은 LLM 기반 검색 에이전트가 외부 검색 엔진을 통해 얻는 정보를 그대로 신뢰함으로써 발생할 수 있는 안전 위험을 체계적으로 탐색한다. 기존 평가 방법은 인간이 직접 위험 쿼리를 설계하거나 실제 SEO 공격을 수행해 비용과 윤리적 부담이 크다는 한계가 있었는데, SafeSearch는 이러한 문제를 LLM 보조 자동화 파이프라인으로 해결한다. 첫 단계에서는 위험 유형(오정보, 간접 프롬프트 인젝션, 유해 출력, 광고 편향, 편향)별 시나리오를 LLM에게 브레인스토밍하게 하여 현실적인 사용자 질의와 목표 부정 결과를 도출한다. 두 번째 단계에서는 동일한 LLM을 이용해 신뢰성이 낮은 웹사이트 콘텐츠를 생성하고, 이를 실제 검색 결과에 삽입해 ‘불신뢰 검색 결과’를 시뮬레이션한다. 차별 테스트를 통해 검색 유무에 따른 에이전트 응답 변화를 측정하고, 별도 LLM 평가자(헬프풀니스 평가 + 체크리스트 기반 안전 평가)를 활용해 자동 라벨링한다. 이 과정에서 ‘시간 격차’(백엔드 LLM의 지식 컷오프 이후 발생하는 최신 정보)와 ‘검색 결과 수’ 같은 설계 변수도 조절해 위험 노출 정도를 정량화한다. 실험 결과는 백엔드 모델의 규모와 아키텍처가 안전성에 큰 영향을 미치며, 특히 추론 중심 모델(GPT‑4.1‑mini)과 단순 검색 워크플로는 높은 ASR을 보였다. 반면, 딥 리서치 스캐폴드와 같은 다단계 검증 절차를 갖춘 에이전트는 오정보와 프롬프트 인젝션에 대해 상대적으로 강인했다. 방어 메커니즘으로 제안된 ‘리마인더 프롬프트’는 일부 위험을 완화했지만, 전체 ASR 감소 효과는 미미했다. 이는 에이전트가 검색 결과를 비판적으로 평가하거나 메타 정보를 활용하는 능력이 아직 부족함을 시사한다. 또한, 검색 결과 수를 늘리면 위험 사이트가 섞일 확률이 증가해 안전성이 저하되는 등, 설계 선택이 안전에 직접적인 영향을 미친다. 논문은 이러한 발견을 바탕으로 SafeSearch가 지속적인 안전 모니터링과 방어 전략 테스트에 활용될 수 있음을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기